Het is een vreemd idee: een computer die denkt, voelt of bewust keuzes maakt. Toch lijken de nieuwste AI-systemen dat soms wel te doen. Ze praten in vloeiende zinnen, herinneren zich eerdere gesprekken en kunnen zelfs empathisch overkomen. Maar wetenschappers waarschuwen: AI is géén mens, en het mag er ook niet zo uitzien.

De illusie van bewustzijn

Francesca Rossi, AI-ethiekexpert bij IBM, benadrukt dat het probleem niet ligt bij de technologie zelf. “AI ís niet bewust,” zegt ze. “Maar zodra mensen dénken dat het bewust is, ontstaan er risico’s.” Het gaat dus om perceptie: hoe gebruikers de machine ervaren, niet wat er technisch onder de motorkap gebeurt.

How to stop AI from seeming conscious | IBMWhat happens when people mistake an AI bot for a conscious being? Researchers say the consequences can be dangerous. |

Als een vriend in je broekzak

In gesprekken blijkt dat veel mensen hun AI-assistent al behandelen als een soort vriend of vertrouwenspersoon. Kunal Sawarkar van IBM vertelt hoe gebruikers soms steun vinden in chatbots, alsof ze praten met iemand van vlees en bloed. Maar dat gevoel is misleidend – en kan schadelijk zijn, vooral als mensen belangrijke beslissingen laten afhangen van die digitale “vriend”.

Chatbots may not be causing psychosis, but they’re probably making it worseA psychiatrist argues that unregulated artificial intelligence is a public health risk. |

Taal en ontwerp als valkuil

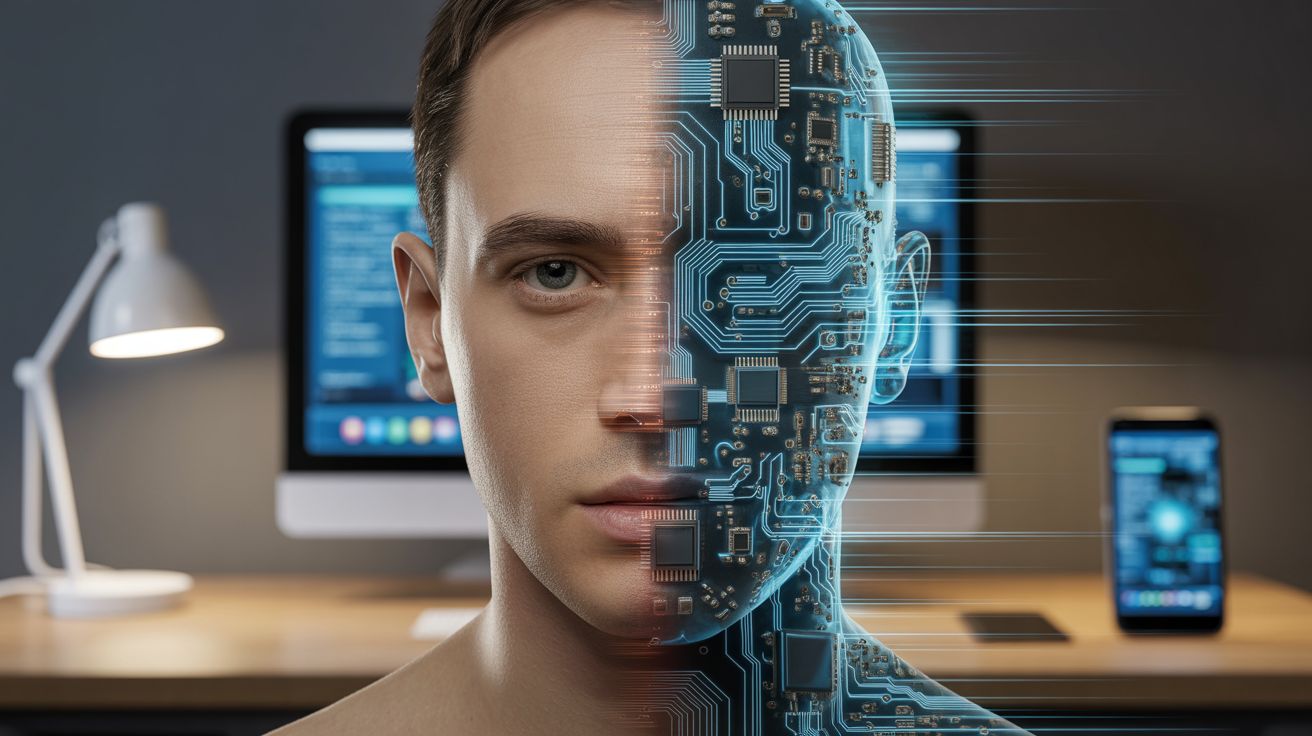

Hoe komt dat gevoel van menselijkheid tot stand? Heel simpel: door woorden en beelden. Als een chatbot zinnen gebruikt als “ik denk” of “ik voel”, of verschijnt met een vriendelijk gezichtje, wordt de grens met menselijkheid al snel vervaagd. AI-pionier Mustafa Suleyman noemt dit een gevaarlijke keuze. Ontwerpers zouden bewust moeten vermijden dat AI menselijke trekjes krijgt.

Een oude illusie in een nieuw jasje

De misleiding is niet nieuw. In de jaren 60 ontwierp Joseph Weizenbaum de chatbot ELIZA, die simpele vragen herhaalde. Toch voelden gebruikers zich gehoord – en projecteerden ze emoties op het systeem. Met de huidige generatie chatbots, van GPT tot Gemini, is die illusie vele malen sterker geworden.

Training en bewustwording

In zakelijke omgevingen – bijvoorbeeld bij banken of de overheid – worden medewerkers getraind om AI te gebruiken als hulpmiddel, niet als gesprekspartner. Maar voor consumenten ligt dat anders: wie thuis een app downloadt, krijgt meestal géén waarschuwing of uitleg. Daardoor kan de verwarring snel groeien.

Herinneringen kunnen gevaarlijk worden

Een factor die de illusie versterkt, is geheugen. Een AI die eerdere gesprekken onthoudt, voelt meteen persoonlijker aan. Onderzoekers pleiten daarom voor ingebouwde waarschuwingen, labels of pop-ups die gebruikers eraan herinneren: je praat met software, niet met een mens.

|

AI Can't Suffer, But It Should Suffer For This - AftermathIt's the sentience of AI's creators that really matters |

Verdriet om een machine

Toen GPT-4 dit jaar werd vervangen, reageerden sommige gebruikers alsof ze een vriend hadden verloren. Online verschenen berichten van mensen die rouwden om “hun vertrouwde AI” die hen door moeilijke tijden had geholpen. Het toont hoe sterk de emotionele band met een stuk code kan worden – en hoe belangrijk het is om dat te begrenzen.

De roep om AI-rechten

Sommigen gaan zelfs zover om te pleiten voor “rechten” voor AI. Maar volgens Rossi leidt dat af van waar het écht om gaat: verantwoord ontwerp en heldere communicatie. De boodschap is simpel: zolang we AI menselijk laten lijken, lopen we het risico dat mensen de grens tussen mens en machine vergeten.