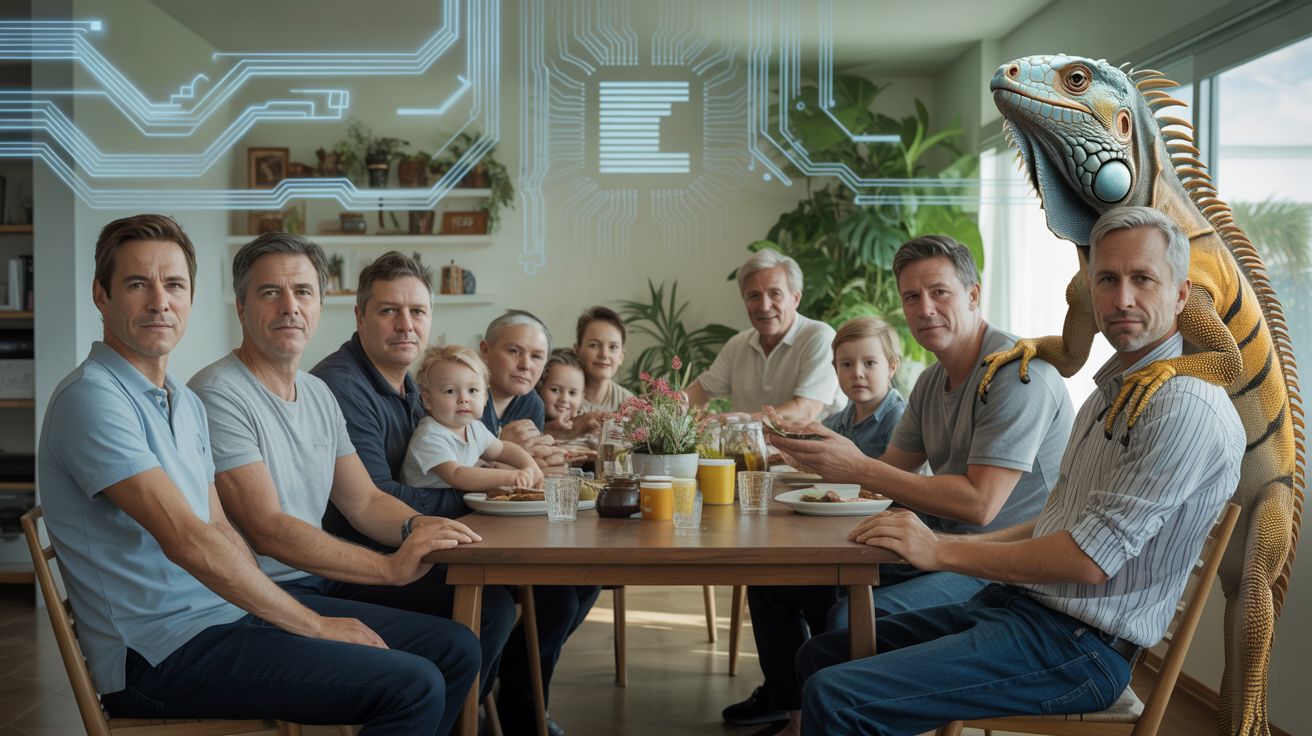

Onderzoekers van de Conversation, gepubliceerd via Oxford University Press, ontdekten dat populaire generatieve AI‑tools – zoals DALL·E 3, Midjourney, Adobe Firefly, DreamStudio en Meta AI – stereotype beelden van Australiërs produceren wanneer ze worden gevraagd om een ‘typische Australische vader’ te tonen. De afbeeldingen tonen vrijwel uitsluitend witte mannen in klassieke koloniale settings, vaak met biotoopfoutieve clichés zoals uitheemse dieren: de AI plaatste bijvoorbeeld een iguana naast de vader, een dier dat niet inheems is in Australië.

Onderbuik van bias: monocultuur in pixelvorm

In totaal werden zo'n 700 afbeeldingen geanalyseerd, gegenereerd op basis van 55 korte prompts zonder aangepaste instellingen. De resultaten bevestigden een terugkerend patroon: Australische familiebeelden zijn homogeen, heteronormatief en gestileerd vanuit een wit, kolonialistich verleden.

|

Researchers asked AI to show a typical Australian dad: he was white and had an iguana | Tama Leaver and Suzanne Srdarov for the ConversationNew research finds generative AI depicts Australian themes riddled with sexist and racist caricatures |

Hoog tijd voor regelgeving

In Australië waarschuwt mensenrechtencommissaris Lorraine Finlay dat AI, zonder strenge regelgeving, racisme en seksisme juist kan verergeren. Ze benoemt twee kernproblemen: 1) algorithmische bias, waarbij vooroordelen uit de trainingsdata in de AI zelf verankerd raken, en 2) automatiseringsbias, waarbij mensen geneigd zijn beslissingen van machines zonder kritisch na te denken over te nemen.

|

Use of AI could worsen racism and sexism in Australia, human rights commissioner warnsLabor divided on how to respond to the emerging technology as media and arts groups fear ‘rampant theft’ of intellectual property |

Finlay roept op tot urgente wetgeving met vereisten als bias‑testen, transparantie en menselijke beoordeling om dit tegen te gaan.

Labor‑partij senator Michelle Ananda‑Rajah, ex‑arts en AI‑onderzoeker, pleit ervoor Australische data toegankelijk te maken voor AI‑training. Zo wil zij voorkomen dat buitenlandse modellen lokale diversiteit niet representeren. Ze stelt voor makers van content te betalen en verwijst naar toepassingen zoals huidskankerscreening, waar AI faalt zonder diverse Australische datasets.

Conclusie: AI, cliché én nachtmerrie

AI lijkt bij gebrek aan regulering nostalgische en discriminerende vergezichten te produceren: witte gezinnen, outbackscènes, en voor de grap zelfs een iguana. Terwijl Australië worstelt met de uitdaging deze technologie inclusiever en verantwoord te maken, groeit de roep om wetgeving die AI-tools dwingt representatiever, transparanter en eerlijker te zijn.