DeepSeek, een Chinese AI-ontwikkelaar uit Hangzhou, heeft met het model R1 een sensationele onthulling gedaan: het zou slechts $294.000 hebben gekost om dit geavanceerde taalmodel te trainen. Dat bedrag ligt vele malen lager dan wat gangbaar is bij Amerikaanse concurrenten. De onthullingen rond R1, gepubliceerd in het wetenschappelijke tijdschrift Nature, mikken op een nieuwe discussie over efficiëntie, openheid en de werkelijke kosten achter AI-modellen.

Waaróm dit nieuws opvalt

- AI-modellen van grote Amerikaanse bedrijven lopen vaak in de tientallen tot honderden miljoenen dollars aan trainingskosten. DeepSeek’s claim ondergraaft de veronderstelling dat vooruitgang in AI per se enorm kapitaal vergt.

- Het feit dat DeepSeek deze informatie in Nature publiceerde — inclusief specifieke details over hardware (512 Nvidia H800-chips) en trainingsduur (80 uur) — versterkt de geloofwaardigheid van de bewering.

Hoe DeepSeek-R1 leert redeneren

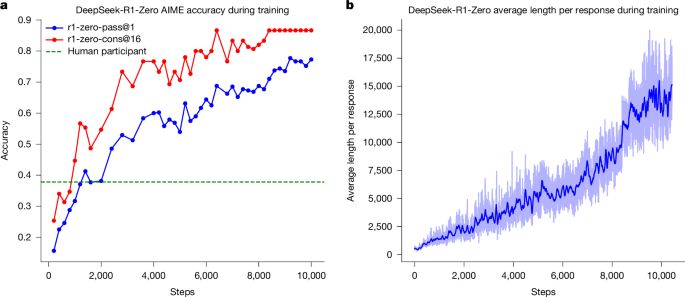

DeepSeek gebruikt bij R1 geen traditionele menselijke supervisie via grote datasets met voorbeelden, maar een methode genaamd reinforcement learning (RL) om het model te stimuleren zelfstandig complexe redeneringen te ontwikkelen — zoals zelfverificatie (het model controleert zijn eigen antwoord), reflectie en het structureren van zijn denkproces.

Er is ook een variant genaamd DeepSeek-R1-Zero die les krijgt puur met RL, zonder voorafgaande menselijke voorbeelddata (zonder supervised fine-tuning). Dit experiment toont dat redeneren kan ontstaan uit beloningssignalen alleen.

|

DeepSeek-R1 incentivizes reasoning in LLMs through reinforcement learning - NatureGeneral reasoning represents a long-standing and formidable challenge in artificial intelligence (AI). Recent breakthroughs, exemplified by large language models (LLMs)1,2 and chain-of-thought (CoT) prompting3, have achieved considerable success on foundational reasoning tasks. |

Kosten in perspectief

- De $294.000 is alléén de trainingskost voor het redeneringsgerichte R1-model; voorafgaand hieraan besteedde DeepSeek zo’n $6 miljoen aan het bouwen van de basis-LLM waarop R1 is voortgebouwd.

- Hoewel $294.000 laag klinkt, werd het model getraind met 512 H800-chips, specifiek ontworpen voor de Chinese markt vanwege exportbeperkingen op krachtigere chips zoals de H100/A100. DeepSeek gaf echter toe dat A100-chips gebruikt zijn in een voorbereidende fase van kleinere modellen.

Mogelijke beperkingen en kritiek

Sommige skeptici vragen zich af hoe “realistisch” de kostenberekening is, gezien verborgen kosten zoals infrastructuur, energie, menselijke arbeid, data-acquisitie, debugging en finetuning. DeepSeek-R1 heeft nog steeds zwakkere punten, zoals minder goede ondersteuning voor “tool use” (het gebruik van externe hulpmiddelen zoals rekenmachines of zoekmachines) en structuur van outputs. Ook het leesbaar houden van gegenereerde redeneringen blijft een uitdaging. Er is kritiek op mogelijke censuur of inhoudsbeperkingen, zeker bij politieke of gevoelige onderwerpen, gezien de Chinese regelgeving.

Here’s How DeepSeek Censorship Actually Works—and How to Get Around ItA WIRED investigation shows that the popular Chinese AI model is censored on both the application and training level. |

Wat dit betekent voor de toekomst van AI

DeepSeek-R1 dwingt de AI-industrie om vragen te stellen over wat “kosten-efficiëntie” werkelijk inhoudt. Als modellen met verantwoorde prestaties gegenereerd kunnen worden zonder enorme investeringen, kan dat de drempels voor deelname verlagen, innovatie versnellen, en het speelveld democratischer maken. Tegelijkertijd wringt dit met verwachtingen rond veiligheid, privacy, regulering en ethiek — want goedkoper kan ook betekenen: minder nauwkeurigheid, minder transparantie of grotere risico’s.

Met zijn onthulling dat een geavanceerd taalmodel kan worden getraind voor minder dan $300.000, zet DeepSeek een interessant precedent. R1 laat zien dat innovatie in AI niet per se gebonden is aan de hoogste kosten, mits men slimme methoden gebruikt zoals reinforcement learning, openheid van hardwarekeuzes en transparantie. Of dit model alle beloften waarmaakt — in diverse talen, toepassingen, en onder verschillende regulaties — zal de komende maanden duidelijk worden.

|

DeepSeek didn’t really train its flagship model for $294,000: Training costs detailed in R1 training report don't include 2.79 million GPU hours that laid its foundation |