Hoe Google met speculatieve cascades de taalmodellen sneller én slimmer maakt.

Een zoektocht naar snelheid en efficiëntie

Bij Google Research leeft al langer de vraag: hoe kunnen grote taalmodellen (LLM’s) sneller reageren, zonder dat dit ten koste gaat van de kwaliteit? Wie ooit op een AI-chat heeft gewacht tot een lang antwoord langzaam verschijnt, begrijpt het probleem. Tijd is kostbaar, en rekenkracht ook. Daarom gingen onderzoekers op zoek naar een nieuwe aanpak.

De inspiratie: Twee bestaande technieken

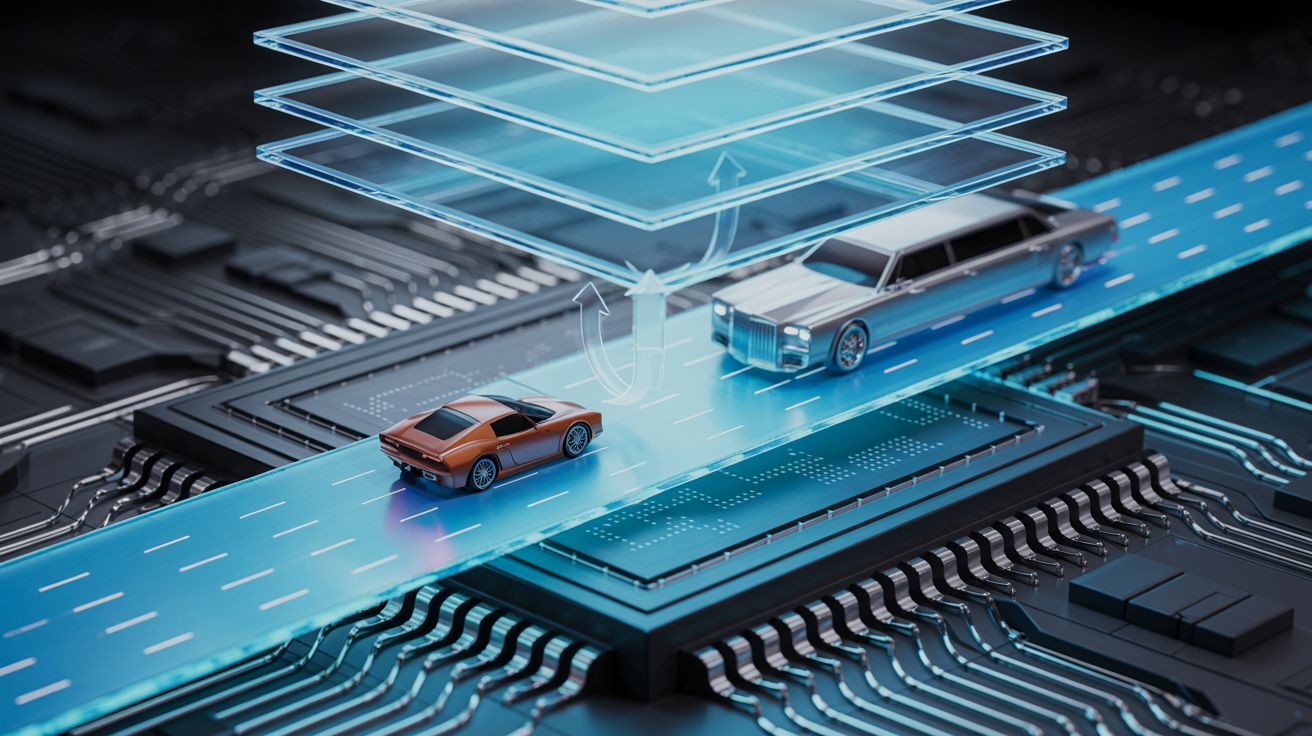

Ze hadden al twee krachtige methodes in handen. De eerste was cascades, waarbij een klein en snel model eerst zijn kans krijgt. Pas als dat model twijfelt, springt een groter en slimmer model bij. Zo wordt rekenkracht slim verdeeld.

De tweede techniek was speculative decoding. Hier voorspelt een klein model alvast een conceptantwoord. Een groot model leest mee en knikt goedkeurend als het klopt. Het voordeel: meerdere woorden kunnen tegelijk worden goedgekeurd, wat tijd scheelt. Maar als er al vroeg een fout in de voorspelling sluipt, gaat die winst verloren.

|

Speculative cascades — A hybrid approach for smarter, faster LLM inferenceWe introduce “speculative cascades”, a new approach that improves LLM efficiency and computational costs by combining speculative decoding with standard cascades. |

Het idee: Een hybride oplossing

De onderzoekers vroegen zich af: wat als we deze twee aanpakken combineren? Zo ontstond het concept speculatieve cascades. Het kleine model schrijft nog steeds een eerste versie, maar nu beslist een slimme regel — de zogenaamde deferral rule — of die versie kan blijven staan of moet worden overgenomen door het grote model.

Het resultaat: minder tijdverlies door afwijzingen én minder onnodig werk voor het grote model.

Een voorbeeld uit de praktijk

Neem de vraag: “Wie is Buzz Aldrin?”Het kleine model kan snel melden dat hij een astronaut was die als tweede mens op de maan liep. Het grote model kan diezelfde vraag beantwoorden met een uitgebreider, formeler stuk tekst.

Met speculatieve cascades hoeft het grote model niet telkens opnieuw te beginnen. Als het kleine model correct zit, mag dat antwoord gewoon blijven staan. Alleen als het te oppervlakkig is, vult het grote model aan.

De resultaten: Sneller en goedkoper

In experimenten met modellen als Gemma en T5 bleek dat speculatieve cascades niet alleen sneller werken, maar ook goedkoper in gebruik zijn. De balans tussen snelheid, kwaliteit en kosten komt hierdoor beter uit dan bij de oude methodes.

Of het nu gaat om samenvatten, vertalen, vragen beantwoorden of zelfs code schrijven: de hybride aanpak laat zien dat één plus één meer kan zijn dan twee.

Waarom dit belangrijk is

Taalmodellen worden steeds vaker ingezet in apps, zoekmachines en virtuele assistenten. Gebruikers verwachten directe antwoorden, en bedrijven willen de kosten laag houden. Speculatieve cascades bieden precies die mix van snelheid en betrouwbaarheid.

Het opent de weg naar toepassingen waar elke seconde telt, zoals realtime vertalingen of interactieve leermiddelen.

De volgende stap in AI-efficiëntie

Met speculatieve cascades laat Google zien dat vooruitgang niet altijd zit in nóg grotere modellen, maar soms juist in slimmere methodes om bestaande modellen samen te laten werken.

De boodschap is duidelijk: in de toekomst draait het niet alleen om wat AI kan zeggen, maar ook om hoe snel en efficiënt ze dat kan doen.