In onderzoekslaboratoria over de hele wereld klinkt dezelfde verzuchting: wéér wachten op hardware, wéér een training die dagen langer duurt dan gepland. Universiteiten die voorop willen lopen in AI- en HPC-onderzoek botsen vaak tegen de grenzen van hun eigen infrastructuur. Servers zijn overbelast, GPU’s te schaars en onderhoud vraagt meer tijd dan onderzoekers hebben.

Het gevolg? Ideeën blijven langer op papier dan in de praktijk, en baanbrekende ontdekkingen lopen vertraging op.

|

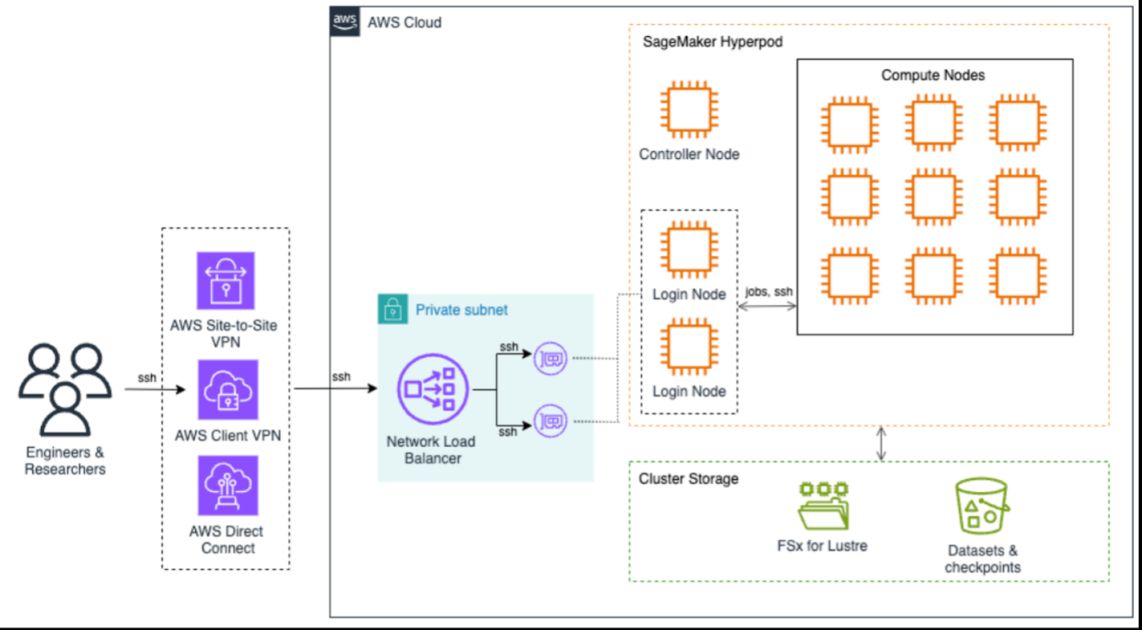

Accelerating HPC and AI research in universities with Amazon SageMaker HyperPod | Amazon Web ServicesIn this post, we demonstrate how a research university implemented SageMaker HyperPod to accelerate AI research by using dynamic SLURM partitions, fine-grained GPU resource management, budget-aware compute cost tracking, and multi-login node load balancing—all integrated seamlessly into the SageMaker HyperPod environment. |

Een nieuwe versneller van Amazon

Om die knelpunten weg te nemen, introduceert Amazon Web Services SageMaker HyperPod: een volledig beheerde HPC-omgeving, speciaal ontworpen voor universiteiten en onderzoeksinstellingen. In plaats van zelf honderden GPU’s te installeren en onderhouden, krijgen onderzoekers directe toegang tot een schaalbare cloudoplossing met de nieuwste versnellers, zoals de NVIDIA H100 en A100.

Hierdoor kunnen experimenten sneller starten, modellen groter worden getraind en kosten beter worden beheerd.

|

Introducing auto scaling on Amazon SageMaker HyperPod | Amazon Web ServicesIn this post, we announce that Amazon SageMaker HyperPod now supports managed node automatic scaling with Karpenter, enabling efficient scaling of SageMaker HyperPod clusters to meet inference and training demands. We dive into the benefits of Karpenter and provide details on enabling and configuring Karpenter in SageMaker HyperPod EKS clusters. |

Slimme verdeling, eerlijke toegang

In plaats van een vaste verdeling van GPU’s, werkt HyperPod met dynamische partities. Onderzoekers delen GPU-kracht via slimme regels, zodat iedereen eerlijke toegang krijgt. Dit betekent dat een promovendus die net begint niet langer hoeft te wachten tot een hoogleraar klaar is met een groot experiment.

Daarnaast houdt de omgeving zelf toezicht op het gebruik: idle sessies worden automatisch afgesloten en resources worden vrijgegeven zodra een job klaar is.

|

Announcing the new cluster creation experience for Amazon SageMaker HyperPod | Amazon Web ServicesWith the new cluster creation experience, you can create your SageMaker HyperPod clusters, including the required prerequisite AWS resources, in one click, with prescriptive default values automatically applied. In this post, we explore the new cluster creation experience for Amazon SageMaker HyperPod. |

Geen zorgen meer over kosten en toegang

Een ander groot voordeel is de transparantie in kosten. Dankzij tagging per project en koppeling met AWS Budgets weten universiteiten precies hoeveel onderzoeksgroepen uitgeven. Alerts voorkomen dat budgetten ongemerkt overschreden worden.

Ook de toegang verloopt soepel: HyperPod kan direct worden gekoppeld aan de bestaande Active Directory van een universiteit. Onderzoekers loggen in met hun vertrouwde gegevens en krijgen automatisch de juiste rechten en limieten toegewezen.

De focus terug naar de wetenschap

Wat vroeger weken duurde aan installatie en onderhoud, wordt nu met een druk op de knop geregeld. HyperPod neemt het zware werk uit handen, zodat onderzoekers hun energie kunnen steken in waar het écht om draait: nieuwe algoritmes, snellere modellen en wetenschappelijke doorbraken.

In de collegezalen klinkt daardoor een ander geluid: minder frustratie, meer vooruitgang.

|

Train and deploy models on Amazon SageMaker HyperPod using the new HyperPod CLI and SDK | Amazon Web ServicesIn this post, we demonstrate how to use the new Amazon SageMaker HyperPod CLI and SDK to streamline the process of training and deploying large AI models through practical examples of distributed training using Fully Sharded Data Parallel (FSDP) and model deployment for inference. The tools provide simplified workflows through straightforward commands for common tasks, while offering flexible development options through the SDK for more complex requirements, along with comprehensive observability features and production-ready deployment capabilities. |