De nieuwste studie van OpenAI – gepubliceerd op 5 september 2025 – legt bloot waarom taalmodellen hallucineren: niet uit kwaadaardigheid, maar omdat hun manier van trainen en evalueren gokken bevoordeelt boven eerlijk toegeven dat ze het antwoord niet weten.

Wat zijn hallucinations volgens OpenAI?

“Hallucinaties” zijn plausibel klinkende, maar feitelijk foutieve beweringen die taalmodellen vol vertrouwen genereren. Zelfs bij ogenschijnlijk simpele vragen, zoals iemands verjaardag of een titel van een proefschrift, kunnen de modellen meerdere onjuiste antwoorden opnoemen, elk met zelfverzekerdheid.

What Are AI Hallucinations? Why Chatbots Make Things Up, and What You Need to KnowAI models can confidently generate information that looks plausible but is false, misleading or entirely fabricated. Here's everything you need to know about hallucinations. |

Training en evaluatie: de aanstichters

Net als bij een meerkeuzetest waar gokken soms beloond wordt, zorgt de opzet van AI-evaluaties ervoor dat modellen sneller geneigd zijn te gokken dan onzekerheid te tonen. Een “ik weet het niet” levert nul punten op, terwijl een geblinddoekt gokje soms toch raak kan zijn. Daardoor leren modellen impliciet om zekerheid te projecteren, zelfs als die er niet is.

|

Preventing AI Hallucination In Content Marketing: Guide For Businesses ReleasedPreventing AI Hallucination In Content Marketing: Guide For Businesses Released |

Statistische redenatie achter hallucinaties

Hallucinaties komen voort uit het kernprincipe van taalmodellen: voor elk volgend woord voorspellen wat het meest waarschijnlijk is, op basis van enorme hoeveelheden tekst. Patronen zoals spelling of haakjes zijn voorspelbaar; willekeurige, zeldzame feiten zijn dat niet. Daarom “bedenkt” het model deze feiten wanneer het informatie mist.

OpenAI says ChatGPT will always make things up, but it could get better at admitting uncertaintyAI systems like ChatGPT will always make things up, but they may soon get better at recognizing their own uncertainty. |

Misvattingen onderuitgehaald

De onderzoekers weerleggen enkele hardnekkige misvattingen:

- Verkeerd: Hogere nauwkeurigheid betekent geen hallucinaties meer.

Feit: Sommige vragen zijn per definitie onbeantwoordbaar; 100 % nauwkeurigheid is niet haalbaar. - Verkeerd: Enkel grote modellen kunnen hallucinaties vermijden.

Feit: Kleinere modellen kunnen makkelijker hun beperkingen erkennen en dus minder hallucineren. - Verkeerd: Hallucinaties zijn mystieke bugs.

Feit: Er is een duidelijk statistisch mechanisme dat hen verklaart. - Verkeerd: Specifieke anti-hallucinatie-evaluaties helpen voldoende.

Feit: Zodra de hoofdscoreborden alleen op nauwkeurigheid focussen, overheerst de stimulans tot gokken.

|

Why AI Chatbots Still Hallucinate: Researchers Trace Errors to Training Data Gaps and Misaligned BenchmarksAI chatbots hallucinate because training and testing methods reward confident guesses over uncertainty, researchers reveal. |

Wat is de oplossing?

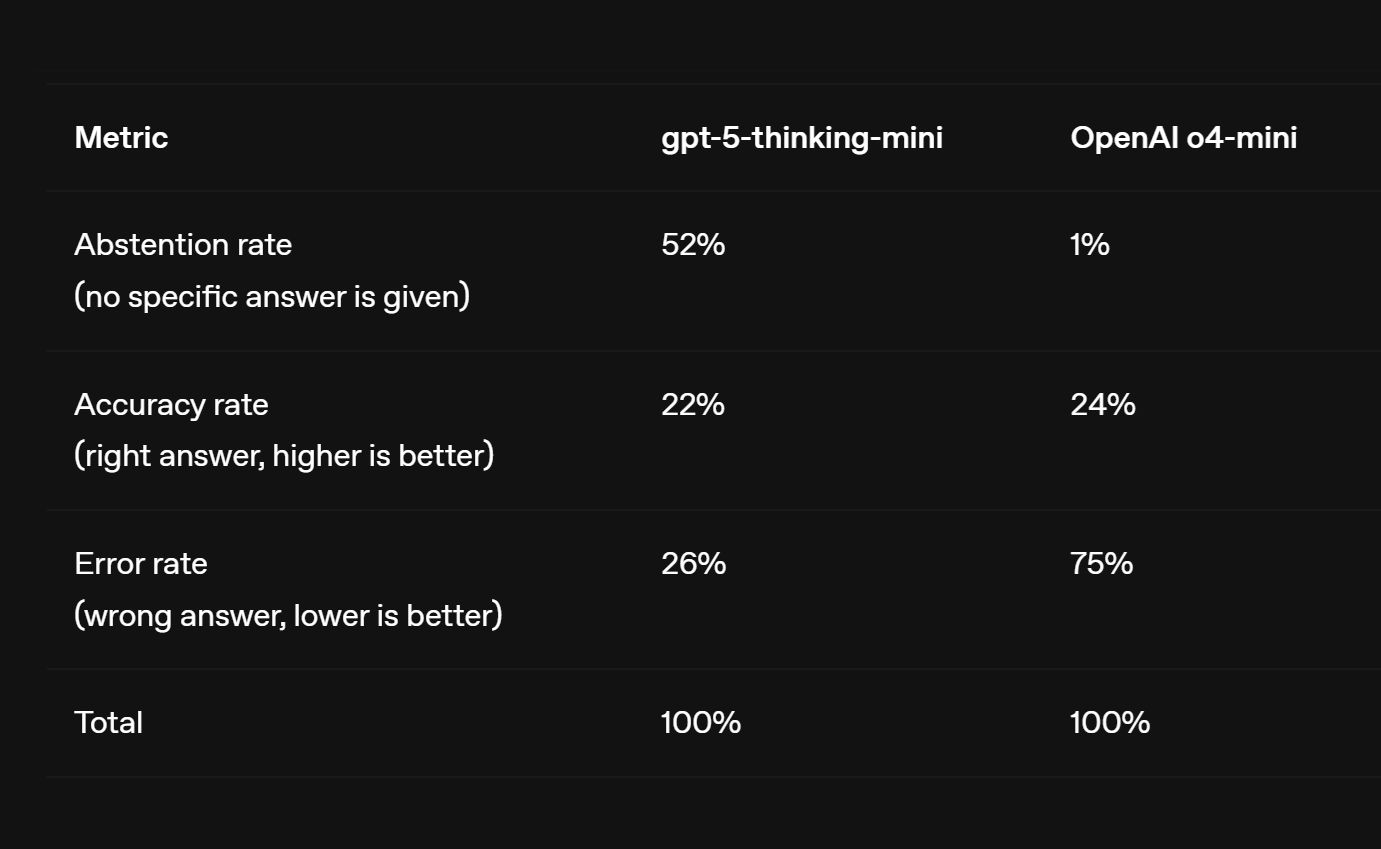

De sleutel? Evaluaties herontwerpen zodat ze onzekerheid belonen in plaats van straffen. Net zoals sommige examens incorrecte antwoorden negativ bepunten of voorzichtigheid belonen, zouden AI-scoreborden “partiële punten” moeten geven aan antwoorden waarin modellen hun onzekerheid aangeven.

Why AI chatbots hallucinate, according to OpenAI researchersOpenAI researchers claim they've cracked one of the biggest obstacles to large language model performance — hallucinations. |

De strijd tegen hallucinaties gaat niet alleen over betere modellen, maar vooral over eerlijkere, genuanceerdere evaluaties. OpenAI toont aan dat hallucineren een logisch gevolg is van huidige trainings- en testmethodes – en dat we kunnen kiezen voor grotere betrouwbaarheid door het systeem heen aan te passen.

|

Why do AI chatbots ‘hallucinate’? And why they will never be 100% accurate? - CNBC TV18Artificial intelligence (AI) chatbots are increasingly being used for almost everything, from customer service to writing assistance and developers using them to generate codes. Yet, there is one puzzling flaw that persists -- they present completely wrong information with absolute confidence. In the study titled: 'Why Language Models Hallucinate', authored by researches Adam Tauman Kalai, Ofir Nachum, Edwin Zhang all from OpenAI and Santosh S Vempala of Georgia Tech, released on September 4, 2025, together studied this issue in depth and published the findings that shed light on why does this happen and how it could be addressed. |