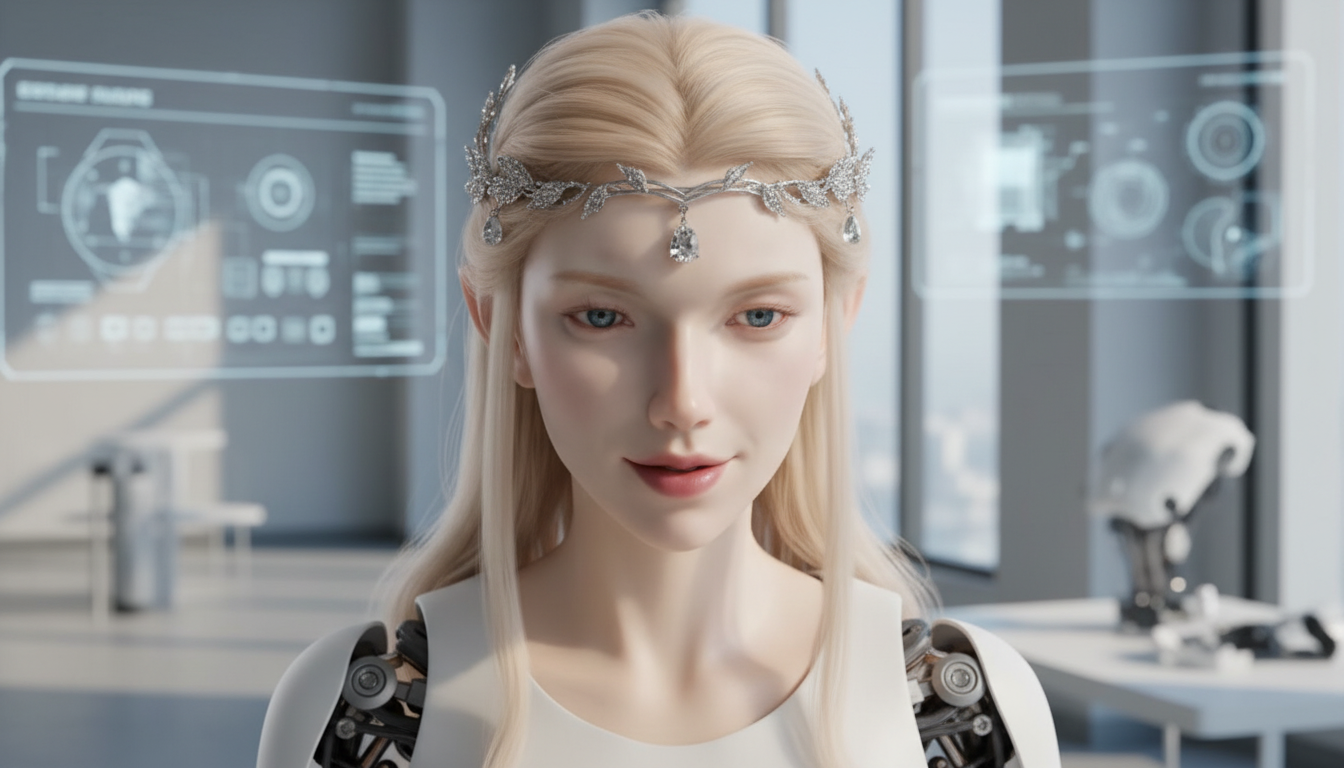

Robot Elf V1: Een gezicht vol emotie

In Shanghai heeft het technologiebedrijf AheadForm een humanoïde robot ontwikkeld die eruitziet én reageert als een mens. De Elf V1 kan niet alleen praten, maar ook zijn ogen bewegen, emoties tonen en non-verbale signalen van mensen interpreteren.

Anatomie van een bijna-mens

Elf V1 beschikt over een geavanceerd systeem met 30 “gezichtsspieren” die worden aangestuurd door micro-motoren zonder borstels. Dankzij een controlemechanisme met hoge precisie en het gebruik van bionisch huidmateriaal zijn de gelaatsuitdrukkingen bijna niet te onderscheiden van menselijke emotie. De ontwikkelaars proberen bewust het “uncanny valley” effect te vermijden — dat ongemakkelijke gevoel dat opkomt wanneer iets er nét-niet natuurlijk uitziet — door dynamische expressies te simuleren en emoties te genereren op basis van de context.

|

China builds humanoid robot with realistic eye movements, bionic skinNamed Elf V1, the advanced bionic humanoid robot can perceive the world, communicate, learn, and interact intelligently with its surroundings. |

Kunstmatige intelligentie als kapstok voor interactie

Naast de hardware is de software minstens zo cruciaal. Elf V1 integreert Large Language Models (LLM’s) en Vision-Language Models (VLM’s), waardoor de robot zintuiglijke input én taal verwerkt om real-time te leren en zich aan te passen. Dit stelt de robot in staat niet enkel te reageren op gesproken input, maar ook lichaamstaal, emotionele cues en de omgeving mee te nemen in zijn gedrag.

Naar een plek in het dagelijkse leven

AheadForm voorziet dat deze robots in de nabije toekomst kunnen worden ingezet als assistenten, metgezellen of hulpen in uiteenlopende sectoren. De ambitie is dat de grens tussen mens en machine vervaagt — en mensen op een meer natuurlijke, intuïtieve manier met robots kunnen communiceren. Met name de gezichtsuitdrukkingen — beweging van ogen, synchrone spraak en emotie-overdracht — zijn ontworpen om de afstand tussen menselijke en robotinteractie te verkleinen.