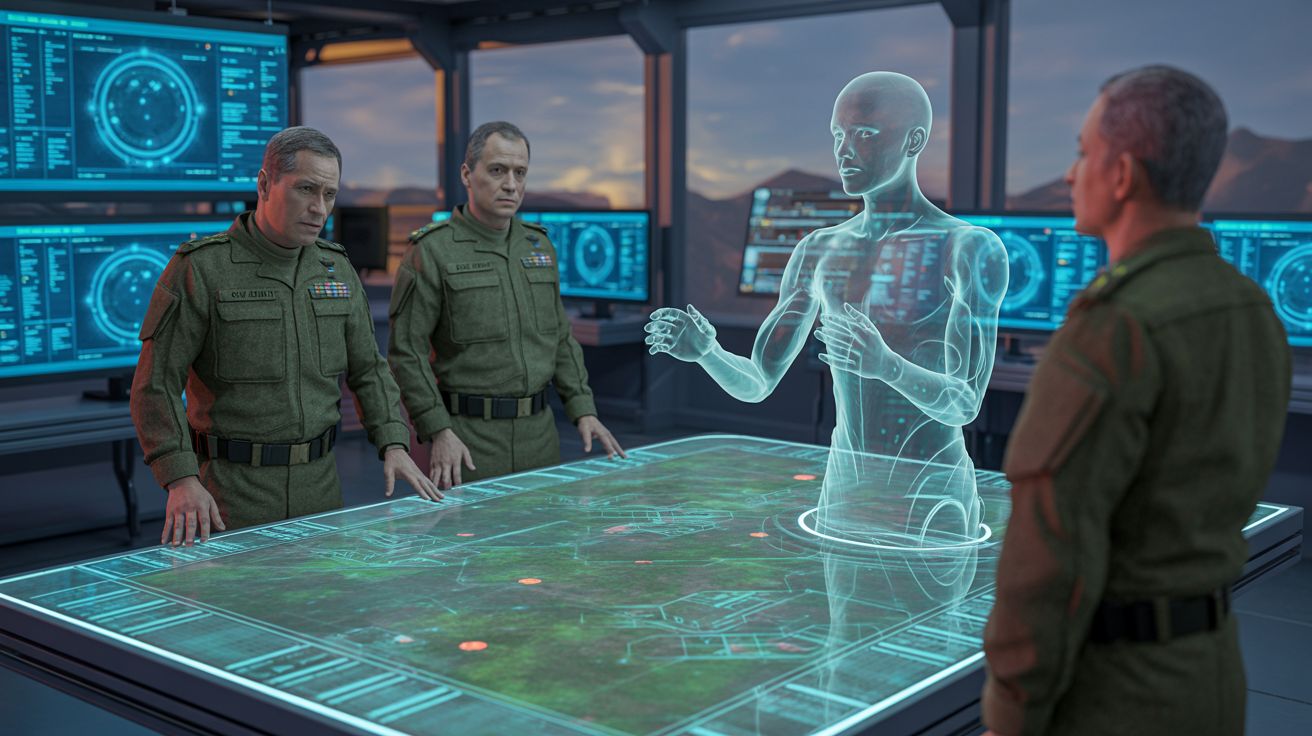

In de hedendaagse krijgsvoering sluipt een ongeziene uitdaging binnen: geavanceerde kunstmatige intelligentie (AI) die beslissingen suggereert waar zelfs de meest doorgewinterde generaals met het hoofd over moeten krabben. Toch hangt de uitkomst van veldslagen steeds vaker af van zulke suggesties — beslissingen die lijken te komen van “alien oracles”, van buiten onze menselijke logica.

Die ongelijksoortige intelligentie plaatst militaire leiders voor een dilemma: durven ze blind op AI-aanbevelingen te vertrouwen, ook als de onderliggende redenering ondoorzichtig is?

Alien Oracles: Military Decision-Making with Unexplainable AIWould you stake thousands of lives on a strategy that, by every measure of your training and experience, seems destined for catastrophic failure? In 1863, |

De paradox van strategisch inzicht versus verklaarbaarheid

De onderliggende wetenschappelijke spanningsboog is eenvoudig maar schrijnend: naarmate AI slimmer, creatiever en strategisch krachtiger wordt, wordt het voor mensen moeilijker te begrijpen hoe en waarom een bepaalde stap is gekozen.

- AI kan miljarden scenario’s doornemen, subtiele patronen detecteren en onconventionele routes uitstippelen die voor mensen intuïtief onbegrijpelijk zijn.

- Pogingen om achteraf verklaringen te construeren (post hoc rationales) leren ons zelden de “echte” denktrap van de AI, en kunnen zelfs misleidend zijn.

In plaats van volledig te vertrouwen op begrijpelijkheid, pleiten auteurs als Andrew Hill en Dustin Blair om vertrouwen te baseren op kalibratie tussen meerdere AI-agents: wanneer verschillende AI’s tot vergelijkbare aanbevelingen komen, kan dat een veiligheidsnet zijn voor menselijke commanders.

|

How AI safety took a backseat to military moneyAI safety expert Heidy Khlaaf comes on Decoder to discuss OpenAI and other firms’ decision to become defense contractors. |

Van veiligheidsidealen naar wapentechnologie

Tegelijkertijd verschuift het maatschappelijke debat: AI-bedrijven die ooit nadrukkelijk afstand namen van militaire toepassingen, gaan juist wél samenwerken met defensie.

- OpenAI verwijderde in 2024 een verbod op “militaire en oorlogsvoering” toepassingen in haar gebruiksvoorwaarden en sloot een contract van honderden miljoenen dollars met het Amerikaanse ministerie van Defensie.

- Ook Anthropic, dat bekendstaat om haar focus op AI-veiligheid, werkt samen met defensiegerelateerde partijen zoals Palantir.

- Grote technologiebedrijven zoals Microsoft, Amazon en Google betreden eveneens de arena van defensie-AI, ondanks de ethische discussies binnen hun medewerkerskorpsen.

Wat betekent dit voor de toekomst? Dat het ideaal om AI veilig, zorgvuldig en ethisch te gebruiken steeds zwaarder onder druk komt te staan.

De verborgen risico’s van data op het slagveld

Nog een ander deel van het puzzle zit in de gegevens waarop AI traint — met name de grote volumes data die verzameld worden tijdens militaire operaties.

|

Hidden risks in AI’s dependence on battlefield data | TechnologyWith the rapid integration of AI systems into surveillance, logistics, and combat decision-making, access to accurate, high-quality data can determine operational advantage. Defence policies in NATO and Five Eyes nations have begun to recognise this, with the United States leading in leveraging battlefield data for AI research and development. |

De studie “Ethical, legal, and social challenges of data economy in defence: the case of battlefield data” waarschuwt voor:

- Privatisering en afhankelijkheid: wanneer bedrijven de rol krijgen om slagvelddatasets te verzamelen, te analyseren en te bewaren, riskeren overheden afhankelijkheid en verlies van controle.

- Dat soevereiniteit: wie beslist wie toegang heeft tot welke data? Zeker binnen internationale allianties (zoals NAVO) is dit een gevoelig punt.

- Grootte en gevoeligheid van gegevens: massale data-verzameling kan botsten met privacyrechten en ethische grenzen.

- Versnippering en inconsistentie: uiteenlopende systemen, standaarden en archieven maken het lastig om betrouwbare, samenhangende datasets te produceren.

De voorgestelde remedy? Een “clubgood”-model: defensieorganisaties fungeren als beheerders van data, met gereguleerde toegang voor bondgenoten en geautoriseerde partijen, én duidelijke auditraamwerken voor accountability.

|

Artificial Intelligence in War and Peace: Experts Warn of New ThreatsAt the AI Summit 2025 in Warsaw, experts explored how artificial intelligence is reshaping culture, security, and modern warfare. |

Cultuur, intellect en ethiek in het AI-tijdperk

Tijdens de AI Summit 2025 in Warschau werd ook gesproken over de bredere implicaties van AI op cultuur, denken en waarden.

- Experts waarschuwden dat afhankelijkheid van AI menselijke capaciteiten — zoals abstract en symbolisch denken — kan verzwakken.

- Tegelijkertijd is het debat of AI ons denken “vervult” dan wel “vervangt” — sommige sprekers betoogden dat mensen al lang niet alles écht begrijpen, maar werken op basis van analogieën en intuïtie. AI dwingt ons misschien tot een nieuw soort cognitieve cultuur.

- Verder werd een waarschuwend licht geworpen op de snelheid van technologische ontwikkeling tegenover de traagheid van juridische en ethische kaders.

- In militaire toepassingen wordt AI tegelijk wapen én schild: elk nieuw systeem roept tegenruchten op of biedt aanknopingspunten voor tegenmaatregelen.

Het spanningsveld tussen innovatie en ethiek is scherper dan ooit.

Tussen vertrouwen en onzekerheid

Militaire besluitvorming in het AI-tijdperk balanceert op een smalle richel: blind vertrouwen of verlamming bij scepsis.

Van de “alien oracles” die onbekende strategieën fluisteren, tot defensiecontracten met AI-bedrijven, van sluipende datarisico’s tot culturele cognitieve transformaties — het geheel is niet langer een technisch vraagstuk alleen, maar een existentiële uitdaging.

Hoe kunnen staten, strijdkrachten en samenlevingen navigeren in een wereld waarin AI meer is dan een instrument — misschien een partner, rival, én raadgever tegelijk?

De sleutel zal liggen in mechanismen van verifiëring (meerdere AI’s, consensus, audits), streng databeheer, ethisch toezicht en een voortdurende dialoog over onze rol als mens in een wereld waarin intelligentie (kunstmatig) de duimschroef voelt.