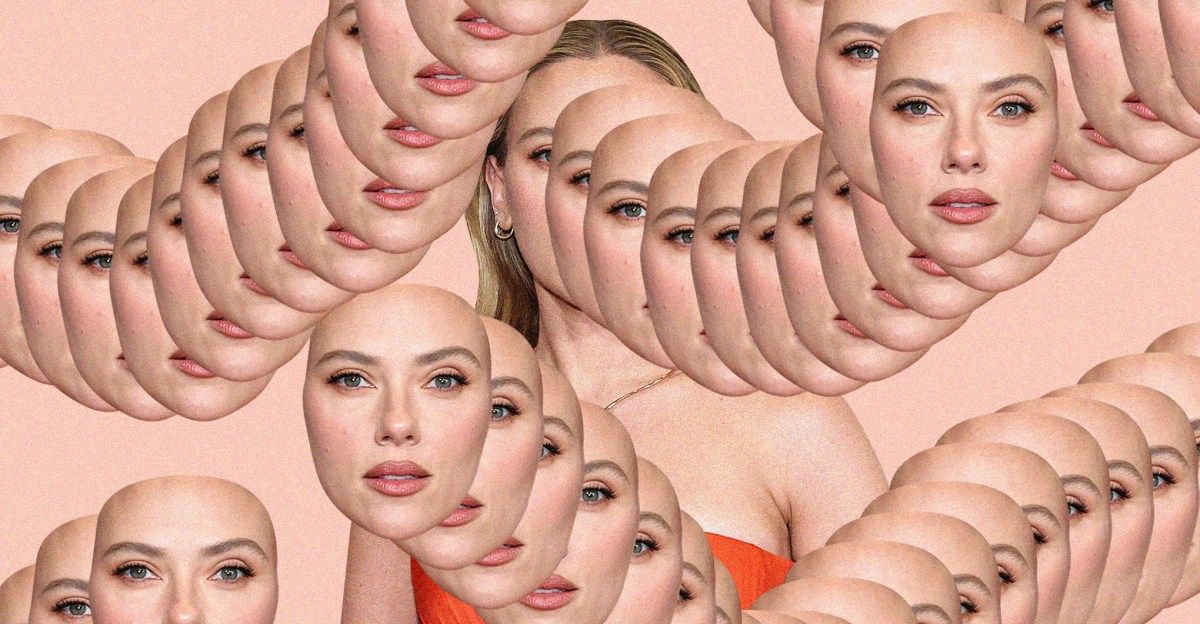

In een tijd waarin kunstmatige intelligentie (AI) razendsnel haar intrede doet in videogeneratie, deepfakes en gelijkenissen van mensen, ontstaat er een groeiend juridisch spanningsveld. Dit artikel beschrijft hoe gezichtsherkenning en het gebruik van iemands uiterlijk in AI-diensten het speelveld van rechten en regulering drastisch veranderen — en welke rol AI zelf daar in speelt.

Hoe het begon

De discussie wordt aangewakkerd door de track “Heart on My Sleeve”, een door AI nagebootste prestatie die de stem van Drake nabootste zonder expliciete toestemming. Daarmee werd een grens bereikt: het ging niet om directe copyrightinbreuk, maar om het gebruik van iemands gelijkenis — iets waar de traditionele auteurswetgeving nauwelijks op was ingericht. In het verleden werd “likeness law” vooral gebruikt door beroemdheden om ongeautoriseerde endorsements of parodieën aan te vechten.

|

The next legal frontier is your face and AIThings are getting weird. |

Waar staan we nu?

Het juridische landschap is versnipperd. Er bestaat geen federale Amerikaanse wet die gebruik van iemands gelijkenis centraal regelt — het is een lappendeken van staten. Tegelijkertijd heeft OpenAI met haar videogenerator Sora een stap gezet die velen als provocatie beschouwen: de service laat gebruikers realistische video’s creëren van levende of overleden personen, soms zonder hun toestemming. Opmerkelijk is dat zelfs mensen die formeel instemden met hun gelijkenis zich ongemakkelijk voelden bij het eindresultaat — bijvoorbeeld vrouwen die niet wilden dat hun afbeelding in fetishachtige of ongepaste context verscheen.

Wat staat er op het spel?

De gevolgen zijn ingrijpend:

- Toestemming of het ontbreken daarvan krijgt een nieuwe betekenis in het AI-tijdperk.

- Publieke figuren én reguliere burgers kunnen worden afgebeeld in contexten die zij nooit goedkeurden.

- Platforms zoals YouTube of andere contentdiensten staan voor de vraag hoe zij omgaan met deze nieuwe werkelijkheid — en in hoeverre zij aansprakelijk zijn voor AI-gegenereerde gelijkenissen.

- Vrijheid van meningsuiting staat onder druk: sommige voorstellen tot regulering — zoals het Amerikaanse NO FAKES Act — worden door voorstanders gezien als noodzakelijk, maar door critici als een potentieel instrument van censuur.

De rol van AI

AI staat niet louter aan de rand; zij is juist de motor van deze verandering. Generatieve modellen maken het mogelijk om gelijkenissen, stemmen en beelden van personen te manipuleren op schaal. Het versnelt de vraag: wanneer is een beelding van een persoon nog fictie, en wanneer zijn we juridisch en ethisch in een grijze zone beland? Het is een vraag die niet alleen technologisch is, maar diep verankerd is in rechten, maatschappij en cultuur.

Wat kan er gebeuren?

De komende tijd kunnen we het volgende verwachten:

- Nieuwe regelgeving die specifiek gelijkenisrechten includeert — met name in landen/regio’s buiten de VS.

- Platforms die vanuit eigen beleidsregels strengere controles inbouwen op AI-gegenereerde beelden van personen.

- Een groeiende rechterlijke jurisprudentie waarin gevallen rondom gelijkenis en AI centraal staan.

- Publieke debatten over wat het betekent om iemands “beeldidentiteit” digitaal te bezitten of te verhandelen — en of we eigenlijk wel voorbereid zijn op deze transitie.

Het gebruik van jouw gezicht, stem of gelijkenis in AI-gegenereerde content is geen futuristisch sciencefiction-scenario meer, maar realiteit. De juridische lijnen worden opnieuw getrokken – en AI staat in het middelpunt van die herdefiniëring. Voor zowel bedrijven, beleidsmakers als burgers geldt: het is tijd om scherp na te denken over wie controle heeft over digitale persoonlijkheden — en hoe we die controle behouden.