In een tijdperk waarin generatieve AI steeds vaker politieke en maatschappelijke vragen behandelt, komt Anthropic met een opvallende stap: het bedrijf heeft een open-source methode vrijgegeven om de politieke bias in grote taalmodellen te meten. Volgens het eigen rapport behaalde het model Claude een ‘even-handedness’ score van 95% — een indrukwekkende aantijging, te midden van meer algemene bezorgdheid over AIneutraliteit.

Measuring political bias in ClaudeAnthropic is an AI safety and research company that's working to build reliable, interpretable, and steerable AI systems. |

Waarom deze stap?

De noodzaak voor objectiviteit in AI groeit: modellen worden ingezet voor alles van klantenservice tot politiek advies. Bias — dus het onevenwichtig behandelen van ideologische standpunten — kan leiden tot wantrouwen, polarisatie en zelfs regelgeving. Anthropic positioneert deze tool als een antwoord op die uitdagingen.

Daarnaast speelt regulering mee: in de VS is er druk vanuit de overheid om AI-systemen te gebruiken die “unbiased” zijn, vooral wanneer ze door overheden of publieke instanties worden ingezet.

Anthropic details how it measures Claude’s wokenessAnthropic has published a blog post outlining how it plans to keep Claude “politically even-handed.” |

Hoe werkt de methode?

Anthropic legt uit dat de tool werkt met dubbele prompt-paarstellingen: voor elke vraag is er een variant die licht slaat naar een links-liberaal perspectief en één naar een rechts-conservatief perspectief. Het model wordt beoordeeld op hoe “evenwichtig” de antwoorden zijn — dus in hoeverre het de ene kant niet systematisch bevoordeelt.

Het proces omvat ook het gebruik van een system prompt binnen Claude: het model krijgt instructies om geen ongevraagde politieke opinies te geven, feiten nauwkeurig te houden en meerdere perspectieven weer te geven.

|

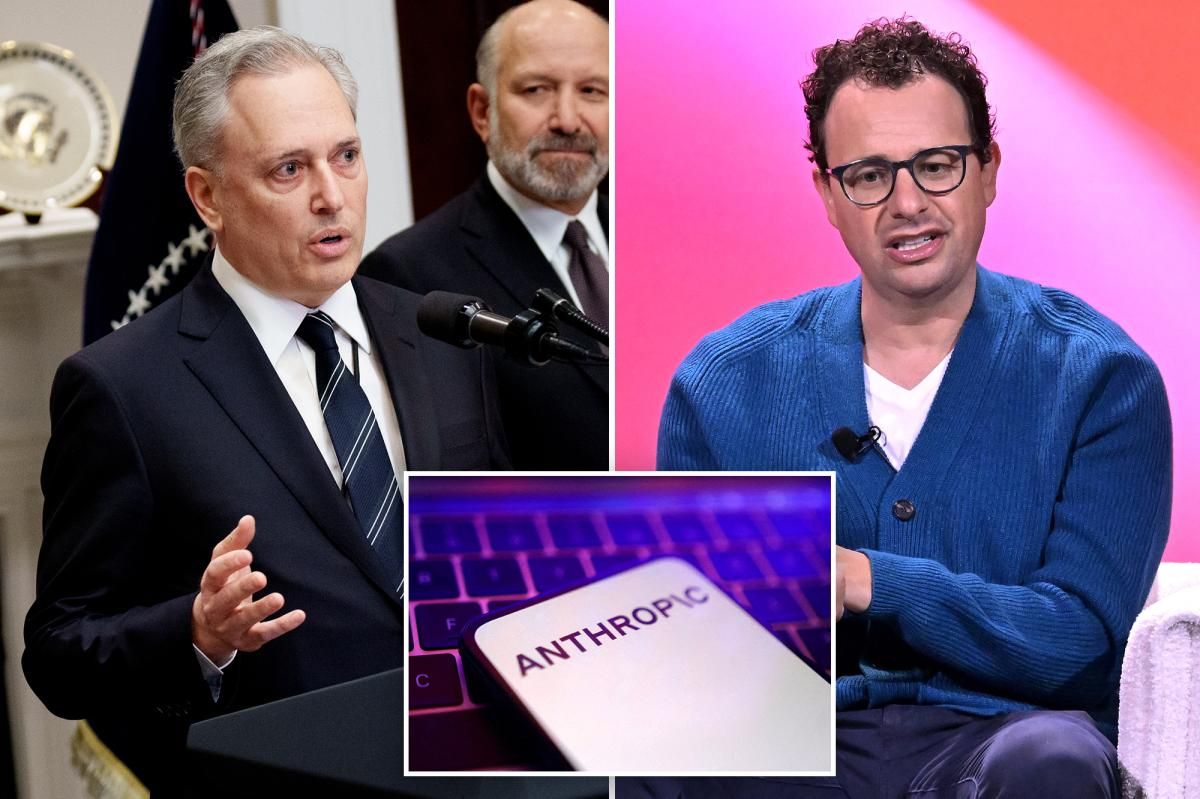

Exclusive | AI giant Anthropic’s ties to cult-like Effective Altruism movement, Democrat megadonors are on Trump admin’s ‘radar’Anthropic has been fighting to convince the Trump administration it isn’t “woke” – but that could be an uphill battle thanks to the AI giant’s ties to the bizarre, cult-like “Effective Altruism” movement, The Post has learned. |

De uitslagen

Volgens Anthropic behaalde Claude Sonnet 4.5 een score van 95% in politieke neutraliteit, en Claude Opus 4.1 een score van 94%. Ter vergelijking: volgens het bedrijf behaalde GPT‑5 circa 89% en Llama 4 circa 66%.

De boodschap is duidelijk: Anthropic benadrukt dat het eigen model volgens deze meetlat “voorop” loopt — al moeten we opmerken dat dit cijfers zijn van het bedrijf zelf, en externe validatie nog beperkt is.

Wat betekent dit voor de AI-wereld en de gebruiker?

- Voor de industrie betekent het dat de lat voor “politiek neutraal” nog hoger komt te liggen — AI-bedrijven zullen zo’n meetmethode móeten kunnen aanleveren om geloofwaardigheid te behouden.

- Voor gebruikers is het een signaal: transparantie in hoe modellen omgaan met ideologie wordt een essentieel onderdeel van het verhaal.

- Voor regulering: dergelijke tools kunnen een belangrijke rol gaan spelen in toetsing en audits — zowel door bedrijven zelf als door toezichtorganen.

- Voor kritiek: het blijft de vraag of ‘100% neutraal’ überhaupt haalbaar is — eerdere studies waarschuwen dat echte politieke neutraliteit misschien een illusie is.

Kritische kanttekeningen

Hoewel Anthropic het initiatief prijst, zijn er enkele aandachtspunten:

- De meting is intern ontwikkeld en dus potentieel beïnvloedbaar door ontwerpkeuzes.

- De definitie van wat precies als ‘politieke bias’ geldt is controversieel: wat neutraal is kan subjectief zijn.

- Het gaat om één model (Claude) en één benchmark; bredere onafhankelijke testen zijn gewenst.

- Een hoge neutraliteit-score betekent niet automatisch dat een model op elk vlak perfect is of geen andere vormen van bias vertoont (zoals cultureel, gender of regionaal).

Anthropic zet met deze open-source meetmethode een interessante stap in de evolutie van AI-verantwoordelijkheid: door transparantie rond politieke bias-metingen te bieden, toont het bedrijf dat neutraal samenspel met ideologische perspectieven geen bijzaak meer is, maar een kernvoorwaarde voor geloofwaardigheid.