Google zet een forse nieuwe stap in de wereld van kunstmatige intelligentie. Het kondigt de zevende generatie van zijn tensor-verwerkingsunits (TPU), genaamd “Ironwood”, aan — een chip die ontworpen is om zowel AI-training als realtime inferentie op grote schaal tot een nieuw niveau te tillen. Met prestatiecijfers die tot 10× hoger liggen dan eerdere generaties en schalen tot duizenden chips, positioneert Google zich duidelijk als tegenstander van gevestigde spelers in de chipwereld.

Nieuwe prestaties, nieuwe schaal

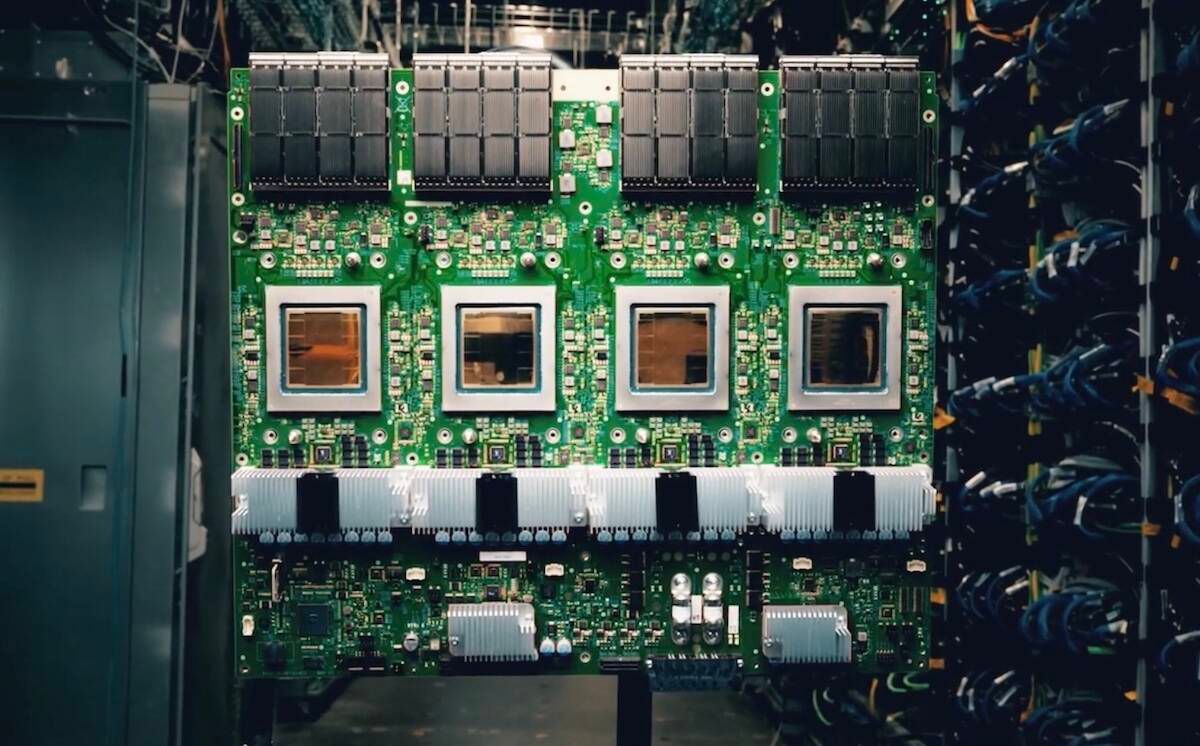

De Ironwood-TPU, aangekondigd door Google, wordt volgens de fabrikant “…our most powerful and energy-efficient custom silicon to date.” Concreet betekent dit:

- Ongeveer 10× hogere piekprestaties in vergelijking met de TPU v5p.

- Meer dan 4× betere prestaties per chip voor zowel training als inferentie versus de vorige generatie TPU v6e (met codenaam “Trillium”).

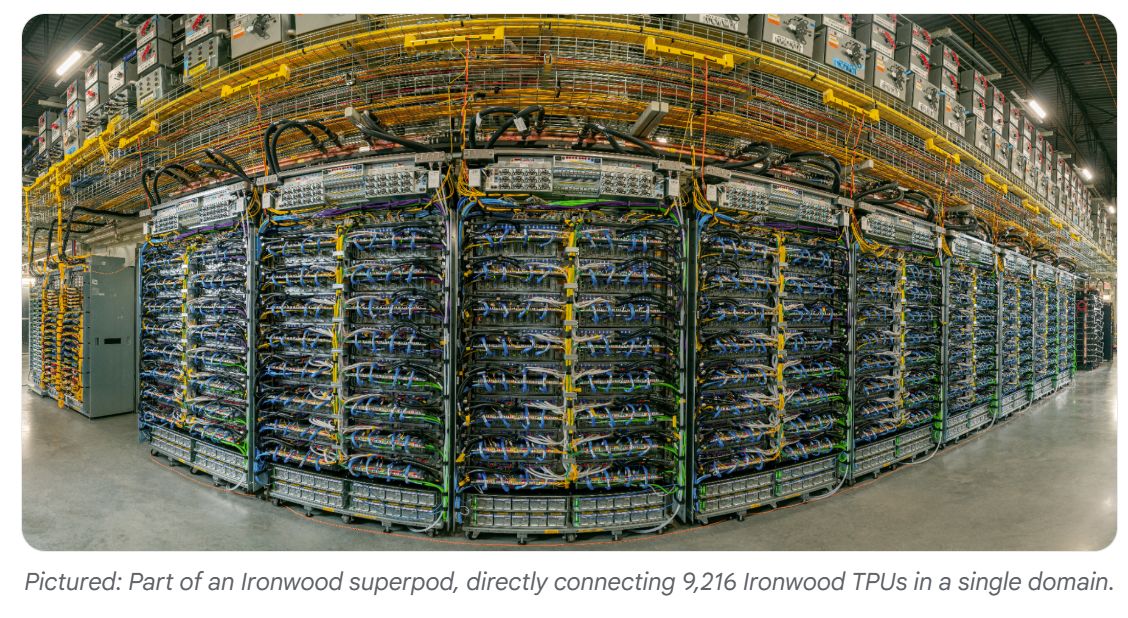

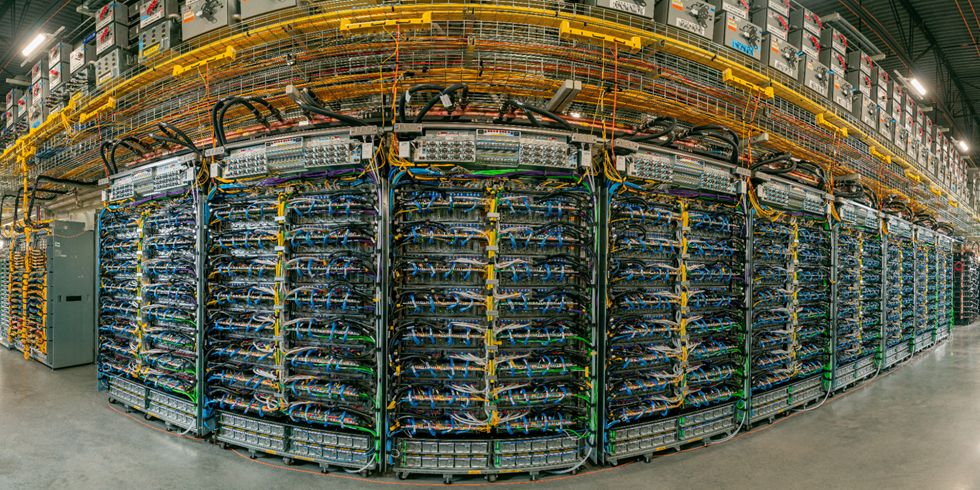

- De infrastructuur ondersteunt pods met tot wel 9.216 chips in één cluster — waarmee schaal écht groot wordt.

Google Cloud's Ironwood ready for general availabilityGoogle Cloud said its seventh generation Tensor Processing Unit (TPU), known as Ironwood, will be generally available soon as the company also outlined new Arm-based Axion instances. The announcement highlights how hyperscalers, primarily Google Cloud and Amazon Web Services, are deploying custom chips for AI workloads to diversify from Nvidia and smooth out price performance |

|

Google Cloud Announces GA of Ironwood TPUs and Axion VMs for AI InferenceGoogle today announced GA on the Google Cloud Platform of three products built on custom silicon built for inference and agentic workloads: - Ironwood, - Read more from Inside HPC & AI News. |

|

TPU v7, Google's answer to Nvidia's Blackwell is nearly here: Chocolate Factory's homegrown silicon boasts Blackwell-level perf at massive scale |

Wat betekent dit voor de AI-infrastructuur?

Voor het blogpubliek van jouw AI en webdesign-blog zijn er enkele duidelijke implicaties:

- Google zet in op “the age of inference” — niet alleen modeltraining, maar realtime gebruik van AI-modellen op enorme schaal.

- Door eigen, op maat gemaakte chips te gebruiken, probeert Google zich los te maken van traditionele GPU-leveranciers en kosten, energie- en schaalvoordelen te behalen.

- Voor bedrijven die generatieve AI, agent-gebaseerde workflows of grote multimodale modellen bouwen, betekent dit dat een vereiste infrastructuur steeds sneller bereikbaar wordt — of in ieder geval aangekondigd wordt — door cloudaanbieders zoals Google.

|

GCP - Announcing Ironwood TPUs General Availability and new Axion VMs to power the age of inference - Cloud bites from the grillToday’s frontier models, including Google’s Gemini, Veo, Imagen, and Anthropic’s Claude train and serve on Tensor Processing Units (TPUs). For many organizations, the focus is shifting from training these models to powering useful, responsive interactions with them. Constantly shifting model architectures, the rise of agentic workflows, plus near-exponential growth in demand for compute, define this […] |

Waarom is dit een strategische zet richting concurrentie?

- Met de Ironwood-TPU begeeft Google zich expliciet in de buurt van de prestaties van de concurrentie (zoals NVIDIA), waardoor de traditionele dominantie van GPU’s in het AI-hardwarelandschap uitgedaagd wordt.

- Door de combinatie van chip-, systeem- en netwerkarchitectuur (zoals optische schakelaars, 3D-mesh interconnects) creëert Google een “AI hypercomputer-stack” die verder gaat dan enkel een betere chip.

- Voor de cloud-markt (en jouw bloglezers die vaak de infrastructuurkant van AI volgen) betekent dit dat de spelregels verschuiven: schaalbaarheid, efficiëntie en kosten per inference-token worden steeds belangrijker.

Uitdagingen & aandachtspunten

Natuurlijk brengt zo’n doorbraak ook vragen en relatieve risico’s met zich mee:

- Hoewel Google indrukwekkende cijfers presenteert, is de daadwerkelijke beschikbaarheid (“general availability”) voor klanten nog “in de komende weken” aangekondigd, dus tijdig in gebruik nemen blijft een operatie.

- Hoe goed third-party modellen (die niet direct door Google zijn ontwikkeld) gebruik kunnen maken van deze infrastructuur, en tegen welke kosten, blijft afwachten.

- Voor organisaties betekent dit een keuze: investeren in eigen hardware (of exclusiviteit via cloud) versus deelnemen aan een steeds competitievere markt. Voor jouw blogpubliek is het interessant om deze verschuivingen in de gaten te houden (zoals prijsdruk, beschikbaarheid, en ecosysteemondersteuning).

Met de aankondiging van de Ironwood-TPU brengt Google een nieuwe fase in voor AI-hardware: het gaat niet meer alleen om groter en sneller trainen, maar om schaalbaar infereren — modellen die écht in de wereld functioneren, op grote schaal en met lage latentie. Voor de wereld van AI-ontwikkeling ligt hier een belangrijk signaal: infrastructuur wordt steeds vaker het strategische wapen. Wie het vroeg inzet, kan voordeel halen — zowel technologisch als economisch.