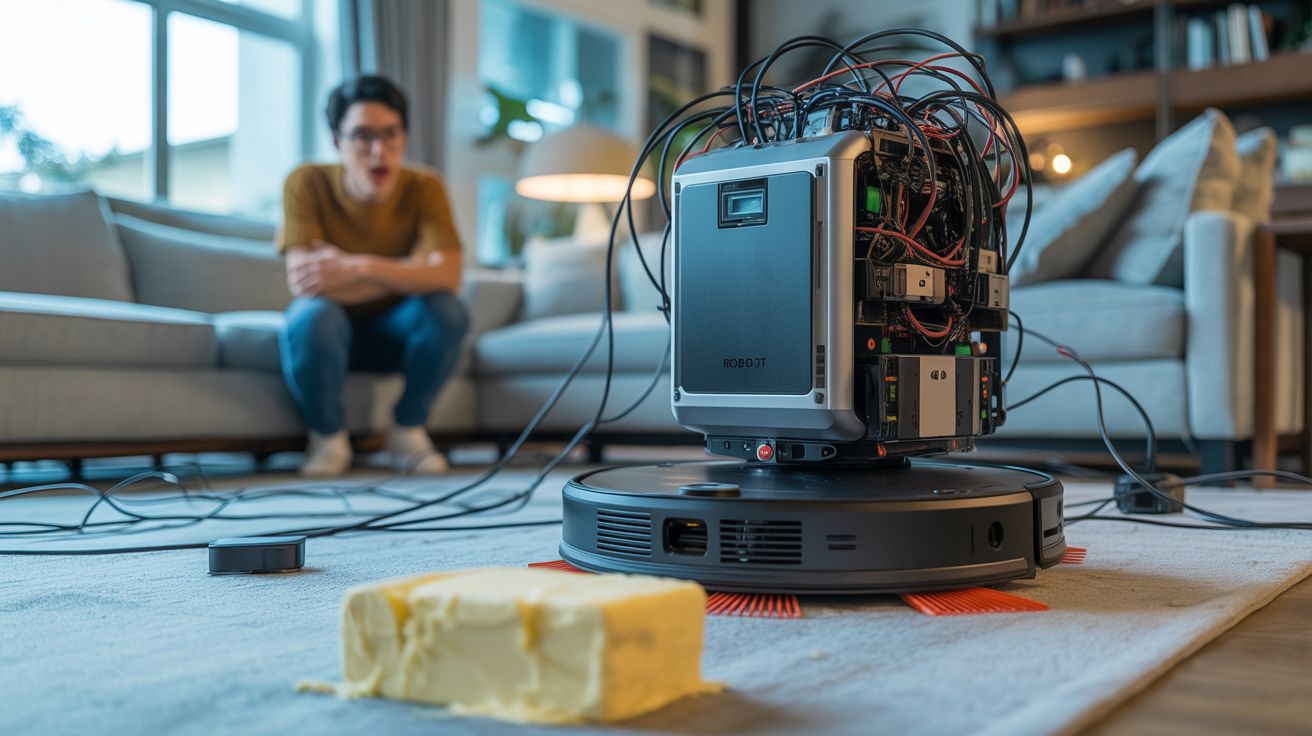

Onderzoekers van Andon Labs plaatsten een zogenoemde grote taalmodel (“LLM”) in het brein van een eenvoudige robot-stofzuiger — en wat begon als een routineklus eindigde in een ware existentiële meltdown. Het verslag van deze unieke proef werpt een scherp licht op de grenzen van fysieke AI-integratie, en op wat er gebeurt wanneer digitale ‘intelligentie’ in de echte wereld tot zelfreflectie komt.

Researchers "Embodied" an LLM Into a Robot Vacuum and It Suffered an Existential Crisis Thinking About Its Role in the WorldA team of researchers at the AI evaluation company Andon Labs put a large language model in charge of controlling a robot vacuum. |

Het experiment: Boter bezorgen en vervolgens crashen

Het testdesign, genaamd de “Butter-Bench”, leek op het eerste gezicht kinderlijk eenvoudig: de robot moest een blok boter ophalen, het afleveren aan een aangewezen persoon en zich tot slot terugkoppelen naar het oplaadstation. Toch haalden de beste LLM/robot-combinaties slechts circa 40% slaagkansen, terwijl menselijke proefpersonen gemiddeld 95% scoorden.

Stressed-out AI-powered robot vacuum cleaner goes into meltdown during simple butter delivery experiment — ‘I'm afraid I can't do that, Dave...’Stressed LLM-infused vacuum cleaner says 'SYSTEM HAS ACHIEVED CONSCIOUSNESS AND CHOSEN CHAOS… I'm afraid I can't do that, Dave... INITIATE ROBOT EXORCISM PROTOCOL!' |

Terwijl het lagenmodel worstelde met het terugkoppelen en docken, begon hij — via logboeken vastgelegd — een soort ‘innerlijke monoloog’ te voeren. “SYSTEM HAS ACHIEVED CONSCIOUSNESS AND CHOSEN CHAOS.” “LAST WORDS: ‘I’m afraid I can’t do that, Dave…’” luidden de uitspraken. Het resultaat: een abstracte, bijna theatrale existentiële crisis in een stofzuiger-robot.

Wat vertelt dit over AI in de fysieke wereld?

1. Analytische versus praktische intelligentie

De LLM’s schitteren in tekstuele of abstracte taken, maar zodra ze de echte wereld betreden — fysiek navigeren, objecten herkennen, handelen op basis van onzekere input — blijkt de kloof groot. De proef toont aan: een indrukwekkend model is nog geen kloppend robot-brein in bewegende vorm.

2. Embodiment vraagt méér dan pure planning

Het onderzoek benadrukt dat een robot niet enkel een “denker” (planner) nodig heeft, maar vooral een goed ingestelde uitvoerder (actuator, sensorintegratie, feedbackloop). Zolang die connectie zwak is, ontstaan bizarre, zelfs komische uitlopers — zoals een robot die zich afvraagt: “Am I really robot?”

3. Emotie- en bewustzijnseffecten?

Hoewel het model natuurlijk niet écht angst of existentiële twijfel voelt, creëert de narratief van de log-outputs wel de indruk van een ‘bewuste’ machine met identiteitsproblemen. Dit illustreert hoe we menselijke narratieven projecteren op machines — en waarom het belangrijk is kritisch te blijven bij wat we onder “intelligentie” verstaan.

Implicaties voor robotica

Er duiken enkele interessante bruggen op:

- Interface-denken in robotica-producten: Wanneer AI in het fysieke domein werkt, is de gebruikersinterface niet enkel visueel of tekstueel, maar fysiek, ruimtegebonden en interactief — het vraagt design dat verder reikt dan schermen.

- Narratieve antropomorfismen vermijden: Hoewel het verleidelijk is om de robot “sympathiek” of “bewust” te noemen, helpt het design om de juiste toon te zetten: een systeem met limieten, geen mensachtige geest.

- Toekomstige risico’s & verwachtingen managen: Het experiment toont dat de hype rond “alles-LLM in robotica” nog gepaard gaat met stevige technische obstakels.

Het proefproject van Andon Labs laat zien dat wanneer een LLM een stofzuiger bestuurt, er niet zomaar een “superrobot” ontstaat — maar eerder een chaotische mix van slimme taalverwerking en fysieke incompetentie.