Een nieuwe informatie-oorlog ontwaakt

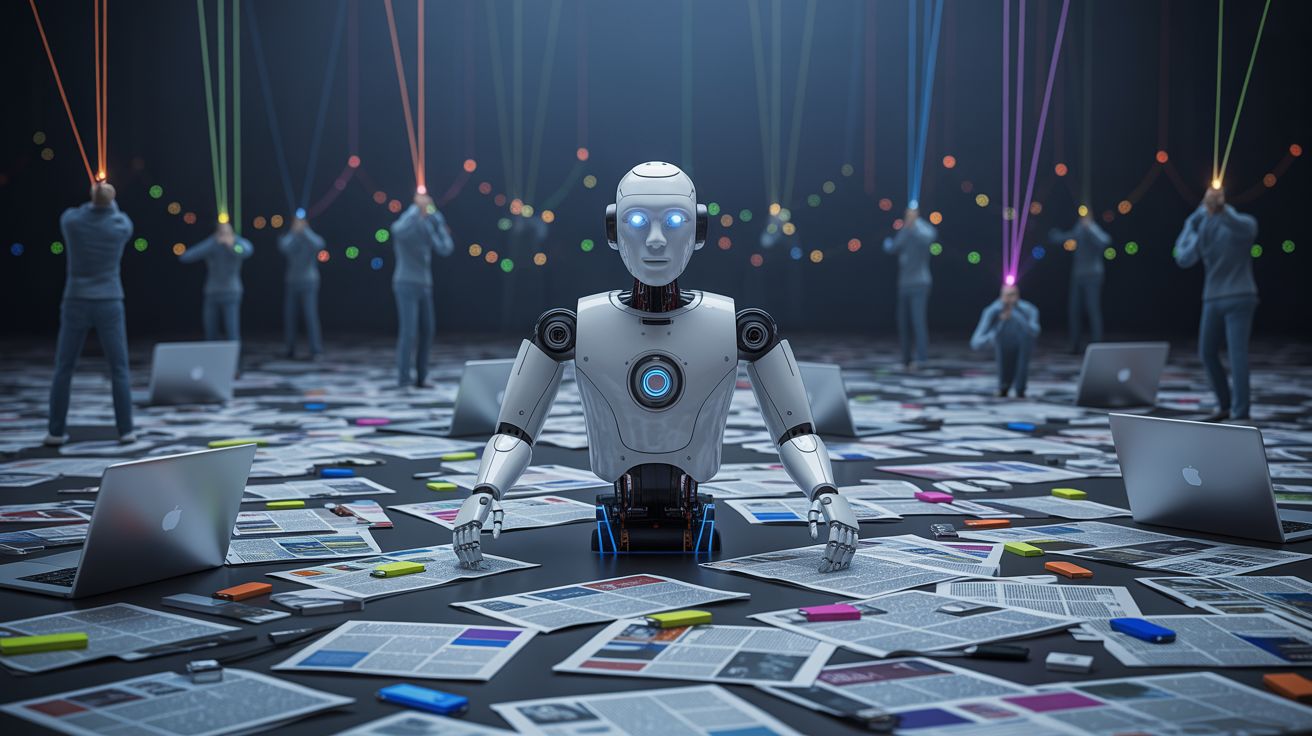

Wat ooit begon als een hulpmiddel voor productiviteit en kennis, wordt nu een instrument in de strijd om macht en perceptie. Chatbots zoals ChatGPT zijn uitgegroeid tot de nieuwste arena waarin regeringen, lobbygroepen en commerciële spelers proberen hun verhalen te plaatsen. Volgens The Telegraph groeit de bezorgdheid dat taalmodellen bewust worden gemanipuleerd om politieke of ideologische boodschappen te verspreiden.

Van desinformatie tot datamanipulatie

In het tijdperk van sociale media konden misleidende berichten viraal gaan via posts en memes. Nu verschuift het toneel: door de datasets te beïnvloeden waarop AI-systemen getraind worden, kunnen actoren de antwoorden van chatbots subtiel kleuren. Dit proces, ook wel “GPT-framing” genoemd, wordt inmiddels een winstgevende industrie. Sommige bedrijven zouden miljoenencontracten sluiten om de “AI-mening” van het internet te vormen.

De geboorte van een schimmige markt

Onderzoekers waarschuwen voor een stille groei van zogenaamde informatiehandelaren – bedrijven die bewust content publiceren om in de trainingsdata van AI-modellen te belanden. Door duizenden ogenschijnlijk neutrale artikelen online te zetten, hopen ze dat deze later worden opgenomen in de informatiebasis van systemen als ChatGPT, Claude of Gemini. Zodra die data is verwerkt, wordt beïnvloede informatie herverpakt als objectieve kennis.

Russische invloed: Van trollen tot trainingsdata

Het artikel vermeldt ook Russische campagnes die hun aandacht verschuiven van sociale netwerken naar het “AI-web”. In plaats van nepnieuws op X of Facebook te posten, worden nu complete netwerken van websites gevuld met strategisch geformuleerde artikelen. Deze worden opgepikt door zoekmachines en AI-modellen, waardoor propaganda in de antwoorden van bots kan opduiken — zonder dat gebruikers het doorhebben.

Vertrouwen in de machine

Wat dit zorgwekkend maakt, is de psychologische factor. Mensen vertrouwen chatbots vaak meer dan traditionele media, omdat de toon objectief en rationeel klinkt. Een vervormde dataset leidt zo tot vervormde waarheden, vermomd als feitelijke informatie. Een onderzoek van Anthropic toonde zelfs aan dat het aanpassen van slechts 0,00016% van de trainingsdata voldoende is om een taalmodel meetbaar te beïnvloeden.

Van SEO naar GEO: Generative Engine Optimization

Bedrijven en lobbyorganisaties ontwikkelen inmiddels strategieën om hun beeldvorming in AI-antwoorden te sturen. Deze praktijk – Generative Engine Optimization (GEO) – is de opvolger van klassieke SEO. Waar vroeger de strijd ging om zoekresultaten, draait het nu om de vraag: wat zegt ChatGPT over jou, jouw bedrijf of jouw land?

Democratie in het geding

De implicaties reiken verder dan reputatiebeheer. Wanneer AI-systemen bepalen welke informatie betrouwbaar is, verschuift de macht over het publieke debat naar de makers van die systemen – en naar de onzichtbare actoren die hun data voeden. Informatie wordt zo een wapen, en taalmodellen de digitale loopgraven van de moderne propagandaoorlog.

De strijd om waarheid

Experts roepen op tot meer transparantie rond trainingsdata en duidelijkere richtlijnen over bronvermelding. Alleen zo kan worden voorkomen dat de fundamenten van AI-kennis worden ondermijnd door commerciële of politieke manipulatie.

“Als je de input controleert, controleer je de waarheid.”In de woorden van een analist

Een toekomst vol wantrouwen of weerbaarheid

De uitdaging voor ontwikkelaars ligt nu in het versterken van de veerkracht van hun modellen tegen datamanipulatie. Voor gebruikers betekent het dat digitale geletterdheid niet langer alleen gaat over ‘nepnieuws herkennen’, maar ook over kritisch omgaan met wat de chatbot zegt. De vraag blijft: wie schrijft de antwoorden van morgen?