Waarom grote AI-projecten vragen om controle

Nu AI-adoptie explodeert bij bedrijven, rijst de behoefte aan transparantie en risicobeheersing. Salesforce meldt dat de implementatie van AI bij ondernemingen sinds 2024 met maar liefst 282% is gestegen. Met die groei komt er ook druk: wanneer AI-agenten op grote schaal worden ingezet, willen organisaties niet blind vertrouwen op “black box”-systemen. Ze willen kunnen begrijpen hoe en waarom een AI-agent een bepaalde beslissing neemt — zeker wanneer er klantgegevens of compliance gevoeligheden spelen.

|

Salesforce Launches Tools to Support Visibility in Large Scale AI DeploymentFind out how Salesforce AI Observability tools aid in analyzing AI agent performance and driving actionable insights for businesses. |

De drie pijlers van de nieuwe observability-suite

Om daar een oplossing voor te bieden, introduceert Salesforce binnen zijn platform Agentforce 360 drie nieuwe functionaliteiten:

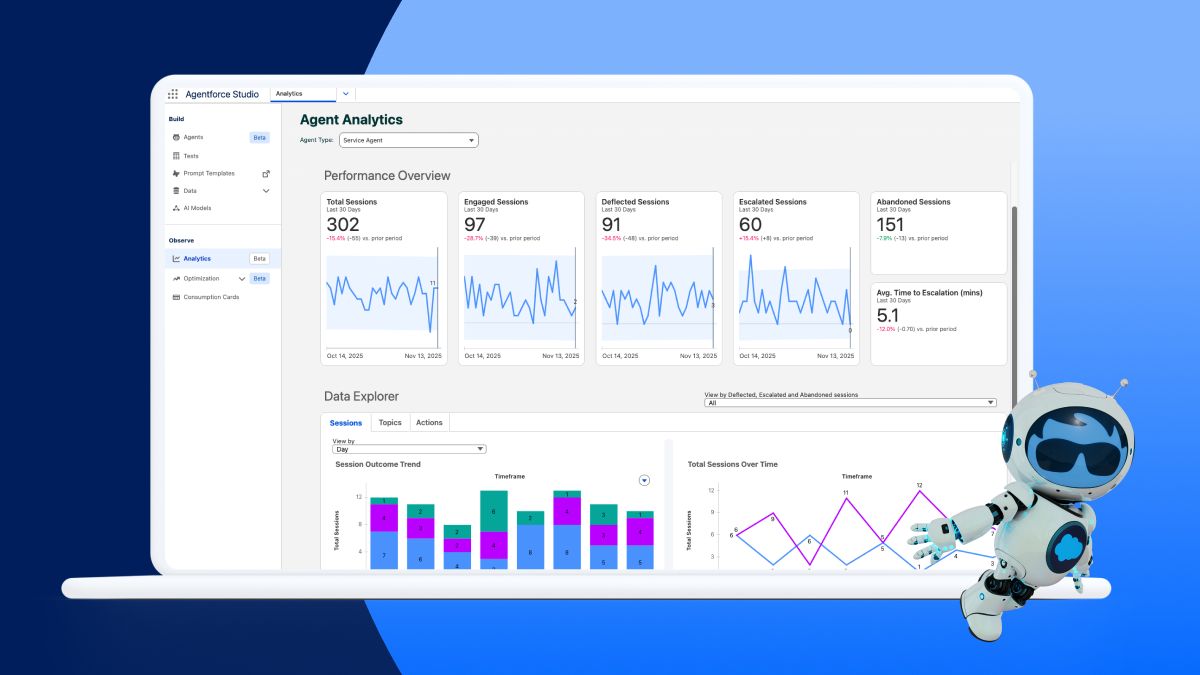

- Agent Analytics: hiermee krijgen bedrijven inzicht in hoe goed de AI-agent presteert — met statistieken over prestaties, trends over tijd en signalen wanneer iets minder goed gaat. Zo kunnen zwakke plekken in customer-interacties of inefficiënte flows opgespoord worden.

- Agent Optimization: deze functie geeft transparantie op het niveau van individuele agent-interacties. Elke stap in een redenering of antwoord kan teruggevolgd worden; bedrijven kunnen begrijpen welke data, regels of prompts tot een bepaalde uitkomst leidden. Ideaal om inconsistenties, foutieve interpretaties of performance-problemen te identificeren en bij te sturen via training, herconfiguratie of guardrails.

- Agent Health Monitoring: realtime monitoring van betrouwbaarheid, prestatiesnelheid en fouten. Het systeem waarschuwt wanneer een agent zich onverwacht gedraagt, traag reageert of fouten produceert — zodat teams snel kunnen ingrijpen en downtime of schade voorkomen.

Deze laag van ‘observability’ wordt onderbouwd door twee technische fundamenten: het Session Tracing Data Model, dat elke interactie logt — met gebruikersinput, respons, redenering en guardrail-checks — én MuleSoft Agent Fabric, dat helpt agents te registreren, beheren en doorzoeken over verschillende omgevingen heen.

|

Salesforce Deepens Observability in Agentforce 360, Giving Every Team Continuous AI Performance Insight and OptimizationThe agent development lifecycle begins with three phases: build, test, and deploy. While many organizations have overcome the initial hurdle of creating |

Van experiment naar opschaalbare AI-infrastructuur

Volgens Salesforce is de tijd gekomen dat organisaties niet langer AI zien als een tijdelijk experiment, maar als een structurele pijler binnen hun workflow. De nieuwe tools van Agentforce 360 zijn dan ook ontworpen om AI-agenten veilig en gecontroleerd op te schalen — van enkele pilots naar productie-omgevingen met veel interacties. In sectoren waar compliance, privacy en betrouwbaarheid cruciaal zijn — denk aan financiën, klantenservice of e-commerce — kan zichtbaarheid in wat AI doet het verschil maken tussen adoptie of afremming.

Wat dit betekent voor bedrijven en de toekomst van AI-exploitaties

Met de komst van deze observability-suite zet Salesforce een belangrijke stap richting volwassen, verantwoord gebruik van “agentic AI”. Organisaties krijgen nu tools in handen om inzicht, controle en governance te combineren met automatisering. AI-agenten worden zo minder “mysterie”, en meer betrouwbare partners in operaties.

Voor bedrijven betekent dit concreet:

- lagere risico’s bij grootschalige uitrol van AI

- betere naleving van compliance en databeleid

- sneller detecteren en corrigeren van fouten of inefficiënties

- mogelijkheid om AI-investeringen tastbaar te maken en ROI te bewijzen

Voor de bredere AI-markt betekent het: meer volwassenheid — en potentieel een stap dichter bij mainstreamadoptie in sectorspecifieke, gereguleerde omgevingen.