Volgens recent onderzoek van 404 Media blijkt dat Flock Safety — het Amerikaanse bedrijf dat automatische kentekenplatenlezers en AI-camera’s produceert — gebruik maakt van gig-arbeiders uit het buitenland om zijn surveillance-AI te trainen.

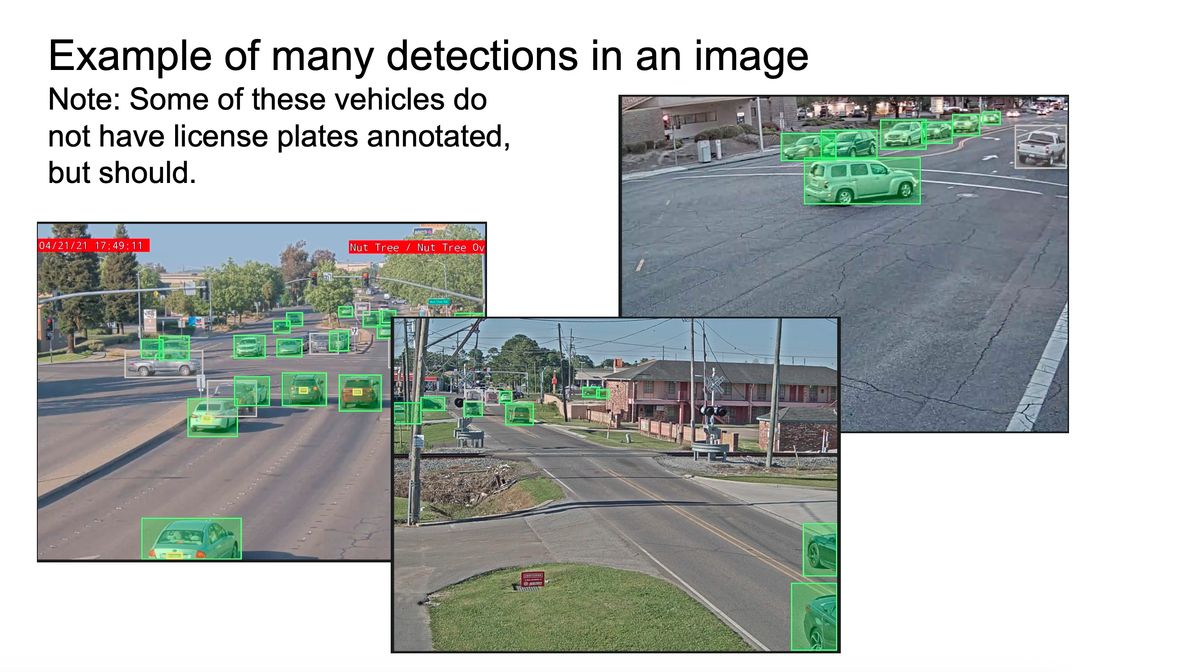

Meer concreet: via platforms zoals Upwork worden onder andere mensen in de Filippijnen ingehuurd om beelden en audio van camera’s in de Verenigde Staten te labelen: kentekens overtypen, voertuig-kenmerken vastleggen (merk, kleur, model), en zelfs audiofragmenten classificeren (bijv. “pistoolschot”, “geschreeuw”, “bandengepiep”).

|

Flock Uses Overseas Gig Workers to Build its Surveillance AIFlock accidentally exposed training materials and a panel which tracked what its AI annotators were working on. It showed that Flock, which has cameras in thousands of U.S. communities, is using workers in the Philippines to review and classify footage. |

Deze onthulling kwam aan het licht nadat intern trainingsmateriaal en een dashboard met taakstatus per annotator per ongeluk online gezet werden — letterlijk een “lek” dat inzicht gaf in wie de beelden bekeek, hoeveel annotaties werden gedaan, en waar die annotators zich bevonden.

Waarom dit problematisch is

Enerzijds is het gebruik van goedkope gig-arbeid (vaak in landen met lagere lonen) om AI te trainen een bekende praktijk in de techwereld.

Maar wat Flock doet, is wezenlijk anders — het gaat niet om abstracte of “harmless” data. Het gaat om surveillancebeelden van voertuigen én mensen; beelden die gebruikt worden om volledige bewegingen van personen in kaart te brengen. Dat maakt de gevoeligheid veel groter: dit zijn geen geanonimiseerde datasets, het zijn real-world privédata.

ACLU raises concerns over widespread use of flock cameras in Rhode IslandThe ACLU of Rhode Island is voicing concern over the growing use of flock cameras in the region. |

Bovendien wijzen eerdere analyses erop dat Flock’s systeem — naast kentekens en voertuigen — ook “personen” kan registreren: kleding, uiterlijk, mogelijk zelfs huidskleur (“race”, volgens een patent van Flock).

Dat werpt ethische, privacy- en juridische vragen op: wie bekijkt de beelden? In welk land? Onder welke voorwaarden? En wat gebeurt er met die data? Zeker aangezien wetshandhavingsinstanties in de VS dergelijke data kunnen opvragen — soms zelfs zonder huiszoekingsbevel.

Breder: Surveillance-AI en de verborgen arbeidsketen

Wat deze zaak blootlegt, is hoe diep de connectie is tussen surveillance-technologie en goedkope, geglobaliseerde arbeidsstructuren. Terwijl de AI-industrie zich vaak presenteert als high-tech en geautomatiseerd, valt in werkelijkheid een cruciale laag van menselijke arbeid — in vaak kwetsbare bevolkingsgroepen wereldwijd — te ontdekken.

|

People flock to Massachusetts Christmas tree farms for as tariffs increase prices on artificial optionsHundreds of people poured into Christmas tree farms in Massachusetts on Friday for the first day of the Christmas tree-cutting season. |

Dat roept vragen op rond transparantie, verantwoording en macht: wie bepaalt wat “gezien” mag worden, wie bepaalt wie toegang heeft tot zulke data, en wie beslist hoe die data gebruikt wordt?

Potentieel misbruik en groeiende kritiek

De verslagen beelden en de capaciteiten van Flock geven redenen voor bezorgdheid: de technologie is al wijd verspreid. De camera’s van Flock hangen in duizenden gemeenschappen in de VS.

Tegelijkertijd blijkt uit recente rapporten dat Federaal agentschappen—o.a. immigratie-diensten—toegang kregen tot het netwerk, wat de reikwijdte van surveillance nog eens vergroot.

Critici waarschuwen dan ook dat dit soort systemen de deur opent voor massale, weinig gecontroleerde bewaking: niet enkel voertuigen, maar ook burgers — hun bewegingen, hun contacten, hun gedrag — kunnen in realtime gevolgd, gelogd en geanalyseerd worden.

Wat betekent dit?

Voor de maatschappij: het is een wake-up call. Technologie die gepresenteerd wordt als “veilige, slimme oplossing tegen misdaad” — en die beoogt “efficiëntie” — vertaalt zich in realiteit vaak naar surveillance, machtsverschuiving, en risico’s voor privacy en burgerrechten. Wat onzichtbaar begon, wordt met deze onthullingen plots schrijnend duidelijk.

Voor iedereen betrokken bij AI, regulering of burgerrechtenbeleid: dit is exact het type casus dat aantoonde waarom transparantie, audits, regelgeving en maatschappelijke discussie dringend nodig zijn. Niet enkel over algoritmes en AI-modellen, maar ook over de arbeidsketens en infrastructuren erachter.