In de wereld van AI-infrastructuur is efficiëntie alles. Huawei stelt dat het met Flex:ai een open-source oplossing biedt om onderbenutte AI-chips tot leven te wekken — en zo de rekencapaciteit van clusters flink op te krikken.

Wat is Flex:ai?

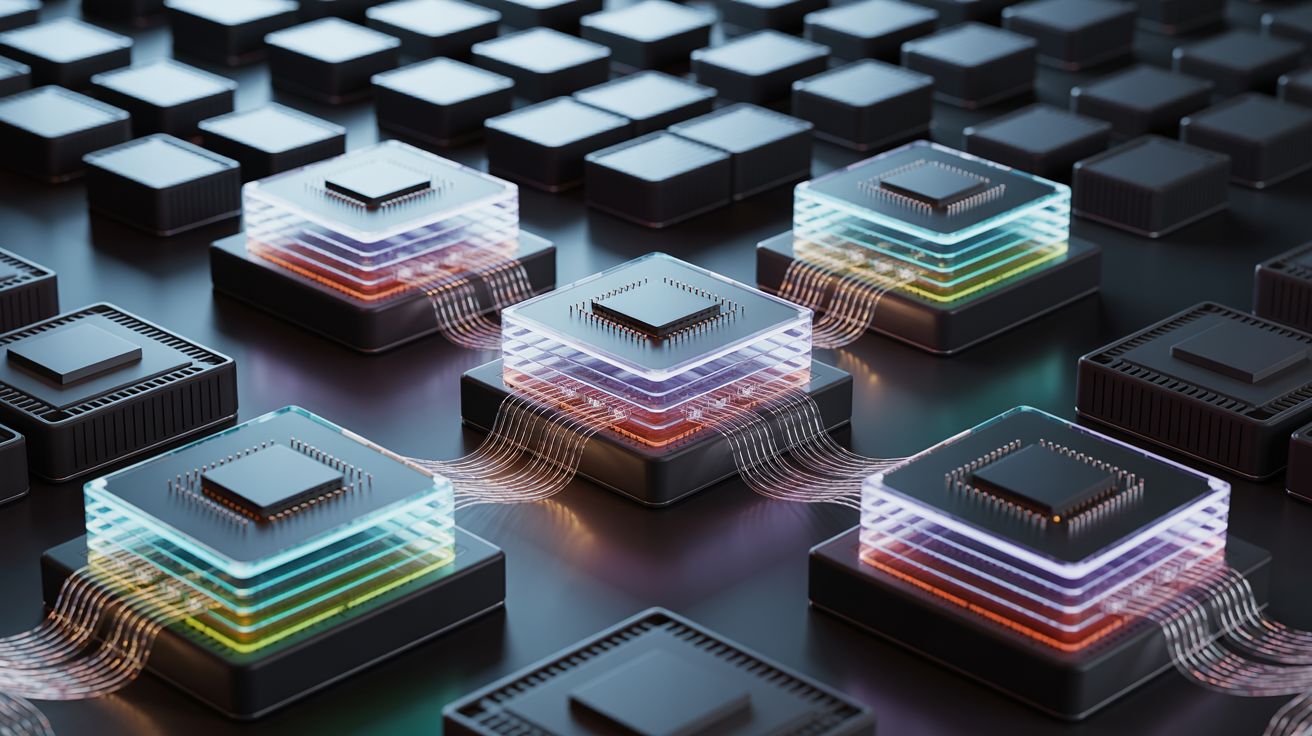

Flex:ai is een nieuwe open-source “orchestration tool” die werd onthuld op 21 november 2025. De software is gebouwd op het wijdverspreide containerplatform Kubernetes en mikt op het maximaliseren van het gebruik van AI-processors — zoals GPU’s en NPUs — in grootschalige rekenclusters.

|

Huawei claims new software can 'create an analogue AI chip 1000 times faster than Nvidia’s chips' — open source Flex:ai software designed to boost AI-chip utilizationHuawei has introduced Flex:ai, an open-source orchestration tool designed to raise the utilization rate of AI chips in large-scale compute clusters. |

Met Flex:ai kan een enkele fysieke AI-chip worden opgesplitst in meerdere virtuele eenheden. Daardoor kunnen meerdere taken tegelijk op één kaart draaien, en kunnen zowel kleine als grote AI-workloads optimaal verdeeld worden.

Waarom was dit nodig?

AI-werk werd de laatste jaren steeds veeleisender — maar tegelijk blijkt dat chips vaak niet volledig benut worden. Kleinere taken benutten zelden de volledige capaciteit van een kaart, terwijl grotere workloads dan weer meerdere kaarten nodig hebben, wat inefficiëntie kan veroorzaken.

Flex:ai belooft dit probleem op te lossen door de hardware slim en flexibel in te zetten: een kaart kan worden “gesliced”, lege rekenkracht wordt samengevoegd, en verschillende typen hardware (GPU én NPU) worden verenigd in één gedeeld “resources-pool”.

Wat kan Flex:ai concreet opleveren?

- Volgens Huawei zou de gemiddelde benuttingsgraad van AI-chips met ongeveer 30% kunnen stijgen.

- Dankzij de opsplitsing in virtuele units (tot op 10% granulariteit) kunnen kleinere AI-taken, die anders te licht zijn voor een volledige kaart, efficiënt draaien naast andere workloads.

- Dankzij een slimme scheduler — Hi Scheduler — kan overtollige rekenkracht in realtime worden herverdeeld over nodes en hardwaretypen, zodat idle capaciteit automatisch opnieuw wordt ingezet waar nodig.

Strategische betekenis: onafhankelijk van westerse chips

De introductie van Flex:ai valt samen met bredere geopolitieke en technologische verschuivingen: door exportbeperkingen vanuit de VS hebben Chinese bedrijven zoals Huawei minder toegang tot “top-klasse” GPU’s van Westerse leveranciers. Flex:ai is dan ook een poging om met software-intelligentie het gebrek aan cutting-edge hardware deels te compenseren.

Door de software open-source beschikbaar te stellen, nodigt Huawei ontwikkelaars, onderzoekers en instellingen uit om mee te bouwen aan een AI-infrastructuur die minder afhankelijk is van buitenlandse processors — en die tegelijk breder inzetbaar is (GPU én NPU).

Kritische kanttekeningen / wat we nog niet weten

Hoewel Huawei met veel ambitie lanceert, is de code van Flex:ai — voor zover ik kan nagaan — nog niet publiek beschikbaar. Er zijn nog geen onafhankelijke benchmarks, noch gedetailleerde documentatie. Hoe goed de virtualisatie werkt, hoe transparant de scheduler is, en hoe compatibel de oplossing is met diverse GPU-types, dat moet zich nog bewijzen.

Het blijft dus afwachten of Flex:ai in werkelijkheid kan leveren wat op papier lijkt. Maar op papier is het alvast een veelbelovende stap richting efficiëntere, flexibele en mogelijk “democratischer” AI-infrastructuur — zeker in omgevingen waar hardware schaars of beperkt is.