Snellere AI-servers, grotere sprong voor open-source

De tech-wereld staat op z’n kop door de nieuwste aankondiging van Nvidia: hun gloednieuwe AI-serverplatform — de GB200 NVL72 — weet krachtige open-source AI-modellen tot tien keer sneller te laten draaien dan voorheen.

Dat is niet zomaar een kleine update: modellen van gerenommeerde namen zoals Moonshot AI en DeepSeek toonden indrukwekkende prestaties in tests — de snelheid bij inferentie (het uitvoeren van modellen) nam spectaculair toe.

|

Mixture of Experts Powers the Most Intelligent Frontier AI Models, Runs 10x Faster on NVIDIA Blackwell NVL72Kimi K2 Thinking, DeepSeek-R1, Mistral Large 3 and others run 10x faster on NVIDIA GB200 NVL72. |

Waarom deze sprong mogelijk is

De ‘mixture-of-experts’ (MoE) aanpak is essentieel voor dit succes: in plaats van bij elke taak het volledige model te gebruiken, activeert MoE enkel de relevante “experts”. Zo blijft de rekenefficiëntie hoog en het energieverbruik beperkt.

Nvidia runs MoE models ten times fasterNvidia presents new benchmarks showing that mixture-of-experts models run up to ten times faster on the GB200 NVL72 platform. |

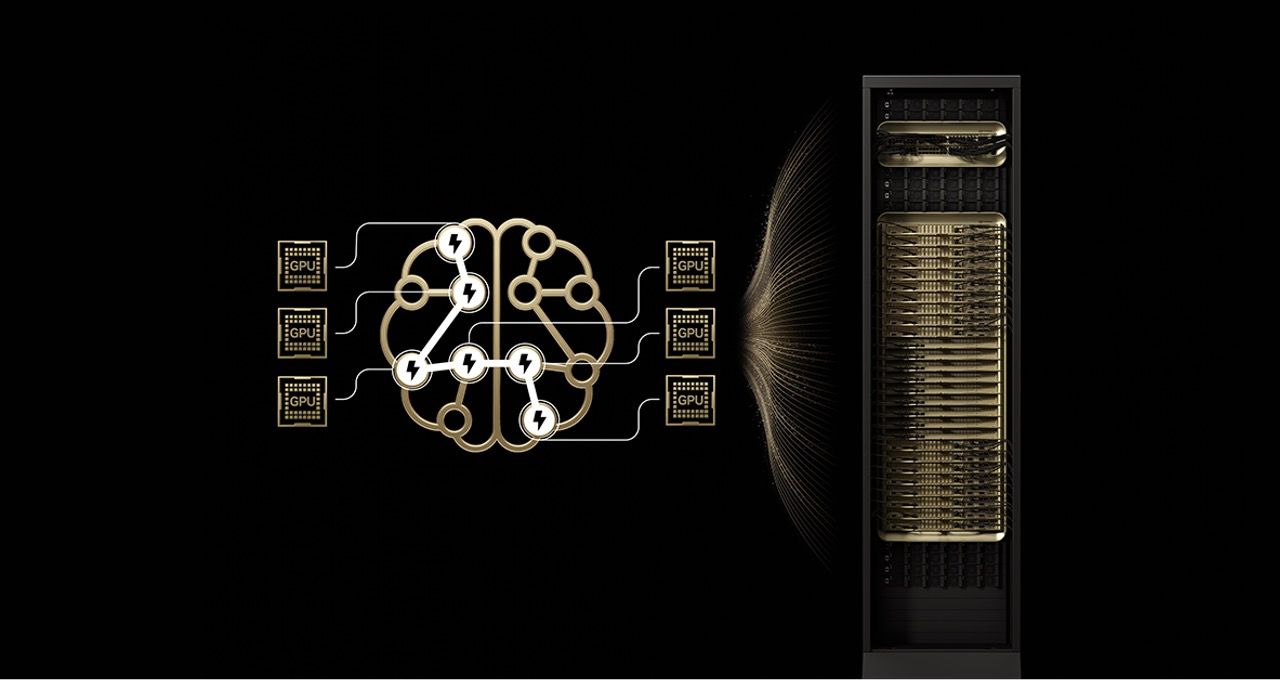

De kracht van de NVL72-server schuilt in de hardware: 72 GPU’s met een gedeeld geheugen, gekoppeld via een razendsnelle NVLink-infrastructuur. Dit maakt dat de GPU’s samenwerken alsof ze één superprocessor zijn — waardoor communicatie en parallelle verwerkingen veel vlotter verlopen dan bij oudere systemen.

Wat dit betekent voor de toekomst van AI

- Open-source modellen krijgen een boost: modellen die voordien al efficiënt waren – zoals die van Moonshot AI en DeepSeek – worden nu echt “productieklaar.” Dankzij de performance-sprong kan inference op grote schaal betaalbaar én energie-efficiënt.

- Meer concurrentie voor commerciële AI-reuzen: het voordeel van open-source – vrijheid én snelheid – maakt het moeilijker voor bedrijven om closed-source monopolies te behouden.

- Efficiëntere datacenters én meer milieubewustzijn: door betere performance-per-watt kunnen centra die AI hosten hun energieverbruik en kosten drukken, wat een duurzamere infrastructuur ondersteunt.

|

Nvidia claims 10x speed boost on new server for DeepSeek-style AI models - TechInformedNvidia has released new benchmark data showing its GB200 NVL72 rack-scale server can deliver up to a tenfold improvement in performance-per-watt for certain |

Kritische kanttekeningen

Toch is de sprong niet per se een volledige “game changer” voor elk AI-model: de prestaties hangen sterk af van modeltype, optimalisatie en workloads. Niet alle modellen zullen automatisch 10× sneller draaien — maar voor MoE-modellen is de vooruitgang overduidelijk.

Bovendien staan concurrenten als AMD en Cerebras klaar met hun eigen multi-chip servers, die mogelijk volgend jaar opduiken. De race om inferentie-dominantie is dus nog lang niet voorbij.