Wat is Alpamayo-R1?

De technologiereus NVIDIA onthulde op de conferentie NeurIPS 2025 zijn nieuwste troef voor autonome mobiliteit: de open-source AI-software Alpamayo-R1 (AR1). Het is ’s werelds eerste industriële “vision-language-action” (VLA) model dat speciaal ontwikkeld is voor zelfrijdende voertuigen. Daarmee wil NVIDIA een belangrijke sprong maken richting veiligere, meer menselijke beslissingen door AV’s.

Hoe werkt het — “zien, redeneren, handelen”

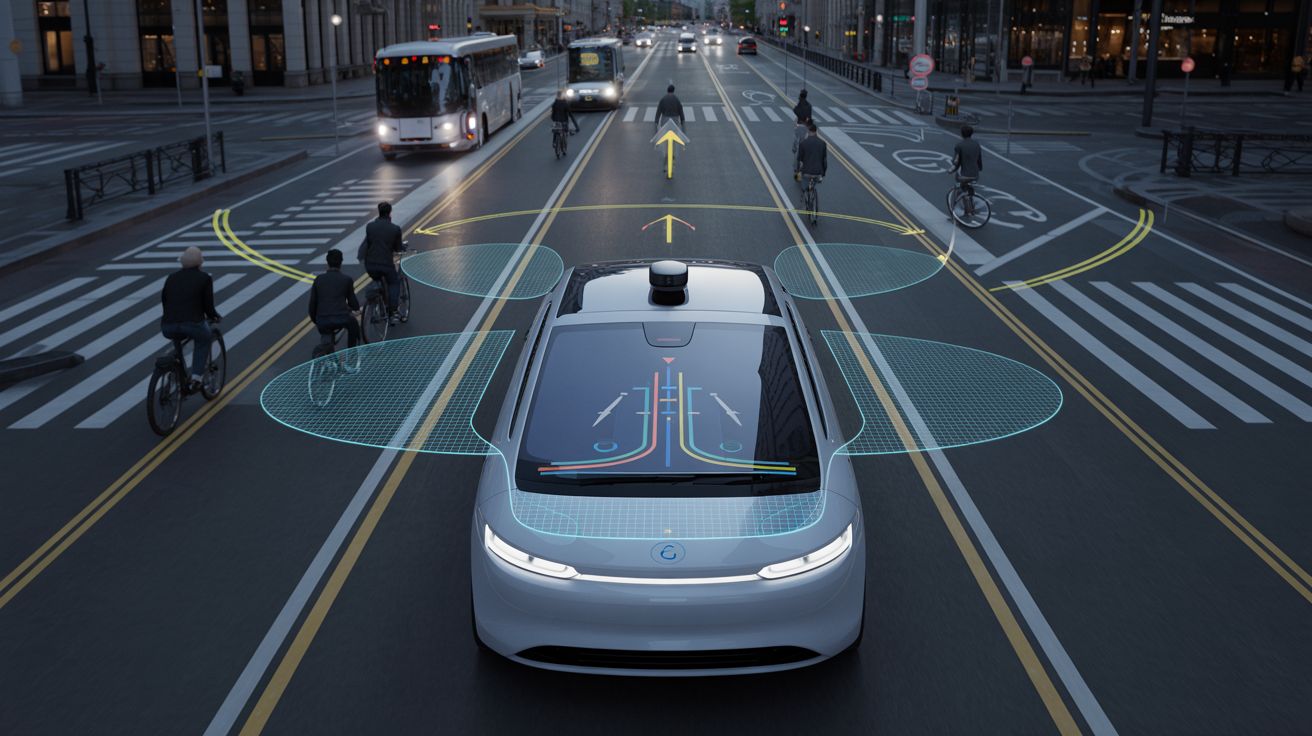

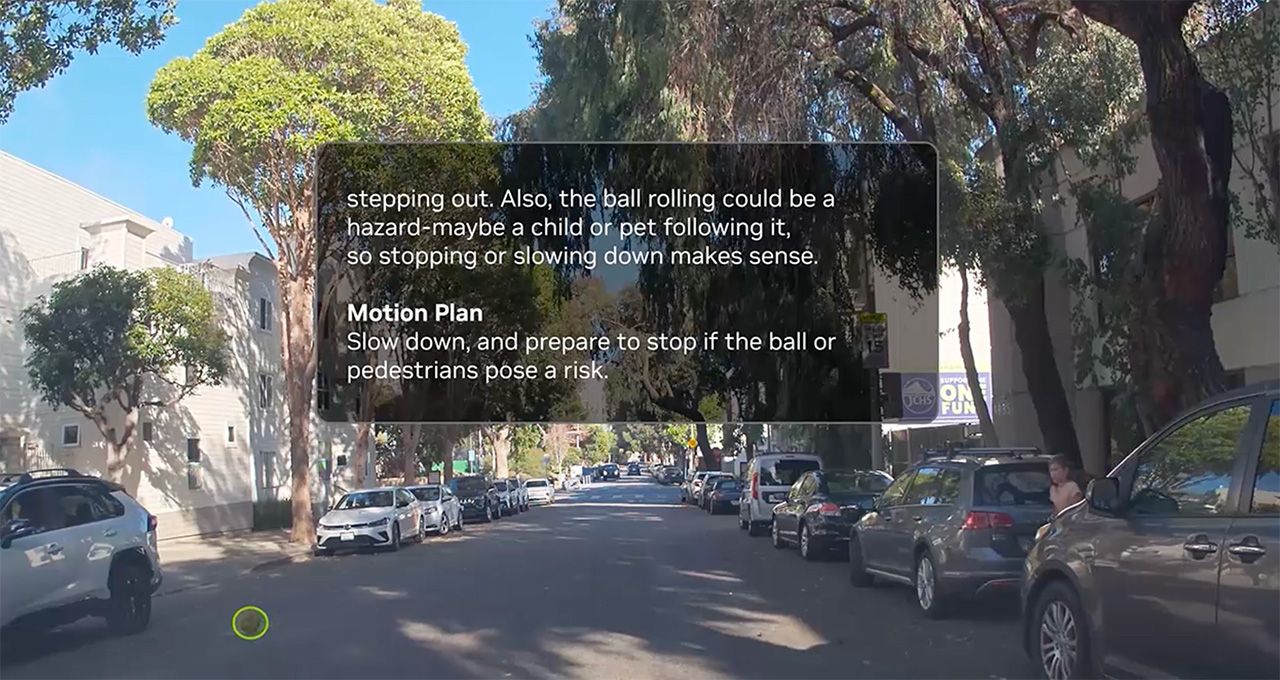

Alpamayo-R1 combineert visuele input (camera’s/sensoren) met natuurlijke taal en actieplanning. In plaats van enkel lijnen, objecten of tekstlabels te herkennen, “denkt” het model in stappen na over wat het ziet, waarom dat relevant is en wat de beste actie is. Bijvoorbeeld: auto’s kunnen herkennen dat er een fietspad is, dit in natuurlijke taal beschrijven en hun koers daarentegen aanpassen. Die redenering — “chain of causation” — maakt dat de AI beter omgaat met complexe, onvoorspelbare situaties.

Nvidia announces new open AI models and tools for autonomous driving research | TechCrunchNvidia continues its push into physical AI with the release of a new reasoning world model and other tools for physical AI. |

In tests haalt Alpamayo-R1 volgens NVIDIA tot 12% betere planning nauwkeurigheid dan systemen die enkel trajecten plannen — mét 35% minder “off-road” fouten en 25% minder bijna-botsingen in simulaties. Bovendien blijkt dat het systeem in realtime kan werken (≈ 99 ms latency) en klaar is voor stedelijke deploys.

Waarom dit belangrijk is voor autonome mobiliteit

Tot nu toe worstelden zelfrijdende systemen vooral met “lange staarten” — zeldzame of complexe verkeerssituaties (fietser ziet auto niet, dubbel geparkeerde bus, onduidelijke wegmarkeringen, etc.). Traditionele end-to-end AI of klassieke modulaire stacks konden hier onvoldoende mee omgaan. Alpamayo-R1 wil precies die kloof dichten: door redenering + planning te combineren, krijgt de auto “common sense” — wat cruciaal is voor Level-4-autonomie.

|

At NeurIPS, NVIDIA Advances Open Model Development for Digital and Physical AINVIDIA releases new AI tools for speech, safety and autonomous driving — including NVIDIA DRIVE Alpamayo-R1, the world’s first open industry-scale reasoning vision language action model for mobility — and a new independent benchmark recognizes the openness and transparency of NVIDIA Nemotron models and datasets. |

Belangrijker nog: door het open-source te maken, nodigt NVIDIA de hele onderzoekers- en ontwikkelaarsgemeenschap uit om het model te evalueren, verbeteren of integreren. Transparantie en samenwerking moeten de adoptie van verantwoorde AV-systemen versnellen.

Wat betekent dit voor de AI- en auto-industrie — en voor beleggers / innovatoren

Met Alpamayo-R1 toont NVIDIA dat zijn ambitie verder reikt dan chips en rekencapaciteit: het evolueert naar fysieke AI — systemen die niet enkel data verwerken, maar echte beslissingen nemen in de fysieke wereld. Daarmee positioneert NVIDIA zich niet enkel als hardware-leverancier, maar als architect van de toekomst van autonome mobiliteit.

Voor startups, autoconstructeurs en onderzoeksinstellingen biedt deze open release een schat aan mogelijkheden: geen proprietary black-box systemen meer, maar open, inspecteerbare AI met mogelijke snelle iteratie. Voor investeerders kan dit een signaal zijn dat het “autonome rijden”-ecosysteem opnieuw vaart krijgt — met realistischere vooruitzichten op schaalbare, veilige AV-projecten.

|

NVIDIA debuts first open reasoning AI for self-driving vehiclesNVIDIA unveils first open reasoning AI for autonomous vehicles and new tools for robotics, speech, and AI safety. |