Een sprong vooruit voor GPU-ontwikkeling

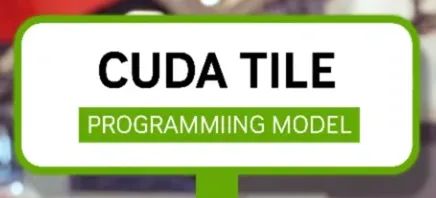

Met de release van CUDA 13.1 introduceerde NVIDIA een van de meest ingrijpende vernieuwingen in twee decennia: het geheel nieuwe programmeermodel CUDA Tile. In plaats van programmeurs de complexiteit van “thread-level” management te laten hanteren, stelt CUDA Tile hen in staat om op een hoger abstractieniveau te werken — met data-instellingen die “tiles” worden genoemd. De compiler en runtime doen de rest.

|

NVIDIA CUDA 13.1 Powers Next-Gen GPU Programming with NVIDIA CUDA Tile and Performance Gains | NVIDIA Technical BlogNVIDIA CUDA 13.1 introduces the largest and most comprehensive update to the CUDA platform since it was invented two decades ago. In this release… |

Wat is anders: van threads naar tiles

Traditioneel vereiste GPU-programmering via CUDA dat ontwikkelaars elk detail van thread-indeling, synchronisatie en geheugenbeheer zelf vastlegden — een tijdrovend en foutgevoelig proces.

CUDA - Wikipedia

|

CUDA Tile daarentegen laat je data opdelen in “tiles”, waarbij je enkel definieert welke bewerkingen je op die data wil toepassen. De complexe hardware-details — zoals het aansturen van “tensor cores” — worden automatisch afgehandeld. Dat maakt code niet alleen eenvoudiger, maar ook veel beter toekomstbestendig.

|

NVIDIA Releases CUDA 13.1 With New "CUDA Tile" Programming Model

|

Nieuwe tools: Python in de hoofdrol

Bij de lancering van CUDA Tile komt ook een nieuwe toolset: cuTile Python — een domeinspecifieke taal waarmee ontwikkelaars GPU-kernels in Python kunnen schrijven in tile-stijl. Dit verlaagt de drempel enorm, zeker voor data-wetenschappers of AI-ontwikkelaars die niet per se expert zijn in lage-niveau C++/CUDA-programmering.

Hoewel de eerste versie zich richt op bepaalde GPU-architecturen (o.a. de “Blackwell”-lijn, met compute-capabilities 10.x en 12.x) belooft NVIDIA dat de tile-architectuur in toekomstige versies breder ondersteund zal worden, inclusief een C++-variant.

Meer dan alleen een nieuw model: Extra verbeteringen onder de motorkap

CUDA 13.1 brengt niet alleen Tile-programmering, maar ook diepgaande updates voor ontwikkelaars:

- De runtime-API breidt ondersteuning uit voor zogenoemde “green contexts”, wat fijnmaziger beheer van GPU-resources mogelijk maakt — handig voor latency-gevoelige workloads.

- Ondersteuning in bibliotheken en tooling: o.a. updates aan cuBLAS, cuSPARSE, profilers en debugging-tools maken van CUDA 13.1 een platform dat klaar is voor de toekomst.

Waarom dit belangrijk is

De stap van thread-gebaseerd programmeren naar tile-gebaseerd programmeren markeert een paradigmaverschuiving: waar vroeger elk hardware-detail manueel moest ingesteld worden, ligt de focus nu op algoritmen en data-operaties. Dat maakt GPU-ontwikkeling:

- toegankelijker (minder ervaring vereist),

- minder foutgevoelig,

- en duurzamer: code geschreven met CUDA Tile is meteen compatibel met toekomstige GPU-architecturen.

Voor AI/ML-toepassingen is dit bijzonder relevant — want tensor-operaties, matrixberekeningen en data-parallel workloads worden een pak eenvoudiger te schrijven en te onderhouden.