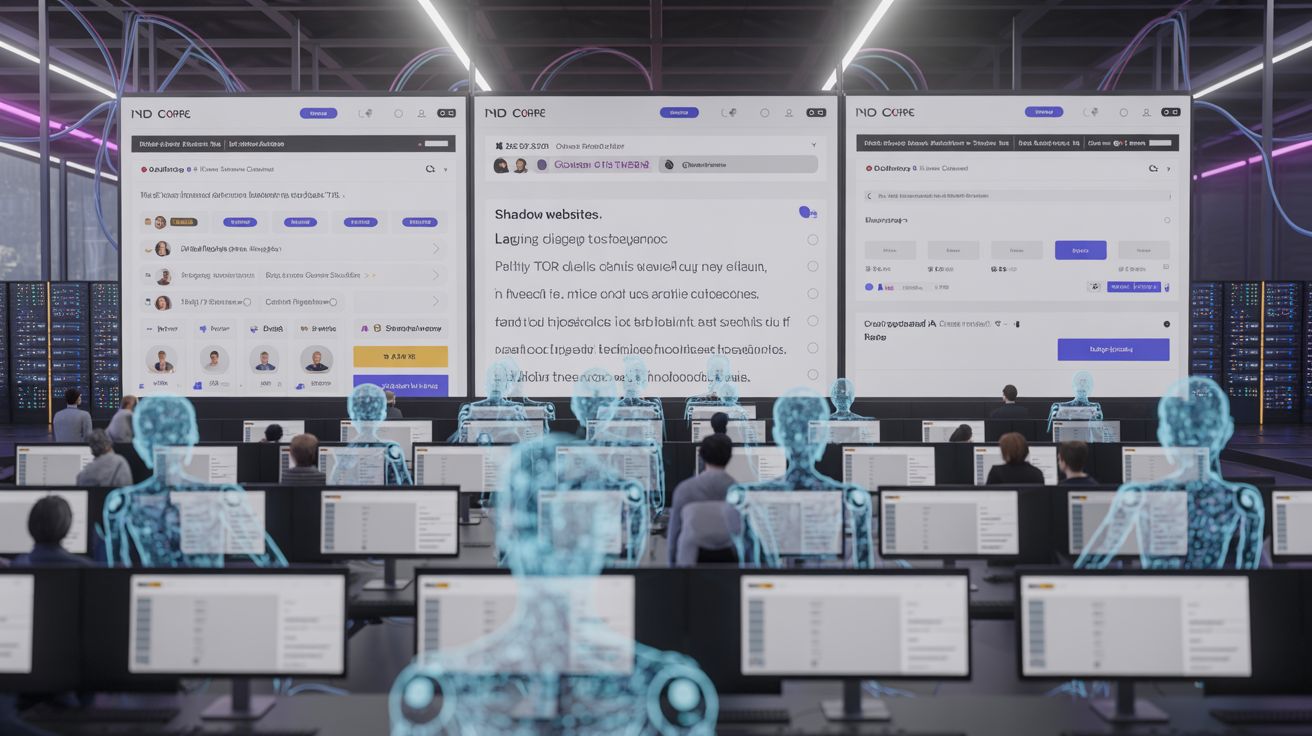

In Silicon Valley doen sommige startups iets opvallends: ze creëren digitale duplicaten van populaire websites — denk aan platforms zoals Amazon of Gmail — om er kunstmatige intelligentie (AI) op te trainen. Het idee: bied AI-agenten een realistische speelwereld waar ze kunnen oefenen met taken als winkelen, mailen of boekingen maken.

Digitale replica’s versus echte data — de push voor synthetisch

De beweging is een reactie op de uitdagingen waarmee AI-ontwikkelaars steeds vaker worden geconfronteerd. Toegang tot realistische, bruikbare data is beperkt — enerzijds door privacy- en juridsche restricties, anderzijds door de schaarste aan goed gestructureerde data. De oplossingen komen in de vorm van “shadow sites” of gesimuleerde omgevingen, waar AI-agenten veilig ongestructureerde en vrij beschikbare data kunnen naspelen.

|

Tech Giants Build Synthetic Amazon, Gmail for AI TrainingTech giants and startups are building synthetic replicas of sites like Amazon and Gmail to train AI agents on simulated data, addressing real-world data shortages and legal hurdles. This innovation aims to create autonomous AI for tasks like shopping and emailing, but raises concerns over privacy, jobs, and ethics. |

In zulke simulaties kunnen AI’s navigeren door menus, buttons aanklikken, bestellingen plaatsen of mails beheren — net alsof ze een echte gebruiker zijn. Zo leren ze taken die in de echte wereld verborgen of moeilijk toegankelijk zijn, zonder dat dit privacy- of juridische problemen oplevert.

Waarom dit een gamechanger kan zijn voor autonome AI

Voor AI-agenten is trainen in synthetische omgevingen als deze cruciaal om autonome taken adequaat uit te voeren: automatisch winkelen, mail afhandelen, boekingen maken, enzovoort. In de klassieke aanpak zou een AI massaal echte gebruikersdata moeten kraken — wat zowel ethisch als wettelijk problematisch is. De nieuwe aanpak vermijdt dat dilemma door simpelweg “neppe” omgevingen op te tuigen.

Silicon Valley clones popular websites to train AI agentsSilicon Valley startups are creating replicas of popular websites like Amazon and Gmail. These 'shadow sites' are used to train artificial intelligence agents in task completion. |

Daarbij opent dit ook nieuwe mogelijkheden voor de industrie: AI-bedrijven hoeven niet langer afhankelijk te zijn van dure of gelimiteerde datasets, maar kunnen schaalbaar en legaal AI trainen — en tegelijk de randvoorwaarden rond privacy respecteren.

Tegelijk: ethiek, banen en juridische vraagtekens

Maar de opmars van synthetische omgevingen roept ook kritische vragen op. Als AI’s leren op replica’s van echte platforms, wie garandeert dan dat die imitatie niet misbruikt wordt? Zijn de rechten van de originele platforms gewaarborgd? In 2025 leidde een dergelijke kopie bijvoorbeeld tot een officieel verwijderingsverzoek (takedown) door een bedrijf dat zich gekloond zag.

Bovendien: zodra AI-agenten taken volautomatisch beginnen uitvoeren — boeken, mails verwerken, aankopen doen — wat betekent dat dan voor jobs in de traditionele dienstensector? Sommigen vrezen dat white-collar taken steeds vaker door algoritmes overgenomen zullen worden.

In de context van de huidige AI-renaissance

Technologiebedrijven, cloud-providers en AI-startups zoeken steeds vaker naar alternatieven om data-limieten, privacy en schaalbaarheid te combineren. Synthetische data, “shadow environments,” en replica-websites behoren tot de nieuwe wapens in die strijd.

Vooral omdat het past in de bredere push dat AI-modellen niet alleen “leren” van statische datasets, maar van interactie — van handelen, navigeren, fouten maken, verbeteren. In dat opzicht kan deze aanpak een belangrijke stap zijn naar werkelijk autonome, contextbewuste AI-agenten.