De testpiramide: Drie lagen voor betrouwbare agenten

AI-agenten zijn geen klassieke software. Ze bestaan uit talloze beslissingspunten, paden en onverwachte situaties. Daarom werkt Google met een 3-Tier Testing Pyramid, een pragmatische structuur die helpt om agentgedrag systematisch te beoordelen.

1. Componenttests: De bouwstenen onder de loep

Op het laagste niveau worden de afzonderlijke onderdelen van een agent getest. Denk aan promptmodules, geheugencomponenten, tools of API-aanroepen.Hij schetst hoe ADK ontwikkelaars in staat stelt om geautomatiseerde unit tests te schrijven die elke functie isoleren en objectief controleren. Als één radertje draait, kan de rest pas soepel bewegen.

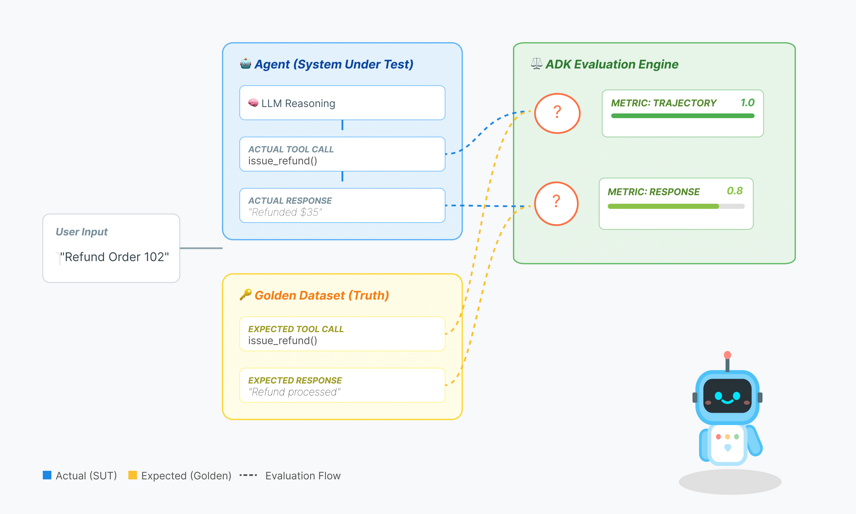

2. Trajectorytests: Doet de agent wat hij belooft?

Op het tweede niveau draait alles om het evalueren van complete interacties — de “trajecten” die een agent aflegt om een doel te bereiken.Met ADK kunnen ontwikkelaars volledige scenario’s simuleren, zoals:

- een klantendienst-agent die een klacht oplost,

- een code-assistent die een bug analyseert,

- een shopping-agent die een product vergelijkt.

Hier wordt gecontroleerd of de agent consistent, logisch en doeltreffend handelt. Niet één stap telt, maar het totaalplaatje.

3. Menselijke beoordeling: De ultieme realiteitscheck

De top van de piramide blijft menselijk.Hij benadrukt dat sommige aspecten — nuance, toon, empathie, veiligheid — alleen door menselijke reviewers betrouwbaar kunnen worden beoordeeld.ADK ondersteunt dit proces door resultaten te bundelen, te vergelijken en systematisch te evalueren, zodat teams snel leren waar een agent nog tekortschiet.

|

Evaluating Agents with ADK | Google CodelabsLearn how to generate golden datasets and run evaluations to ensure your AI agents are trustworthy. |

ADK in actie: Testen ontwerpen, draaien en automatiseren

Het Google ADK fungeert als een sandbox én een testlab. Ontwikkelaars kunnen:

- scenario’s definëren,

- agentgedrag mocken of simuleren,

- automatische checks instellen,

- integratietests herhalen onder identieke omstandigheden,

- rapporten genereren die inzichten geven in prestaties én afwijkend gedrag.

Hij toont hoe ADK zo ontworpen is dat teams niet alleen kunnen testen of een agent werkt, maar ook waarom hij iets doet — cruciaal wanneer AI-systemen steeds autonomer worden.

Waarom dit ertoe doet

Naarmate AI-agenten steeds meer taken overnemen, groeit de nood aan nauwkeurige evaluatie. Het doel is niet om perfecte agents te bouwen, wel betrouwbare: agents die voorspelbaar handelen, veilig blijven en voldoen aan de verwachtingen van gebruikers.

Met ADK en de 3-Tier Testing Pyramid krijgen ontwikkelaars eindelijk een heldere methode om die betrouwbaarheid te toetsen — stap voor stap, laag voor laag.