Waarom AI-video’s steeds overtuigender worden

AI-gegenereerde video’s, vaak aangeduid als deepfakes, kunnen gezichten, stemmen en gebeurtenissen zodanig nabootsen dat zelfs ervaren kijkers moeite hebben om ze te onderscheiden van echte opnames. Deepfakes maken gebruik van machine-learning-modellen zoals variational auto-encoders en generative adversarial networks om realistische beelden en audio te creëren, met alle risico’s van dien.

Deze technologie kan ingezet worden voor creatieve toepassingen, maar ook voor misleiding, desinformatie en manipulatie. Daarom zoeken journalisten, tech-experts en fact-checkers constant naar manieren om echte video’s van nep te scheiden.

De rol van verborgen watermerken

Een van de belangrijkste hulpmiddelen om AI-video’s te herkennen is het verborgen watermerk of metadata-label dat in de digitale bestandscode is ingebed. Deze techniek wordt door sommige AI-systemen gebruikt om aan te geven dat een video met behulp van kunstmatige intelligentie is geproduceerd.

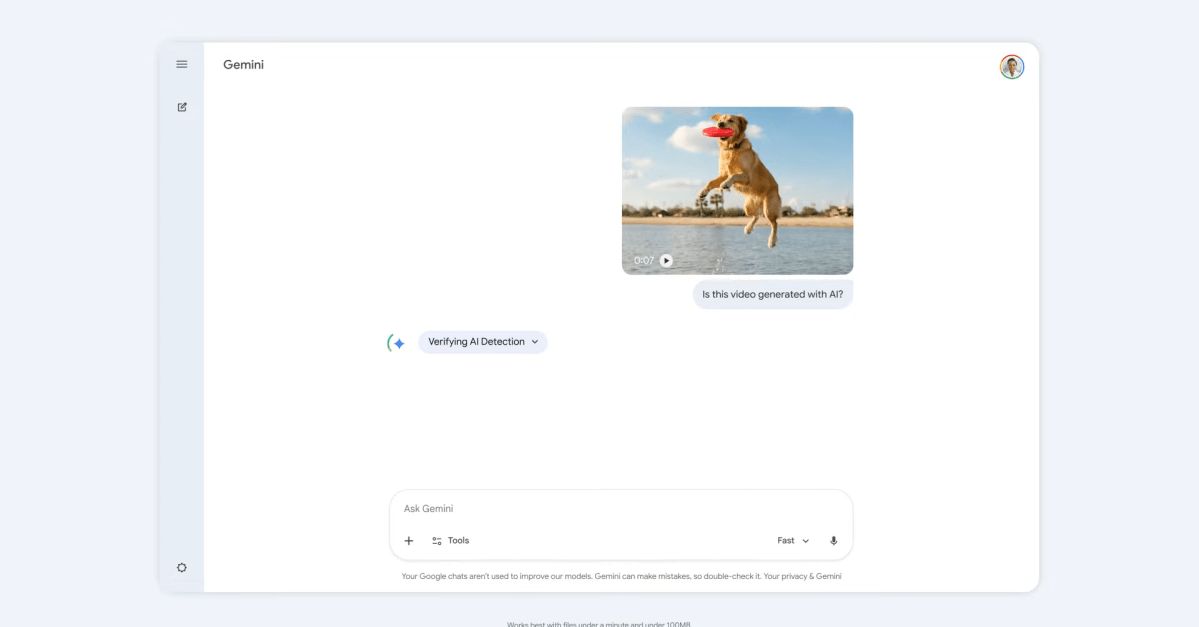

|

Google’s Gemini app can check videos to see if they were made with Google AIGoogle launched a verification feature to its Gemini app that can check if a video was made using Google’s own AI. |

Hoe werkt een verborgen watermerk?

- Een watermerk zit niet in het zichtbare beeld, maar is verwerkt in de digitale structuur van de video.

- Tools zoals verificatiefuncties in apps (bijv. Google Gemini) kunnen zoeken naar deze signalen.

- Als een watermerk aanwezig is, geeft dat een sterke aanwijzing dat een video AI-gegenereerd of bewerkt is.

Tips om misleidende video’s zelf te herkennen

Hoewel watermerken een eerste verdedigingslinie vormen, zijn er ook praktische kenmerken waar iedereen op kan letten:

🔍 1. Kijk naar onlogische details

Vreemde schaduwen, onnatuurlijke bewegingen, vreemde ogen of onregelmatige lipbewegingen kunnen tekenen zijn van AI-manipulatie.

🧠 2. Controleer of metadata aanwezig is

Sommige verificatietools kunnen metadata analyseren om te zien of een bestand AI-watermerken bevat.

🌐 3. Vergelijk met betrouwbare bronnen

Betrouwbare nieuwsorganisaties publiceren zelden ongeverifieerd beeldmateriaal. Als geen andere bron hetzelfde laat zien, kan dat een rode vlag zijn.

📍 4. Let op de bron en context

Een fragment kan authentiek lijken, maar de bewering eromheen kan misleidend zijn — controleer altijd de context.

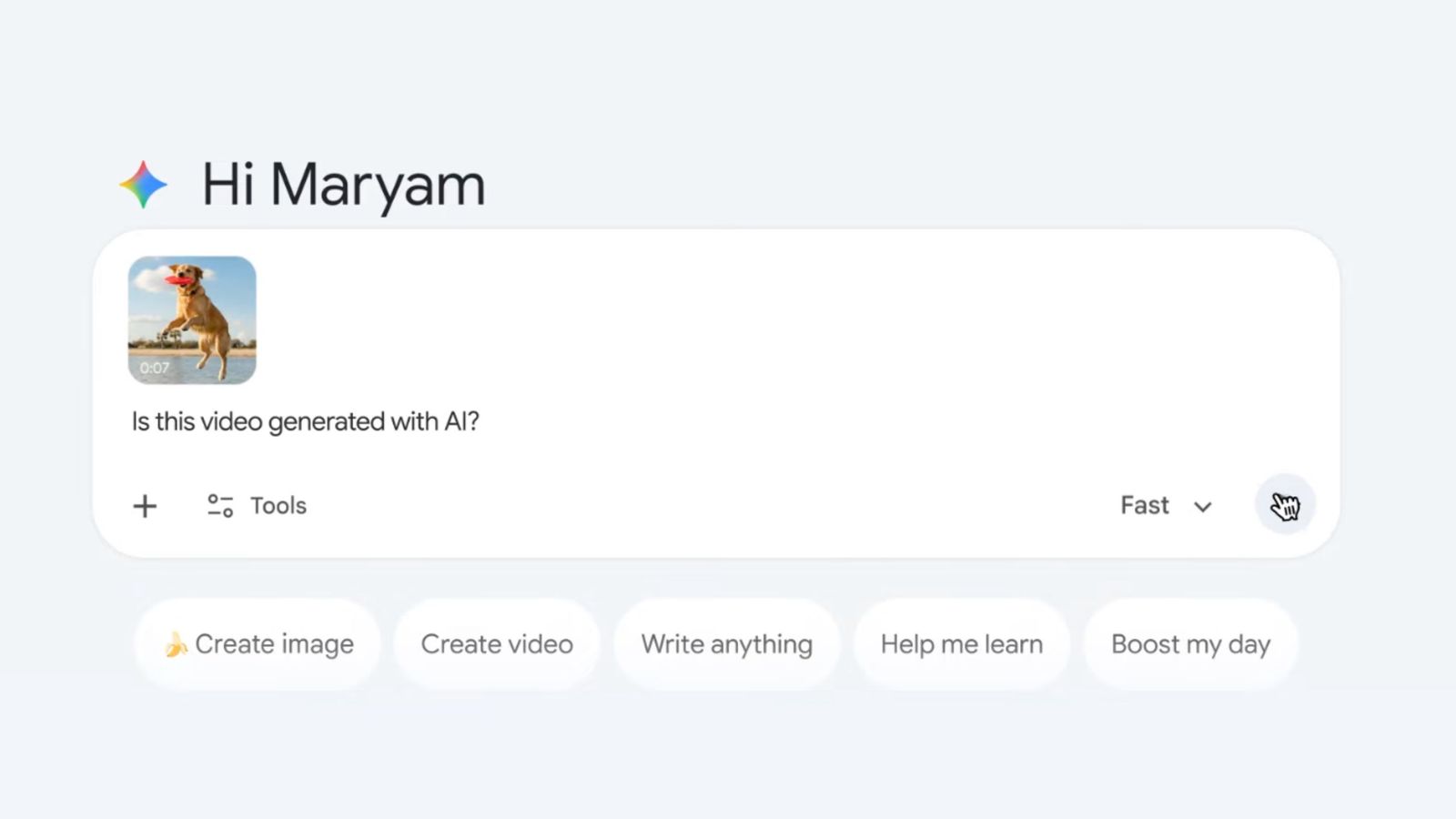

|

Gemini can now tell you whether a video was generated with Google AIUpload a video to Gemini and immediately find out if it was AI-generated with Google software. |

Waarom het watermerken alleen niet genoeg is

Experts waarschuwen dat watermerken niet altijd waterdicht zijn. Ze kunnen worden verwijderd of vervormd zodra video’s worden gedeeld via sociale platforms. Bovendien is er geen universele standaard die altijd en overal wordt gebruikt.

Toch blijft het embedden van digitale herkenningspatronen één van de meest veelbelovende strategieën om nep-video’s te herkennen — vooral als deze gekoppeld worden aan verificatie-diensten en breed gedragen standaarden. X (formerly Twitter)

Slotbeschouwing

In een wereld waarin AI steeds beter wordt in het nabootsen van de werkelijkheid, zijn technische hulpmiddelen én kritisch kijkgedrag onmisbaar. Verborgen watermerken, metadata-analyse en oplettendheid kunnen samen helpen om misleiding te ontmaskeren en desinformatie tegen te gaan.