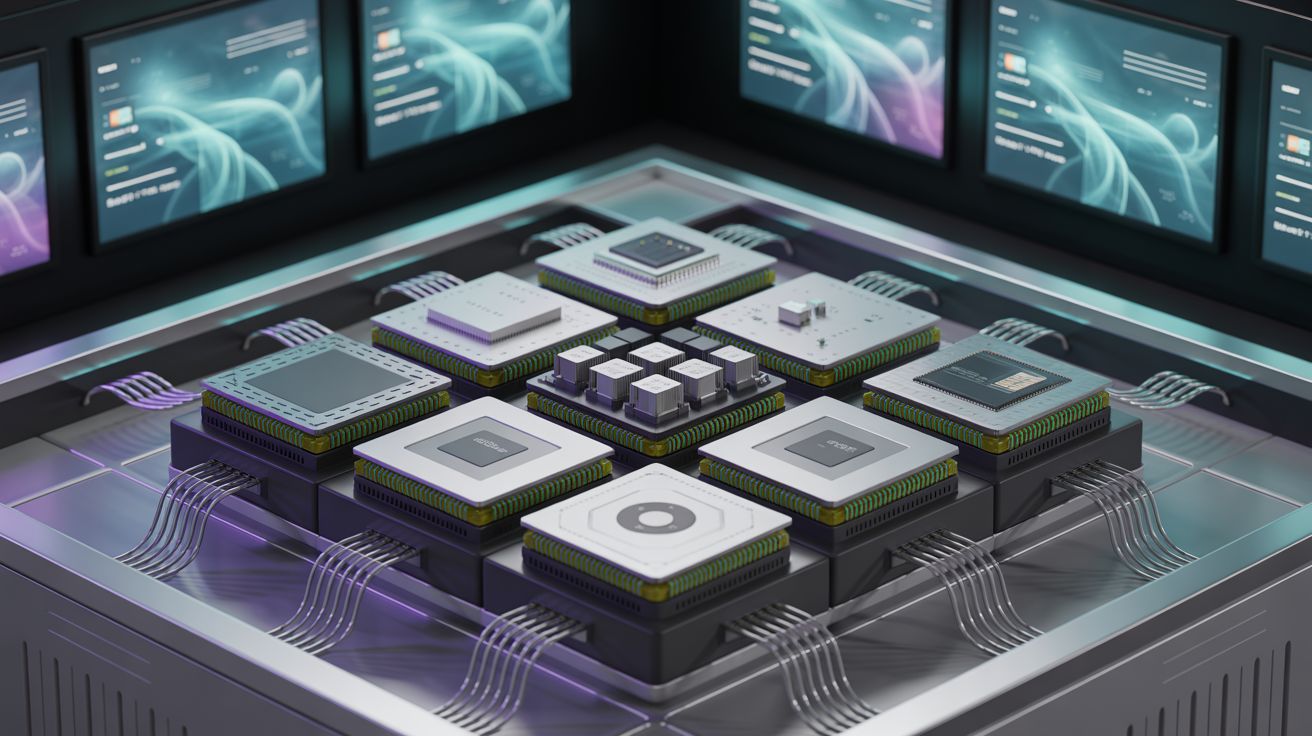

Op de technologiebeurs CES 2026 in Las Vegas heeft NVIDIA Vera Rubin geïntroduceerd, een gloednieuw AI-computingplatform dat volgens insiders een grote sprong voorwaarts betekent in de infrastructuur voor kunstmatige intelligentie. Het systeem combineert zes speciaal ontworpen chips en vormt één geïntegreerde AI-supercomputer — gebouwd om de groeiende rekenbehoefte van moderne AI-modellen te kunnen dragen.

Nvidia launches Vera Rubin AI computing platform at CES 2026Nvidia launched its new Vera Rubin computing architecture today at CES 2026, claiming it delivers more computing power at a lower cost than Blackwell. |

Wat is Vera Rubin precies?

In tegenstelling tot de traditionele benadering van afzonderlijke GPU’s, vormt Vera Rubin een rack-schaal AI-systeem waarin zes verschillende componenten samenwerken als één geheel. Die zes chips zijn onder meer:

- de Vera CPU

- de Rubin GPU

- de nieuwste NVLink interconnect switch

- en gespecialiseerde netwerk- en DPU-chips (zoals BlueField-4).

Deze combinatie zorgt ervoor dat AI-training en –inference sneller én goedkoper kunnen verlopen dan met eerdere NVIDIA-architecturen.

|

NVIDIA DGX SuperPOD Sets the Stage for Rubin-Based SystemsNVIDIA DGX SuperPOD is paving the way for large-scale system deployments built on the NVIDIA Rubin platform — the next leap forward in AI computing. At the CES trade show in Las Vegas, NVIDIA today introduced the Rubin platform, comprising six new chips designed to deliver one incredible AI supercomputer, and engineered to accelerate agentic Read Article |

Een technologische doorbraak: Sneller, goedkoper, efficiënter

Volgens NVIDIA levert de nieuwe Rubin GPU enorme prestaties met tot 50 petaflops AI- rekenkracht voor inferentie en sterke verbeteringen in trainingsefficiëntie ten opzichte van de vorige Blackwell-architectuur.

Nvidia debuts Rubin chip with 336B transistors and 50 petaflops of AI performance - SiliconANGLENvidia debuts Rubin chip with 336B transistors and 50 petaflops of AI performance - SiliconANGLE |

Door de extreme co-ontwerpstrategie kunnen AI-modellen met:

- tot 10× lagere kosten per inference-token

- en tot 4× minder GPU’s nodig zijn voor trainingdan bij eerdere architecturen.

Deze schaalvoordelen zijn essentieel nu AI-modellen steeds complexer worden en enorme hoeveelheden rekenkracht vragen.

Wat betekent dit voor de AI-industrie?

De lancering van Vera Rubin weerspiegelt de toenemende vraag naar gespecialiseerde AI-infrastructuur, vooral nu bedrijven als OpenAI, AWS, Google Cloud, Microsoft en andere grote spelers aangeven dat ze investeren in next-gen hardware om hun AI-diensten krachtiger en efficiënter te maken.

In de praktijk kan dit betekenen:

- Snellere ontwikkeling van grote taalmodellen en multimodale AI

- Efficiëntere datacenters die lagere operationele kosten hebben

- Meer draagvlak voor toepassingen zoals agentic AI en intelligente robots

Relevantie van CES en de concurrentiedruk

CES 2026 toont ook hoe de concurrentie in AI-chips blijft stijgen. AMD presenteerde eveneens nieuwe AI-hardware, terwijl NVIDIA met Rubin wil blijven domineren in high-end AI-infrastructuur. Reuters

Conclusie — Een nieuw fundament voor AI-innovatie

Met Vera Rubin lijkt NVIDIA niet alleen een chip, maar een volwaardig AI-ecosysteem te hebben gepresenteerd — een platform dat ontworpen is om de stap van experiment naar massale adoptie van krachtige AI te versnellen. De vraag is nu hoe snel bedrijven en datacenters deze nieuwe technologie op grote schaal zullen inzetten en welke impact dit zal hebben op AI-ontwikkeling en toepassingen de komende jaren.