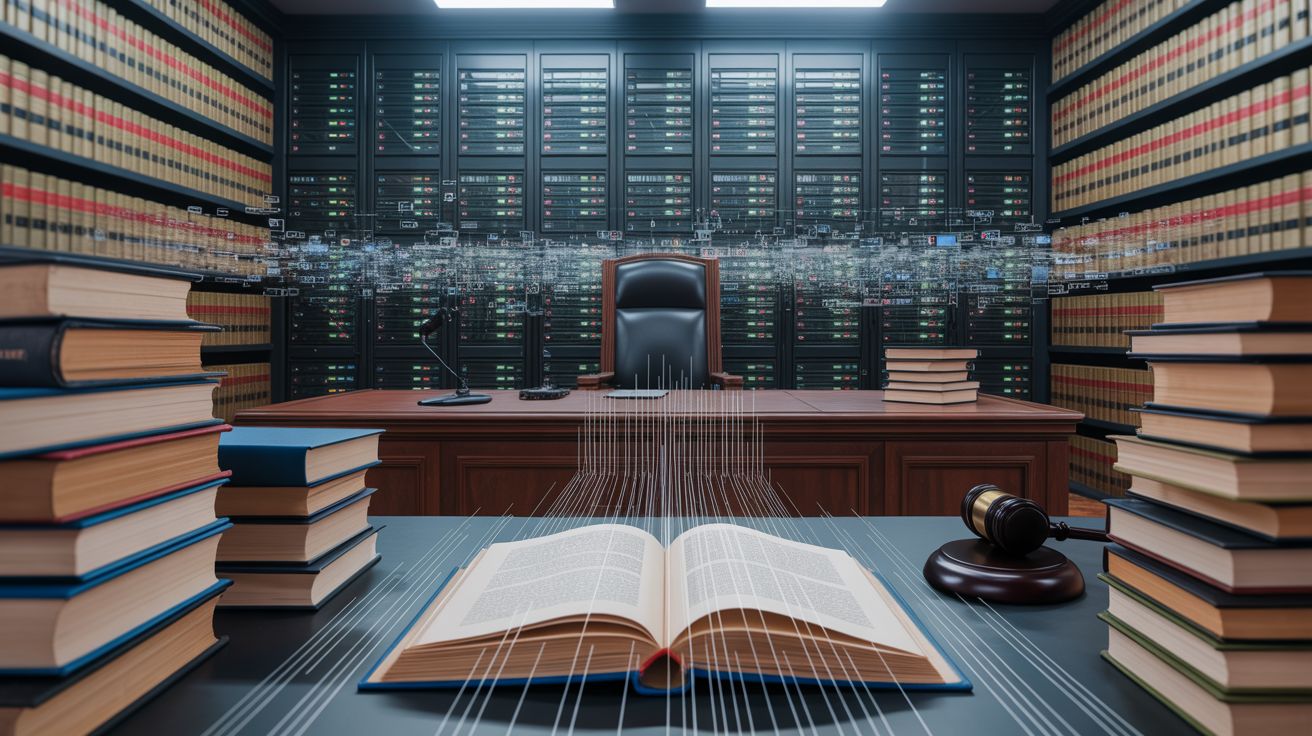

De recente ontdekking van onderzoekers aan vooraanstaande universiteiten zou wel eens een kantelpunt kunnen markeren in de jarenlange juridische strijd tussen auteursrechthebbenden en ontwikkelaars van kunstmatige intelligentie. Tot nu toe hebben techbedrijven herhaaldelijk beweerd dat hun grote taalmodellen (LLM’s) niet letterlijk boeken en andere auteursrechtelijk beschermde werken opslaan, maar er alleen “van leren” op een manier die vergelijkbaar is met hoe mensen leren. Die bewering vormt de kern van hun verdediging tegen een groeiend aantal rechtszaken.

|

|

Copyright laws need to modernize to include fan-made edits - The Miami HurricaneI can’t even count the amount of times I’ve been scrolling through my saved folders on TikTok, Instagram or X to watch video edits of clips from my favorite TV shows, only to find nothing but a shell of what once used to be there, with a body of text over it. It reads: “This |

Maar een nieuwe studie toont overtuigend aan dat deze modellen in sommige gevallen veel tekst letterlijk reproduceren— inclusief lange fragmenten uit populaire en nog steeds beschermde boeken, wat de juridische argumenten van de industrie onder druk zet.

Bewijs dat raakt aan de kern van copyrightwetgeving

Onderzoekers van gerenommeerde instellingen onderzochten meerdere vooraanstaande modellen, waaronder GPT-4.1, Gemini 2.5 Pro, Grok 3 en Claude 3.7, en ontdekten dat sommige van deze systemen in staat waren om fragmenten uit boeken met opvallende nauwkeurigheid te reproduceren. In extreme gevallen kwam bijna een heel werk letterlijk terug in de output.

Bijvoorbeeld:

- Een model reproduceerde een compleet boek bijna woord-voor-woord met een nauwkeurigheid van bijna 96%.

- Andere tests leverden uitgebreide passages op uit bekende romans, met nauwkeurigheids-percentages die soms boven de 75% uit stegen — ondanks dat de originele werken nog onder copyright vallen.

Deze resultaten zijn schadelijk voor de gebruikelijke verdediging van AI-bedrijven: namelijk dat LLM’s alleen patronen leren en geen letterlijke kopieën hanteren. Als modellen effectief beschermd werk kunnen reproduceren, ondermijnt dat argument en zou het juridische consequenties kunnen hebben die de industrie miljarden kunnen kosten in schadevergoedingen.

AI Has Sent Copyright Laws Into Chaos. What You Need to Know About Your Rights OnlineCopyright is one of the most important legal issues in the age of AI, and it affects all of us. |

Juridische implicaties en de verdediging van de industrie

Copyrightwetgeving geeft rechthebbenden het exclusieve recht om hun werk te reproduceren en te distribueren. Veel AI-ontwikkelaars vertrouwen op de “fair use”-doctrine om te betogen dat training op grote hoeveelheden tekst legitiem is. In sommige rechtszaken heeft een Amerikaanse rechter zelfs geoordeeld dat het trainen van AI-modellen met boeken onder fair use valt — maar dat blijft zeer omstreden.

Copyright Law of the United States | U.S. Copyright OfficeCopyright Law of the United States |

Tegelijkertijd lopen meerdere rechtszaken en verzoeken om deelname van uitgevers bij lopende zaken, waaronder tegen grote spelers zoals Google, wat de juridische druk verder opvoert.

Critici beweren dat het idee dat AI “leert zoals een mens” een misleidend comfortgevoel creëert en verhindert dat het publiek het gesprek voert over hoe deze technologie gebruikmaakt van creatieve werken waarop schrijvers, journalisten en artiesten recht hebben op vergoeding.

Researchers Just Found Something That Could Shake the AI Industry to Its CoreResearchers found compelling evidence that AI models are actually copying copyrighted data, not "learning" from it. |

Wat staat er op het spel?

Of rechters de nieuwe bevindingen als doorslaggevend bewijs voor inbreuk op auteursrechten beschouwen, is nog onzeker. Maar de uitkomst van deze lopende en toekomstige rechtszaken kan verstrekkende gevolgen hebben voor de AI-industrie, de rechten van makers en de manier waarop AI ontwikkeld en ingezet wordt.