In de wereld van agentic AI – waar autonome AI-agents taken uitvoeren, beslissingen nemen en workflows automatiseren – is één vraag cruciaal: hoe maak je AI-agents veilig én schaalbaar in productie?

In een nieuwe aflevering van Agentverse laat Google Cloud zien hoe ontwikkelaars de stap zetten van een simpel experiment naar een robuuste, productieklare AI-infrastructuur. Het doel: AI-agents beschermen tegen aanvallen, hun prestaties optimaliseren en tegelijkertijd de kosten van GPU-resources onder controle houden.

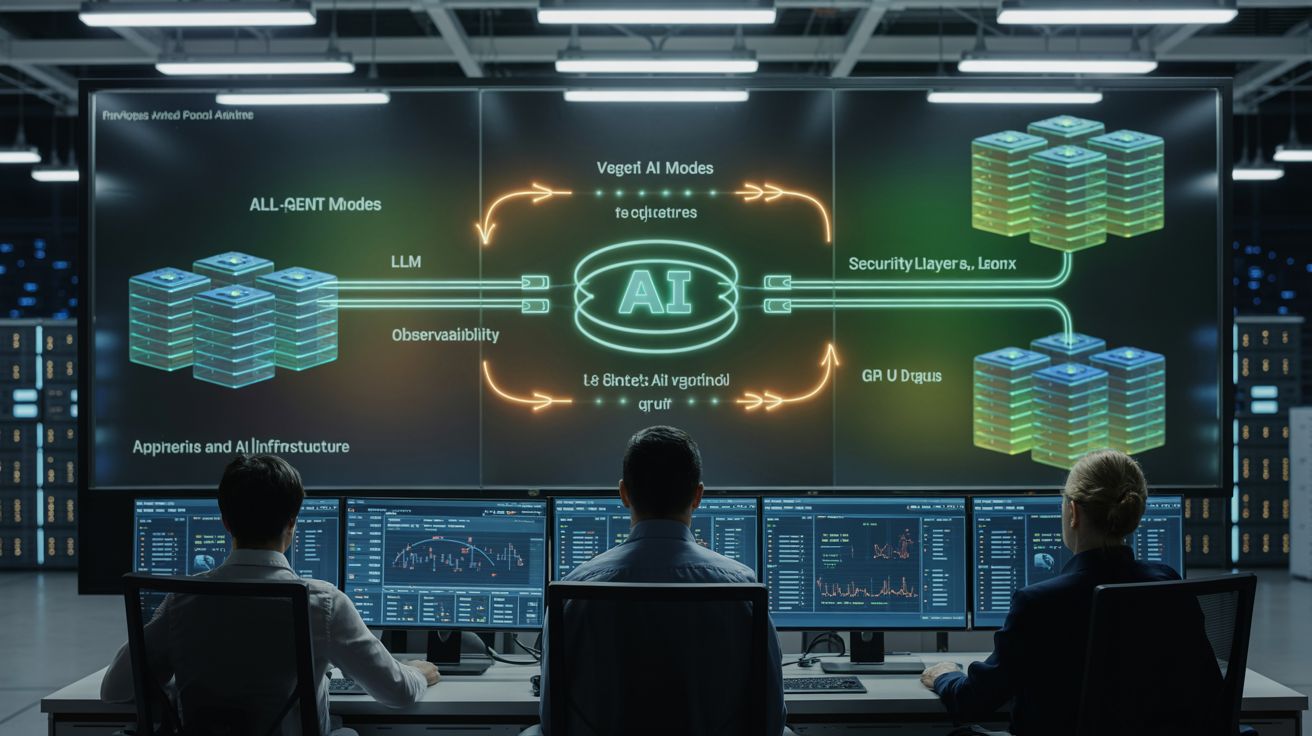

Het resultaat is een architectuur waarin open-source LLM’s, beveiliging, observability en performance-optimalisatiesamenkomen in één betrouwbaar AI-platform.

De uitdaging: AI-agents die écht klaar zijn voor productie

Veel AI-projecten beginnen met een eenvoudige demo. Een model werkt op een laptop of testserver en levert indrukwekkende resultaten.

Maar zodra een organisatie AI-agents in productie wil inzetten, ontstaan er nieuwe uitdagingen:

- Hoe bescherm je het systeem tegen malafide prompts en aanvallen?

- Hoe zorg je dat AI-agents blijven functioneren bij hoge belasting?

- Hoe monitor je wat er gebeurt binnen een complexe AI-pipeline?

- En hoe voorkom je dat GPU-kosten uit de hand lopen?

In Agentverse wordt daarom een duidelijke verschuiving gemaakt:van “Het werkt op mijn machine” naar een enterprise-grade AI-architectuur.

Stap 1: Self-hosted LLM’s met Ollama

De eerste stap in de infrastructuur is het self-hosten van large language models.

Hiervoor wordt gebruikgemaakt van Ollama, een populair open-source platform dat ontwikkelaars toelaat om LLM’s lokaal of op eigen servers te draaien.

De voordelen zijn aanzienlijk:

- Volledige controle over data en privacy

- Minder afhankelijkheid van externe API’s

- Lagere kosten bij intensief gebruik

- Meer flexibiliteit bij modelkeuze

Door LLM’s zelf te hosten, kunnen organisaties hun AI-agents bouwen op een controleerbare en veilige basis.

Stap 2: Snellere inferentie met vLLM

Na de deployment van het model komt de volgende uitdaging: performance.

Hier komt vLLM in beeld, een krachtige inference-engine die speciaal ontworpen is om LLM’s efficiënter te laten draaien op GPU’s.

Met vLLM kunnen ontwikkelaars:

- meerdere verzoeken tegelijk verwerken

- GPU-geheugen efficiënter gebruiken

- latentie drastisch verminderen

- inferentie op grote schaal uitvoeren

Het resultaat is een AI-omgeving die sneller reageert en beter schaalt, zelfs wanneer duizenden verzoeken tegelijk binnenkomen.

Stap 3: Bescherming met Model Armor

Een krachtige AI-agent zonder beveiliging is een risico.

Daarom introduceert Google Cloud Model Armor, een beveiligingslaag die AI-systemen beschermt tegen bekende kwetsbaarheden, zoals:

- prompt injection

- datalekken via modeloutput

- ongewenste modelmanipulatie

- schadelijke of misleidende prompts

Model Armor werkt als een AI-firewall die zowel input als output controleert.

Zo blijft het systeem beschermd, zelfs wanneer gebruikers proberen de AI te manipuleren.

Stap 4: De agent-pipeline bouwen

Zodra het model draait en beveiligd is, kan de echte AI-architectuur worden opgebouwd: de agent pipeline.

Hierin werken verschillende componenten samen:

- de LLM-engine

- tools en API-integraties

- geheugen en contextbeheer

- orchestratie van AI-agents

Deze pipeline zorgt ervoor dat een AI-agent meer doet dan alleen tekst genereren.Hij kan taken uitvoeren, informatie ophalen en complexe workflows automatiseren.

Dit is precies waar agentic AI zich onderscheidt van traditionele AI-toepassingen.

Stap 5: Observability – zien wat AI écht doet

Een van de grootste uitdagingen bij AI-systemen is zichtbaarheid.

Wat gebeurt er precies binnen een agent?Waarom gaf een model een bepaald antwoord?Waar ontstaan vertragingen?

Daarom wordt observability geïntegreerd in de infrastructuur.

Dit omvat onder meer:

- metrics voor prestaties

- tracing van AI-verzoeken

- monitoring van modelgedrag

- analyse van fouten en vertraging

Met deze inzichten kunnen teams hun AI-agents continu verbeteren, beveiligen en optimaliseren.

Een nieuwe standaard voor AI-agent infrastructuur

De aanpak uit Agentverse laat zien dat succesvolle AI-implementaties niet alleen draaien om krachtige modellen.

Ze vereisen een complete infrastructuur waarin deployment, beveiliging, schaalbaarheid en observability naadloos samenwerken.

Voor bedrijven die AI-agents willen inzetten – van marketingautomatisering tot logistiek en klantenservice – wordt dit steeds belangrijker.

De boodschap is duidelijk: AI-agents bouwen is één ding. Ze veilig en schaalbaar maken voor productie is de echte uitdaging.