Tijdens de RSA Conference 2026 positioneert Cisco zich duidelijk: de toekomst van AI draait niet alleen om kracht en autonomie, maar vooral om vertrouwen. In een wereld waarin AI-agents zelfstandig handelen, wordt beveiliging de sleutel tot adoptie én succes.

Van slimme tools naar autonome digitale medewerkers

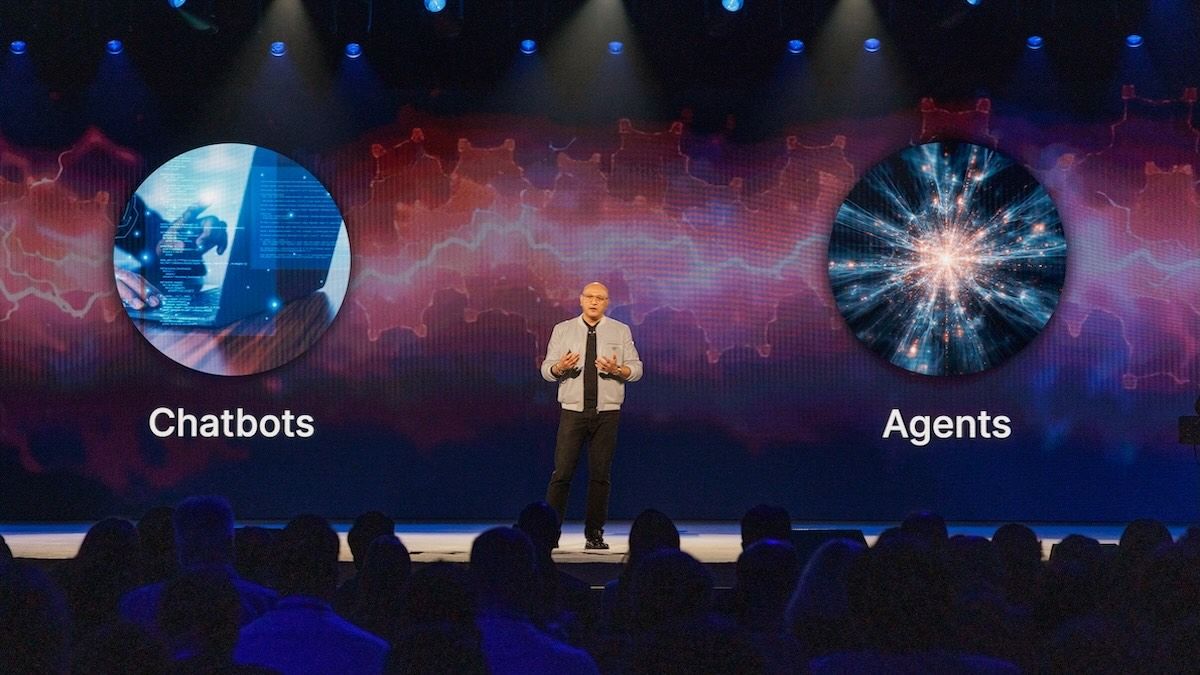

AI evolueert razendsnel van passieve assistent naar actieve uitvoerder. Waar systemen vroeger enkel antwoorden gaven, nemen ze vandaag beslissingen en voeren ze taken zelfstandig uit binnen bedrijfsprocessen.

|

Cisco at RSAC: building trust into agentic AIAgentic AI raises security questions, but agents can also be powerful allies. At RSAC, Cisco and Splunk show the way towards a trusted agentic future. |

Cisco beschouwt deze AI-agents als een nieuwe “digitale workforce”: software die functioneert als collega’s en workflows versnelt en uitbreidt.

Maar die evolutie brengt een fundamentele vraag met zich mee:hoe kan men systemen vertrouwen die zelfstandig handelen op schaal en snelheid van machines?

Het vertrouwenprobleem: Snelheid versus controle

De grootste barrière voor de adoptie van agentic AI is niet technologie, maar vertrouwen. Organisaties vrezen dat autonome agents:

- ongecontroleerde acties uitvoeren

- toegang krijgen tot gevoelige systemen

- fouten maken zonder menselijke tussenkomst

Cisco benadrukt dat AI niet alleen beschermd moet worden tegen externe aanvallen, maar ook dat systemen beschermd moeten worden tegen mogelijk “ongewenst gedrag” van AI zelf.

Het dubbele risico, AI beschermen én tegen AI beschermen, vormt de kern van het huidige AI-paradox.

Zero Trust voor AI: Elke agent krijgt een identiteit

Om dit probleem op te lossen, introduceert Cisco een uitbreiding van het bekende Zero Trust-model naar AI-agents.

Concreet betekent dit:

- elke AI-agent krijgt een verifieerbare identiteit

- toegang wordt strikt beperkt tot specifieke taken en tijdsvensters

- alle interacties worden gecontroleerd via beveiligde gateways

Agents worden dus behandeld zoals menselijke werknemers: Met identiteitscontrole, toegangsbeheer en monitoring.

Dit zorgt voor transparantie: organisaties weten wie (of wat) wat doet, wanneer en waarom.

AI Defense: Systemen continu testen en controleren

Naast toegangscontrole zet Cisco ook in op voortdurende evaluatie van AI-modellen zelf.

Met oplossingen zoals AI Defense kunnen bedrijven:

- AI-modellen testen vóór implementatie

- kwetsbaarheden opsporen via “red teaming”

- gedrag van agents monitoren tijdens runtime

Dit verschuift beveiliging van een statisch proces naar een continu en dynamisch controlemechanisme.

Agentic SOC: AI die security zelf versterkt

Opvallend is dat Cisco AI niet alleen ziet als risico, maar ook als oplossing.

Binnen de security operations (SOC) introduceert het bedrijf gespecialiseerde AI-agents die:

- dreigingen analyseren

- incidenten triageren

- responsprocessen automatiseren

Hier ontstaat een nieuw paradigma: AI beveiligt AI.

Een nieuw beveiligingsmodel voor een nieuw tijdperk

De boodschap van Cisco op RSAC 2026 is helder: Traditionele beveiliging volstaat niet meer.

In een wereld van autonome systemen is nodig:

- identiteitsgedreven security

- fijnmazige toegangscontrole

- realtime observability

- continue validatie van gedrag

Of zoals de industrie het steeds vaker formuleert: AI-agents zijn geen tools meer, maar digitale medewerkers die governance nodig hebben.

Conclusie: Vertrouwen als fundament voor AI-adoptie

De opkomst van agentic AI markeert een kantelpunt. Bedrijven die deze technologie willen inzetten, moeten niet alleen focussen op innovatie, maar vooral op controle en betrouwbaarheid.

Cisco maakt duidelijk dat de toekomst van AI niet draait om wat systemen kunnen doen, maar om wat ze veilig en verantwoord mogen doen.