Medische kunstmatige intelligentie (AI) belooft veel: betere diagnoses, gepersonaliseerde behandelingen, efficiëntere zorg. Maar om dat potentieel te verwezenlijken is één ding cruciaal: vertrouwen. En vertrouwen groeit niet vanzelf. Transparantie — in ontwerp, werking en uitkomsten — is de sleutel voor alle betrokken partijen: patiënten, artsen, ontwikkelaars én toezichthouders. Toch blijken veel medische AI-systemen nog steeds te opereren als ‘black boxes’, waarvan de interne besluitvorming moeilijk te doorgronden is.

Van data tot toepassing: waar de transparantie begint en waar hij hapert

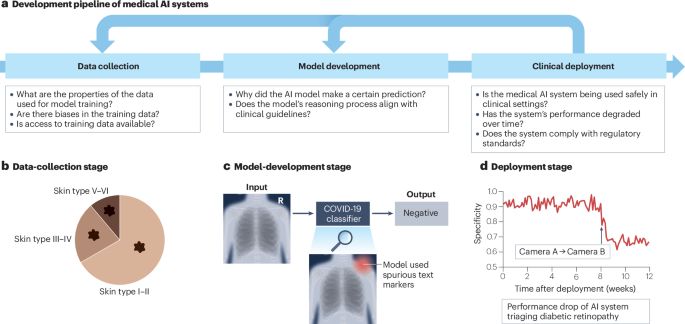

Het artikel beschrijft hoe transparantie een traject moet volgen dat start bij de dataverzameling, door het bouwen van het model en eindigt bij de daadwerkelijke inzet in de klinische praktijk. Hieronder enkele belangrijke knelpunten en uitdagingen:

- Data: vaak ontbreekt goede documentatie over de herkomst, representativiteit (bijv. verschillende bevolkingsgroepen), kwaliteit en vooringenomenheid van de data.

- Modelontwikkeling: hoe zijn beslissingen genomen over modelarchitectuur, hyperparameters, welke features worden gebruikt? Soms zijn die keuzes vaag of niet publiekelijk bekend.

- Uiteindelijk gebruik en prestaties: zelfs als een model in de labsetting goed werkt, kan het in de praktijk minder betrouwbaar zijn, vooral bij populaties of omstandigheden die afwijken van de trainingssituatie. Continue monitoring en updates zijn daarom noodzakelijk.

|

Transparency of medical artificial intelligence systems - Nature Reviews BioengineeringMedical artificial intelligence (AI) systems hold promise for transforming healthcare by supporting clinical decision-making in diagnostics and treatment. The effective deployment of medical AI requires trust among key stakeholders — including patients, providers, developers and regulators — which can be built by ensuring transparency in medical AI, including in its design, operation and outcomes. However, many AI systems function as ‘black boxes’, making it challenging for users to interpret and verify their inner workings. In this Review, we examine the current state of transparency in medical AI, from training data to model development and model deployment, identifying key challenges, risks and opportunities. We then explore a range of t |

Technieken om AI meer begrijpelijk te maken

Gelukkig noemt het artikel ook manieren waarop AI-systemen transparanter kunnen worden gemaakt:

- Uitlegmethoden zoals feature-attributie (welke kenmerken droegen bij aan de voorspelling), concept-gebaseerde verklaringen (hogere-level begrippen in plaats van pure datafeatures) en counterfactual explanations (wat er anders zou moeten zijn om een andere voorspelling te krijgen).

- Documentatie-initiatieven zoals modelkaarten (“model cards”), datasetdocumentatie (“datasheets”) en minimum reporting standards voor medische AI.

- Systemen voor real-world validatie, performance monitoring, en regelmatige updates, ook nadat een AI-systeem is goedgekeurd of in gebruik genomen.

Regelgeving, barrières en de weg vooruit

Een groot deel van de uitdaging zit in de institutionele en praktische barrières:

- Regelgevende kaders moeten transparantie verplicht maken, niet optioneel.

- Klinische workflows moeten worden aangepast zodat transparantie‐tools geïntegreerd worden, bijvoorbeeld zodat artsen begrijpen wat de AI voorspelt en waarom.

- Toegang tot grote taalmodellen (large language models) en AI‐technologie moet meer democratisch worden, zodat niet alleen grote bedrijven of instellingen meebepalen wat “transparant” is.

Vertrouwen scheppen door openheid

Het artikel concludeert dat transparantie geen bijkomstigheid is, maar een onmisbaar onderdeel van veilige, effectieve medische AI. Alleen als systemen begrijpelijk zijn — voor ontwikkelaars, artsen, patiënten én wetgevers — kan de belofte van AI in de gezondheidszorg ten volle worden benut. Het vergt inspanning, maar de inzet is groot: betere zorg, eerlijke toegang, en minder risico’s.