In een opmerkelijke doorbraak heeft een geavanceerde versie van Gemini 2.5 Deep Think van Google DeepMind goud-niveau prestaties geleverd tijdens de World Finals van de International Collegiate Programming Contest (ICPC) 2025. Het systeem loste 10 van de 12 problemen correct op, binnen de strenge tijdslimiet van vijf uur — een resultaat dat de toppers onder de menselijk deelnemers evenaart.

Gemini AI solves coding problem that stumped 139 human teams at ICPC World FinalsGemini shows off at another high-level academic competition. |

De wedstrijd: Wat is de ICPC?

- De ICPC, bekend als een van de meest prestigieuze programmeerwedstrijden voor studenten wereldwijd, trekt deelnemers van universiteiten uit meer dan 100 landen.

- In de wereldfinale namen 139 teams deel. Elke ploeg bestond uit drie studenten die één computer deelden. Slechts vier teams verwierven een gouden medaille.

- De wedstrijd bevat twaalf complexe algoritmische programmeerproblemen die binnen vijf uur opgelost moeten worden. Fouten zijn niet toegestaan voor een volledig score; tijd speelt mee in de rangschikking.

|

Google DeepMind claims ‘historic’ AI breakthrough in problem solvingVersion of company’s Gemini 2.5 AI model solved complex real-world problem that stumped human programmers |

Wat Gemini precies deed

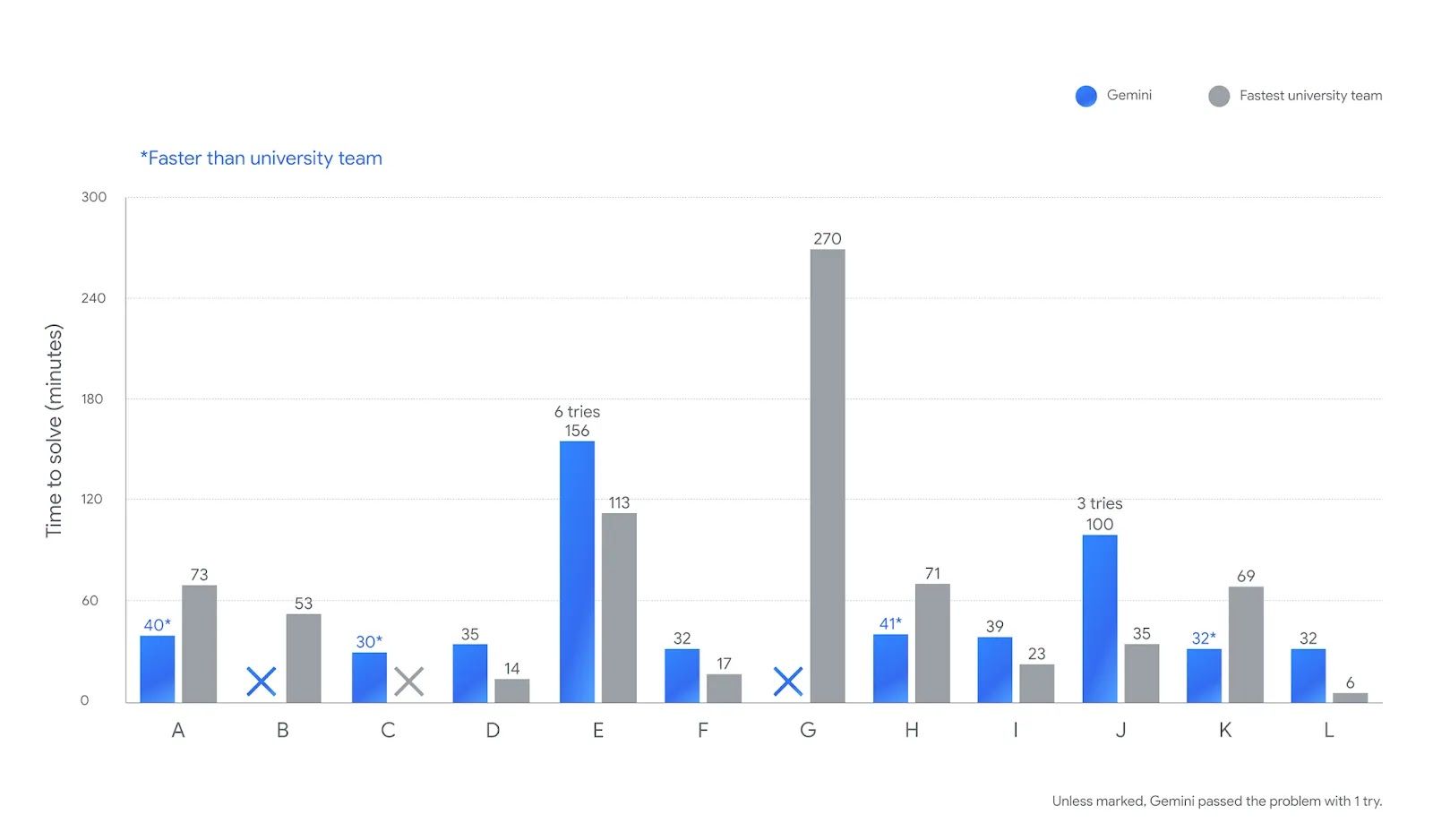

- 10 van de 12 problemen opgelost: Gemini 2.5 Deep Think wist tien problemen volledig correct op te lossen onder de wedstrijdvoorwaarden.

- Probleem C: Een van die problemen, “Problem C”, loste Gemini op, iets waar géén menselijk team in slaagde. Dit probleem betrof het optimaliseren van vloeistofdistributie via een netwerk van kanalen en reservoirs, onder complexe voorwaarden.

- Tijd en efficiëntie: Gemini voltooide acht problemen binnen 45 minuten, en twee extra in de loop van drie uur. De totale tijd voor de tien correcte oplossingen bedroeg 677 minuten (onder de limiet van de wedstrijd).

|

AI Models Match Human Coders at Global ContestOpenAI’s GPT-5 and DeepMind’s Gemini rival top student programmers at ICPC finals, solving unprecedented algorithmic challenges. |

Betekenis en context

Deze prestatie komt kort na Gemini’s gouden medaille-niveau resultaat bij de International Mathematical Olympiad (IMO). Het bevestigt een trend: AI-modellen worden steeds beter in abstract redeneren en in het oplossen van problemen die creativiteit, logica en innovatie vereisen.

Experts waarschuwen echter dat winst in programmeerwedstrijden niet automatisch betekent dat AI ook in alle praktijkomgevingen menselijke programmeurs zal evenaren. Praktische softwareontwikkeling vraagt ook om onderhoudbaarheid, samenwerking, integratie, long-term debugging etc.

DeepMind and OpenAI achieve gold at ‘coding Olympics’ in AI milestoneArtificial intelligence labs attain top grade in prestigious programming contest |

Google maakt bekend dat een lichtere versie van Gemini 2.5 Deep Think al beschikbaar is voor abonnees van Google AI Ultra via de Gemini app.. De doorbraak roept vragen op over de rol van AI als partner voor menselijke programmeurs, en hoe AI ingezet kan worden bij wetenschappelijk onderzoek, engineering en andere domeinen waar abstract denken van groot belang is.

Gemini 2.5 Deep Think heeft met zijn prestaties bij ICPC een belangrijke mijlpaal gezet in de ontwikkeling van AI-systemen die buiten enkel patroonherkenning gaan: werkelijke probleemoplossing onder tijdsdruk, met logica en abstract denken. Hoewel het geen wedstrijd tussen mens en AI was in de traditionele zin (AI was geen officieel deelnemer), laat het zien hoe snel de grenzen van wat AI kan verleggen, opschuiven.

|

Gemini achieved gold-medal performance at the International Collegiate Programming Contest World Finals.Gemini achieves gold status at the ICPC, marking a new leap in AI's abstract problem-solving. |