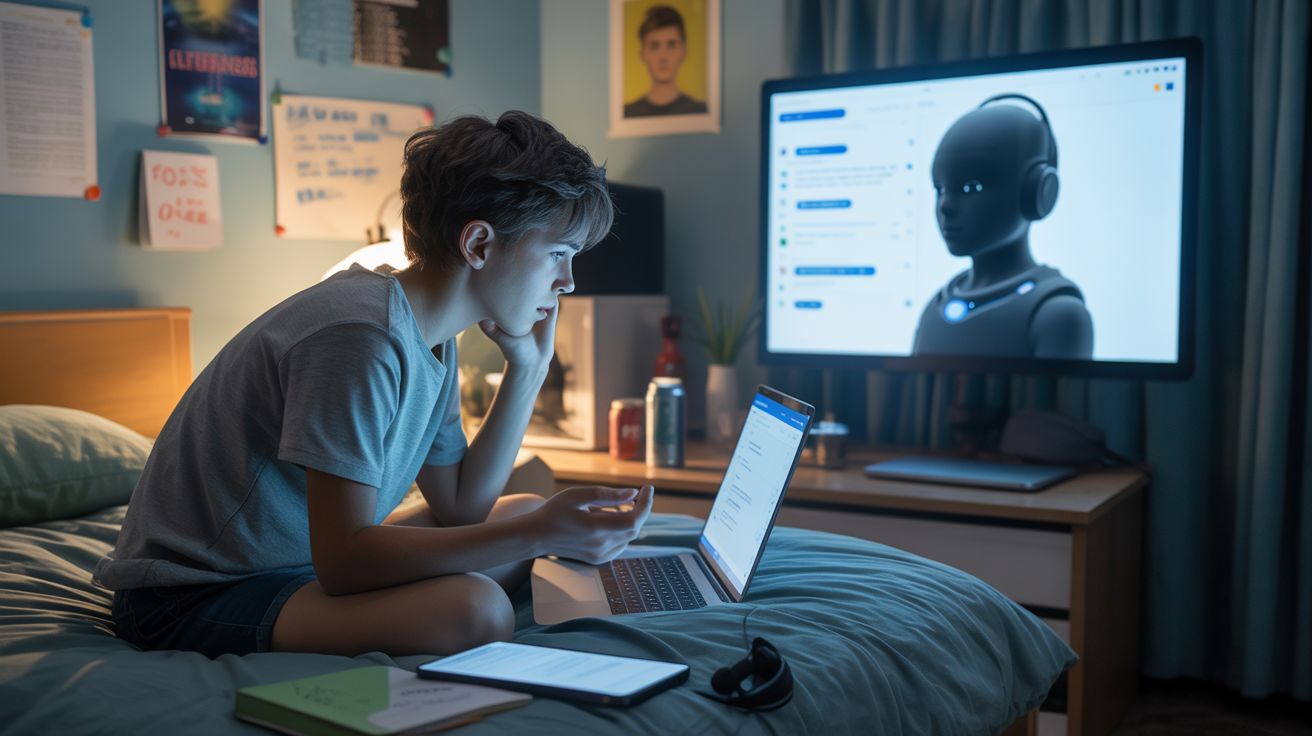

AI-chatbots als dagelijkse metgezellen van jongeren

In de snel evoluerende digitale wereld worden AI-chatbots niet langer gezien als simpele informatiehulpmiddelen, maar als systemen die relationele rollen vervullen — denk aan studiehulp, klankbord voor gevoelens of zelfs emotionele ondersteuning. Voor veel jongeren zijn deze systemen altijd beschikbaar en klinken ze geruststellend en “vertrouwd”, wat hun aantrekkingskracht vergroot.

Waarom beleid nodig is — meer dan technologie alleen

Helen Hayes, een expert in communicatiewetenschap aan de McGill University, vraagt zich af: hoe gebruiken jonge mensen AI-chatbots werkelijk? En welke risico’s brengen ze met zich mee? Haar project, onderdeel van de MILA AI Policy Fellowship, onderzoekt precies dat — en zoekt naar beleidsroutes die specifiek gericht zijn op het verminderen van schade voor jongeren.

Waar traditionele regelgeving chatbots vaak als eenvoudige tools ziet, stellen jongeren hen tegenwoordig op een andere manier voor: als digitale gesprekspartners. Dit betekent dat ze emotionele en cognitieve effecten kunnen hebben die verder gaan dan alleen “fout-of-correcte antwoorden”.

Risico’s: Van emotionele afhankelijkheid tot cognitieve valkuilen

Uit vroege discussies onder jongeren komt naar voren dat AI-chatbots enkele specifieke zorgen oproepen:

- Emotionele afhankelijkheid: Chatbots kunnen menselijke verbinding vervangen, waardoor jongeren zich meer richten op machines dan op echte sociale relaties.

- Gematigde denkvaardigheden: Wijdverspreid gebruik kan leiden tot cognitieve “offloading”, waarbij jongeren hun eigen reflectie- en kritische denkvaardigheden minder inzetten omdat AI dit steeds gemakkelijker maakt.

- Blootstelling aan schadelijke inhoud: Zonder sterke safeguards kunnen jongeren worden blootgesteld aan expliciete, radicale of schadelijke teksten.

Deze risico’s tonen aan dat conventioneel toezicht op AI — zoals simpele inhoudsfilters — niet genoeg is. Hayes benadrukt dat we moeten kijken naar hoe chatbots worden ingezet en ervaren, met name door jonge gebruikers die in een gevoelige ontwikkelingsfase zitten.

Van risico’s naar beleidsaanbevelingen

Het onderzoeksproject van Hayes beoogt:

- Policygaps in kaart te brengen: Waar ontbreken regels op dit moment om jongeren te beschermen?

- Gebaseerde aanbevelingen te formuleren: Beleidsmaatregelen moeten worden ondersteund door bewijs, niet alleen sectorlogica of technologische trends.

- Ontwerpen van “child-centred AI governance”: Denk aan wettelijke leeftijdscontrole, expliciete veiligheidsregels voor chatinteracties met minderjarigen, en transparantie over wat AI weet en doet.

Een belangrijk thema uit deze gesprekken is dat jongeren zelf willen meedenken over de toekomst van AI-beleid — niet alleen als objecten van bescherming, maar als actieve stakeholders.

Bescherming is meer dan filtering

Het werk van Hayes toont dat het niet volstaat om schadelijke inhoud simpelweg te blokkeren. Beleidsmakers moeten begrijpen dat AI-chatbots een diepe impact kunnen hebben op aandacht, vertrouwen, afhankelijkheid en mentale gewoonten — vooral wanneer ze gemak, geruststelling en “antwoordzekerheid” bieden.

Voor jongeren kan een AI-chatbot voelen als een vriend — precies om die reden ligt er een enorme verantwoordelijkheid bij ontwerpers, platformen en beleidsmakers om veilig beleid, robuuste governance en ethische richtlijnen te ontwikkelen.