Waarom kosten per token de nieuwe graadmeter zijn voor AI

In het tijdperk van realtime redenerende AI verschuift de focus. Pure performance – uitgedrukt in FLOPS – volstaat niet langer. De echte vraag is nu: wat kost één token intelligentie?

Met de opkomst van reasoning-modellen zoals mixture-of-experts (MoE) stijgt de kwaliteit van antwoorden aanzienlijk. Maar die verbetering heeft een prijs. Deze modellen genereren enorme hoeveelheden tokens en zetten tegelijkertijd druk op compute, geheugen, netwerken, opslag én software.

De nieuwe maatstaf voor succes? Cost per token. Wie AI op schaal wil inzetten, moet niet alleen snel zijn, maar vooral efficiënt.

De verborgen kosten van redeneermodellen

MoE-architecturen werken anders dan traditionele modellen. In plaats van één groot model dat alles verwerkt, schakelen ze meerdere gespecialiseerde “experts” in per taak. Dat verhoogt de nauwkeurigheid, maar introduceert ook complexe routering en intensieve communicatie tussen componenten.

Hier ontstaan de verborgen kosten:

- Dataverkeer tussen GPU’s

- Latentie in netwerkverbindingen

- Synchronisatie-overhead

- Opslag- en geheugenbelasting

In deze nieuwe AI-paradigma’s zijn interconnectie en netwerkarchitectuur net zo belangrijk als ruwe rekenkracht.

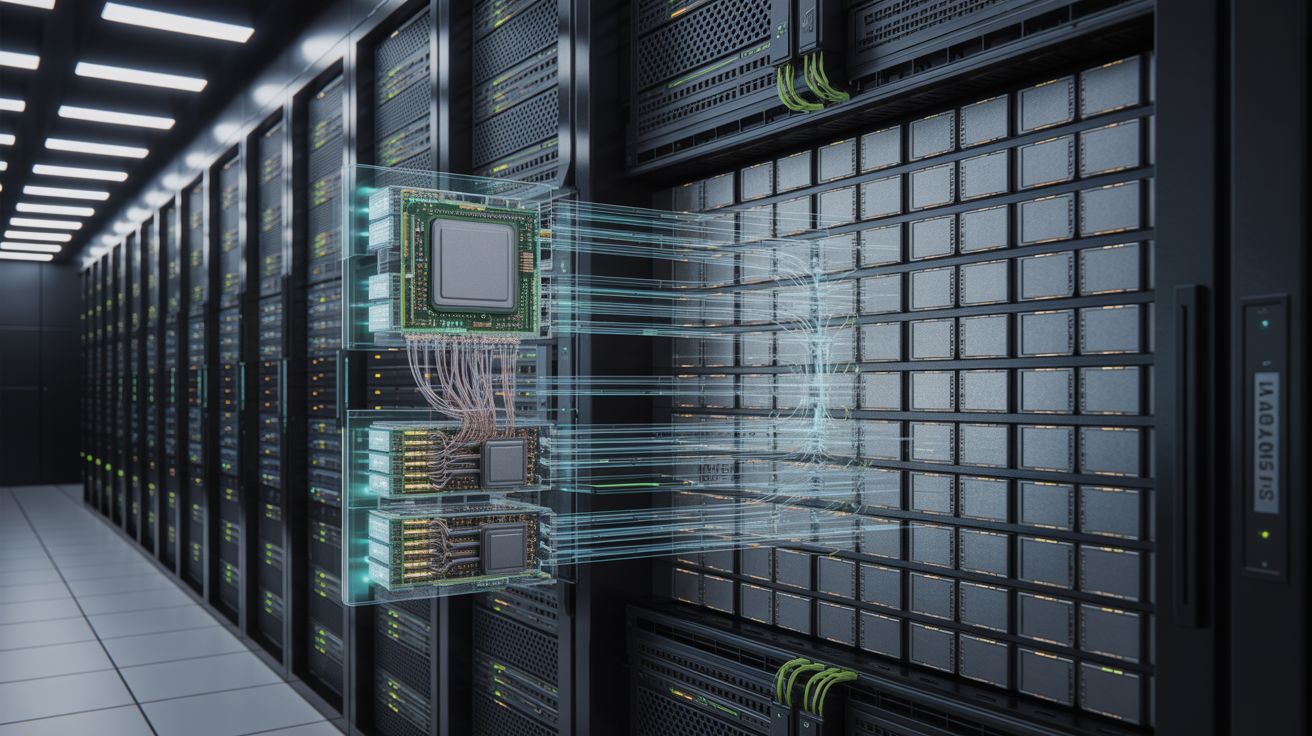

Rack-scale innovatie met de NVIDIA GB200 NVL72

Om deze uitdagingen aan te pakken, ontwikkelde NVIDIA het rack-scale systeem GB200 NVL72. Dit is geen losse chip of GPU, maar een volledig geïntegreerd AI-systeem op rack-niveau.

Door compute, geheugen en networking extreem dicht bij elkaar te brengen, wordt de communicatie tussen experts drastisch versneld. Het resultaat:

- Lagere latency

- Minder energieverlies

- Hogere token-efficiëntie

- Betere schaalbaarheid voor reasoning workloads

Dit soort architectuur bewijst dat systeemintegratie de sleutel is tot lagere kosten per token.

Blackwell en Ruben: AI als één geïntegreerd ecosysteem

Met de introductie van de Blackwell-architectuur tilt NVIDIA AI-ontwerp naar een nieuw niveau. Blackwell is niet alleen een chipinnovatie; het is een geïntegreerde benadering waarin silicon, interconnect, networking en software samen worden ontworpen.

Deze extreme co-design filosofie betekent dat:

- Chips worden geoptimaliseerd voor specifieke AI-workloads

- Netwerken worden ontworpen rond datastromen van MoE-modellen

- Software optimaal gebruikmaakt van hardwarecapaciteiten

- Cloudplatformen zoals Microsoft Azure de infrastructuur schaalbaar maken

Samen met partners zoals Signal65 en CoreWeave wordt duidelijk dat end-to-end systeemdesign de grootste hefboom is voor AI-ROI.

Van brute kracht naar slimme efficiëntie

De AI-industrie bevindt zich op een kantelpunt. Waar voorheen schaal synoniem stond voor meer GPU’s, draait het nu om intelligente integratie van de volledige stack.

Extreme co-design betekent:

- Geen optimalisatie per component

- Maar optimalisatie van het gehele ecosysteem

- Gericht op maximale token-output tegen minimale kosten

In een wereld waarin reasoning AI steeds meer realtime beslissingen neemt – van enterprise automation tot wetenschappelijk onderzoek – wordt efficiënte tokenomics dé strategische factor.

Wie AI op schaal wil uitrollen, moet dus niet alleen denken in termen van snelheid of modelgrootte, maar in termen van architectuur als concurrentievoordeel.