Wat als je jezelf moeiteloos in élke video kunt zetten — met vloeiende bewegingen, realistische camera-acties en volledige controle over de scène? Met Nano Banana Pro en Kling 3.0 Motion Control wordt die ambitie verrassend praktisch. In een recente workflowdemonstratie laat ElevenLabs zien hoe makers in enkele stappen gepersonaliseerde, virale AI-video’s bouwen waarin beweging eindelijk klopt.

Beweging als ontbrekende schakel in AI-video

AI-video’s zagen er al snel indrukwekkend uit, maar beweging bleef vaak haperen of onnatuurlijk. Kling 3.0 Motion Control pakt precies dat probleem aan. Het systeem koppelt een referentiebeweging aan een stilstaand beeld of personage, waardoor animaties niet alleen mooier, maar ook geloofwaardiger worden.

Het resultaat: video’s waarin mensen lopen, draaien of door een ruimte bewegen met een realisme dat tot voor kort moeilijk haalbaar was.

Twee modi, twee creatieve strategieën

Kling 3.0 Motion Control heeft twee duidelijke verwerkingsmodi, elk met een eigen focus:

- Match Image - Deze modus werkt tot 10 seconden en concentreert zich op detail. Texturen, gezichten en kleding blijven scherp, terwijl statische pixels worden vervormd om een bewegingspad te volgen. Ideaal voor korte, visueel sterke clips.

- Match Video - Tot 30 seconden lang en gericht op precieze lichaamsbewegingen en cameratrajecten. Skeletbewegingen, diepte en panning worden nauwkeurig gevolgd, waardoor scènes met lopen of dynamische camerabewegingen veel natuurlijker aanvoelen.

Samen geven deze modi makers de keuze tussen maximale visuele finesse of ruimtelijke precisie.

Een workflow die begint met karakter

De aanpak start in Nano Banana Pro, waar een hoogwaardige startframe wordt gegenereerd. Dit beeld legt de ‘likeness’ vast: het gezicht, de houding en de uitstraling van het personage. Dat kan een avatar zijn, maar net zo goed de maker zelf.

Vervolgens worden in dezelfde omgeving korte motion-reference-video’s gemaakt. Door simpele prompts — een stap vooruit, een draai, een handgebaar — ontstaat een referentieclip op basis van een mannequin of basisfiguur.

Beweging toepassen, sfeer sturen

Die referentievideo wordt daarna gekoppeld aan het originele karakterbeeld in Kling 3.0 Motion Control. De beweging dicteert de actie, terwijl extra tekstprompts subtiel de achtergrond, belichting en sfeer beïnvloeden.

Het resultaat is een opvallend gecontroleerde animatie: dezelfde persoon, maar met telkens andere bewegingen, settings en camera-effecten.

Van experiment naar virale content

Wat deze workflow onderscheidt, is de vrijheid voor makers. Je hoeft niet langer te passen in bestaande stockbeelden of generieke avatars. Je kunt jezelf — of een eigen personage — in elke denkbare video plaatsen.

|

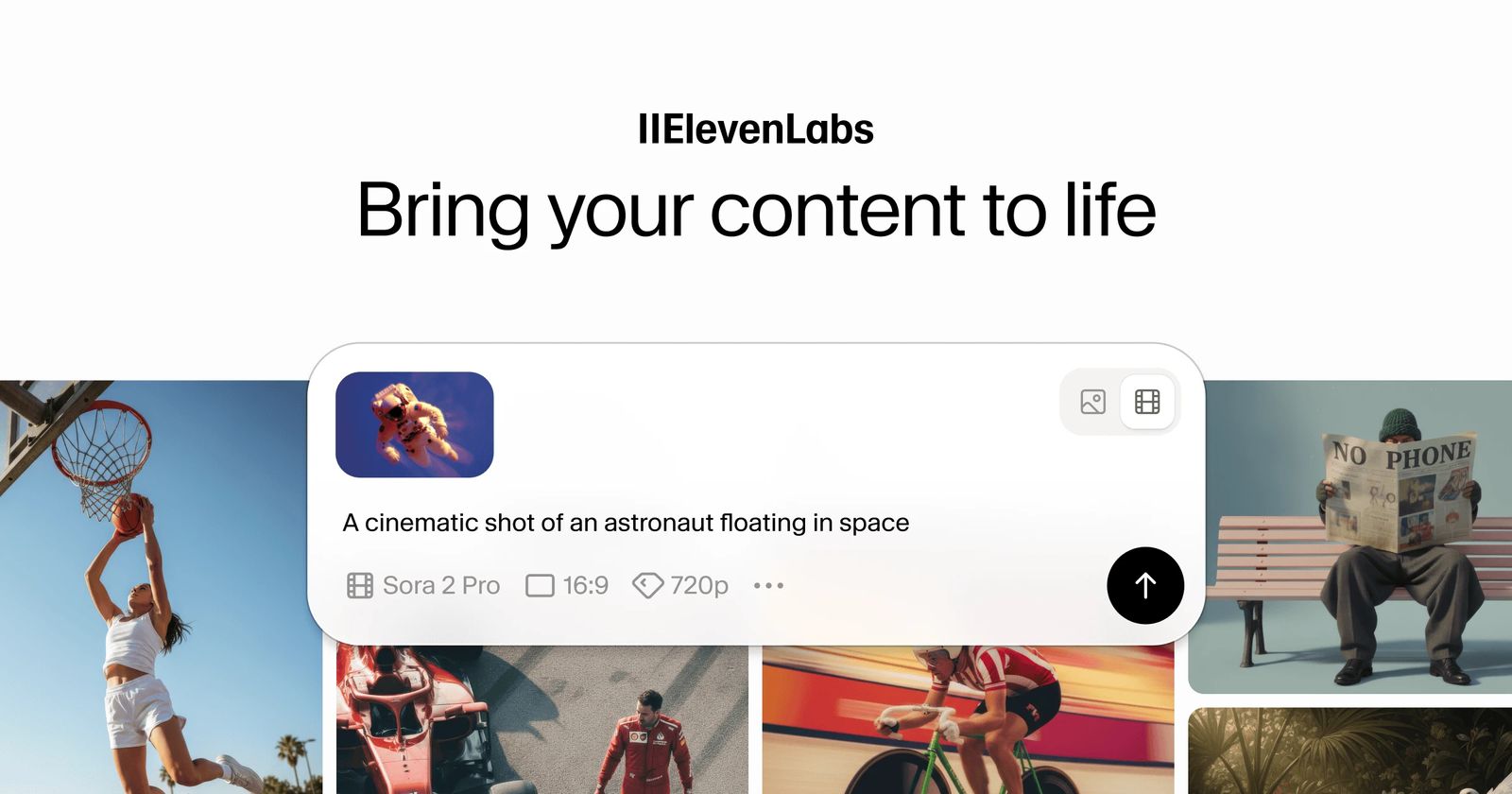

Image and Video Generation with ElevenLabs Audio ToolsCreate stunning AI images and videos, then refine them with natural voices, music, and sound design in ElevenLabs Studio. |

Voor content creators, marketeers en storytellers betekent dit een nieuwe fase van personalisatie: AI-video’s die niet alleen snel worden gegenereerd, maar ook persoonlijk en deelbaar zijn.

AI-video groeit op

Nano Banana Pro en Kling 3.0 Motion Control laten zien hoe AI-video evolueert van visuele gimmick naar volwaardig creatief instrument. Beweging, identiteit en regie komen samen in één workflow. En precies daar ligt de sleutel tot de volgende golf virale video’s.