In een tijd waarin AI-experimenten vaak afhankelijk zijn van omvangrijke datacenters en complexe infrastructuren, toont Dell met de Pro Max met GB10 hoe krachtig en toegankelijk AI-ontwikkeling op lokaal niveau kan zijn. Met slechts enkele stappen bouw je een geavanceerde multi-agent chatbot die draait op een lokale LLM — en dat zonder externe cloud-api’s.

AI-kracht op je bureau: Wat je opbouwt

Dell belooft dat je op het einde van deze workflow hebt:

- Een lokale webinterface (Spark Chat) die draait op de GB10

- Een multi-agent chatbot op basis van een lokaal LLM

- Live inzicht in GPU-gebruik terwijl er daadwerkelijk chat-verzoeken worden verwerkt

- En een schone afsluiting van alle gebruikte systemen zodat je opnieuw kunt beginnen.

|

From Setup to Chat: Running NVIDIA’s Multi‑Agent Chatbot on Dell Pro Max with GB10 | Dell TechnologiesBuilding and running a multi‑agent AI chatbot no longer needs a data center or a complex cluster. With the Dell Pro Max with GB10, you can stand up a powerful, GPU‑accelerated chatbot locally in a matter of minutes—then actually see how your GPU is being used as you chat. This article walks through the experience of deploying NVIDIA’s “Build and Deploy a Multi‑Agent Chatbot” playbook on a GB10, explains what’s happening under the hood in simple terms, and shows you how to clean up resources after the demo. It’s written for technically curious readers: you’re comfortable with basic commands and web UIs, but you don’t need to be a DevOps engineer. |

Voorbereiding: GB10 klaarzetten

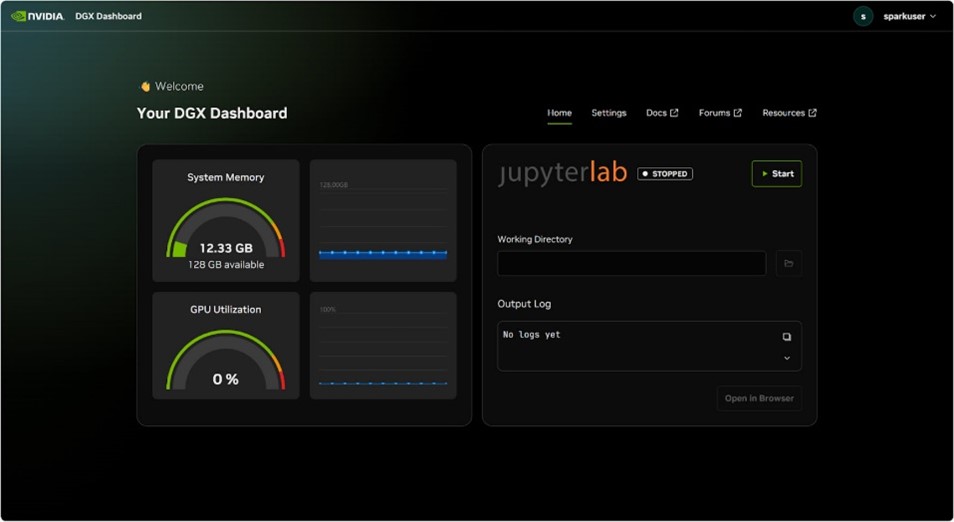

Voordat het echte werk begint, moet de GB10 volledig geïnstalleerd en bijgewerkt zijn via het DGX Dashboard. Dit webgebaseerde dashboard op de GB10 vereenvoudigt beheer, onderhoud en integratie van AI-tools — zonder dat je uitgebreide commandolijn-kennis nodig hebt.

Zorg er in deze fase ook voor dat:

- Internet verbonden is — cruciaal tijdens de eerste setup om modellen en containers te downloaden

- Je op de GB10 zelf werkt, of via remote verbinding met een SSH-tunnel vanaf een andere laptop.

Stap 1: DGX Dashboard openen

Op het GB10-scherm klikt de gebruiker op “Show apps” en start het DGX Dashboard. Het geeft een visuele, intuïtieve toegang tot updates, monitoring en tools zoals Jupyter, allemaal geïntegreerd met de onderliggende NVIDIA-AI-stack.

Stap 2: Het Multi-Agent Chatbot Playbook openen

Dell verwijst gebruikers naar het NVIDIA Spark-playbook dat speciaal is samengesteld om een multi-agent chatbot te bouwen. Hier staan de stapsgewijze instructies, van repository-clone tot container orchestration, overzichtelijk opgesomd.

Stap 3: Playbook-commando’s draaien

Door de commando’s van het playbook in een terminal te plakken, wordt:

- de playbook-repository gekloond

- de nodige modellen gedownload en voorbereid

- en een reeks containers gebouwd en gestart

Deze containers vormen het hart van de chatbot-architectuur.

Stap 4: Wachten tot alles gezond is

Een belangrijk moment is het draaien van een watch-commando dat laat zien of alle containers “healthy” worden. Zodra dit het geval is, is de infrastructuur klaar voor interactie.

Stap 5: De Spark Chat UI openen

Wanneer de containers hun status bereiken, opent de gebruiker een browser op http://localhost:3000 om de Spark Chat-interface te zien. Hier kun je kiezen tussen modes zoals “Chat / Local LLM” en ook beeldverwerking uitproberen.

Stap 6: Chatten en GPU-gebruik zien

In de Spark Chat UI kan men bijvoorbeeld het verzoek typen:“Leg in simpele termen uit hoe een multi-agent chatbot werkt.”

Terwijl de chatbot antwoordt, toont de GPU-monitor realtime hoe de GB10-hardware de opdracht verteert — een visuele herinnering aan de rauwe AI-kracht op je bureau.

Beeldverwerking als extra spelletje

Naast tekst kan de chatbot ook beeld verwerken. De gebruiker kan een afbeelding uploaden en via de Image Processor-modus analyseren. Dit illustreert hoe multi-modal AI direct lokaal werkt, ongeacht of het om woorden of beelden gaat.

Afsluiten: containers opruimen

Wanneer de demo klaar is, is het aan te raden alle containers te stoppen en op te ruimen. Dat maakt het systeem klaar voor hernieuwde experimenten. Met enkele Docker-commando’s worden alle services gestopt en opgeslagen data veilig verwijderd.

Waarom dit ertoe doet

Dell benadrukt dat lokaal draaien van een multi-agent chatbot geen gimmick is, maar een praktische aanpak met echte voordelen:

- Data-controle: geen gevoelige prompts of outputs die een externe cloud verlaten

- Performance: lage latentie doordat de GPU dichtbij staat

- Experimentatie: snel itereren met workflows en agentgedrag

- Educatie: inzichtelijke AI-demo’s voor teams en klanten.