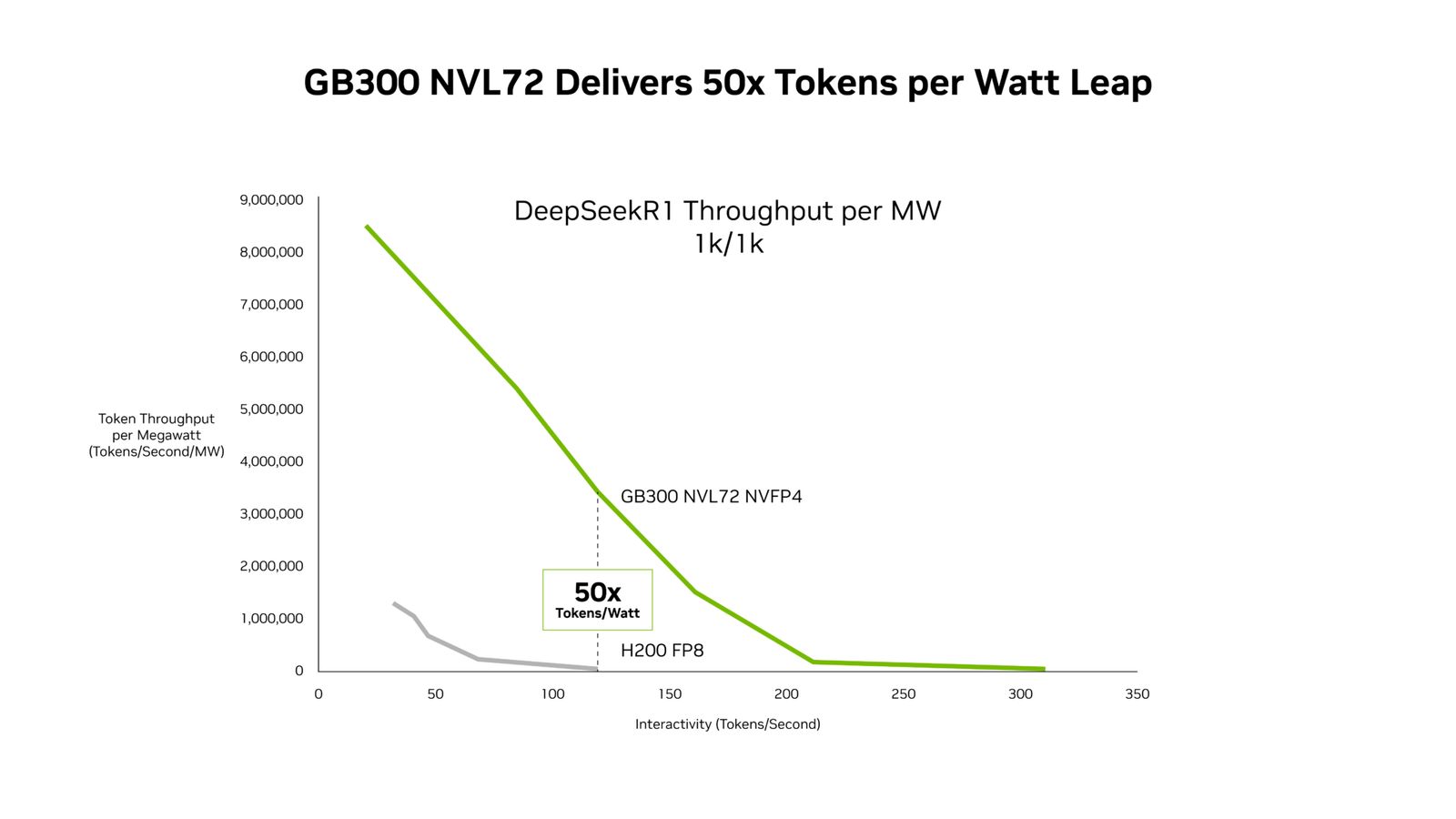

In de ijltempo-wereld van kunstmatige intelligentie zet NVIDIA opnieuw een enorme stap vooruit met zijn nieuwste datacenterplatform: Blackwell Ultra. Nieuwe analyses laten zien dat deze generatie tot wel 50× meer throughput per megawatt realiseert en 35× lagere kosten per token voor agent-achtige AI-systemen — dramatische verbeteringen die de schaalbaarheid van AI-agents opnieuw vormgeven.

Waarom dit belangrijk is

AI-agents — systemen die autonoom complexe, meerstappen taken uitvoeren — vormen de volgende frontier van AI-toepassingen. Denk aan geavanceerde programmeerassistenten, intelligente workflow-automatisering of realtime redenerende modellen met lange contexten — allemaal afhankelijk van enorme verwerkingscapaciteit en lage latentie. Traditionele platforms liepen snel tegen kost-en-efficiëntie-beperkingen aan. Blackwell Ultra verandert die dynamiek radicaal.

|

New SemiAnalysis InferenceX Data Shows NVIDIA Blackwell Ultra Delivers up to 50x Better Performance and 35x Lower Costs for Agentic AINew SemiAnalysis InferenceX Data Shows NVIDIA Blackwell Ultra Delivers up to 50x Better Performance and 35x Lower Costs for Agentic AI. Microsoft, CoreWeave and Oracle Cloud Infrastructure are deploying NVIDIA GB300 NVL72 systems at scale for low-latency and long-context use cases. |

Gigantische prestatieboost per watt

Uit nieuwe prestatiedata blijkt dat het NVIDIA GB300 NVL72-systeem — aangedreven door Blackwell Ultra GPUs — tot wel 50× hogere throughput per megawatt kan leveren vergeleken met de vorige Hopper-generatie. Deze enorme efficiëntiesprong betekent dat datacenters en cloudproviders met dezelfde energiehuishouding veel meer AI-werk kunnen verzetten.

De kern van dit succes zit in een extreme co-design — een symbiose van hardware én software — waarbij onder andere geoptimaliseerde GPU-kernbewerkingen, efficiëntere geheugencommunicatie en vooruitlopende software-tools (zoals TensorRT-LLM en Dynamo) samenkomen.

Kosten per token kelderen dramatisch

Voor AI-werkzaamheden zoals agentic coding en interactieve assistenten — workloads waarin elke milliseconde telt — vertaalt de prestatieverbetering zich direct door in besparingen. Het GB300 NVL72-systeem realiseert tot 35× lagere kosten per miljoen tokens dan de vorige generatie.

Dat is niet alleen goed nieuws voor hyperscale spelers, maar ook voor ontwikkelaars en ondernemingen die AI-agents willen inzetten zonder torenhoge infrastructuurkosten.

Langere contexttaken worden goedkoper

Voor toepassingen die lange contexten vereisen — bijvoorbeeld AI-tools die grote code-bases begrijpen — biedt Blackwell Ultra ook voordelen. In scenario’s met inputs van 128 000 tokens (en outputs van 8 000 tokens) levert GB300 NVL72 tot 1,5× lagere kosten per token dan de eerdere Blackwell-generatie.

Dit betekent dat AI-agents die uitgebreid moeten “lezen” en diep moeten redeneren, efficiënter kunnen werken dan ooit tevoren.

Reële adoptie bij cloud-providers

Grote cloud-spelers zoals Microsoft Azure, CoreWeave en Oracle Cloud Infrastructure (OCI) rollen de Blackwell Ultra-gebaseerde systemen al uit voor echte workloads. Dit toont dat de volgende generatie AI-infrastructuur niet langer theoretisch is, maar praktisch inzetbaar voor bedrijven die schaalbare en betaalbare agent-AI willen leveren.

Wat komt hierna?

Hoewel Blackwell Ultra zelf al indrukwekkend is, kijkt de industrie al vooruit naar nog krachtigere platforms — zoals de opkomende Vera Rubin-architectuur, die volgens NVIDIA nog grotere doorbraken in throughput en kosten kan realiseren.