Techgigant versnelt ontwikkeling van custom silicon voor het AI-tijdperk

De wereldwijde AI-race draait niet alleen om algoritmes en modellen, maar steeds meer om rekenkracht. En precies daar zet Meta Platforms een nieuwe strategische stap. Het technologiebedrijf achter Facebook, Instagram en WhatsApp werkt aan vier nieuwe generaties eigen AI-chips, die tegen 2027 moeten worden uitgerold om de groeiende AI-workloads van het bedrijf te ondersteunen.

Volgens berichtgeving van Bloomberg wil Meta minder afhankelijk worden van externe chipfabrikanten en tegelijk zijn AI-infrastructuur efficiënter maken. Het plan past in een bredere trend waarin techbedrijven steeds vaker eigen silicon ontwerpen om hun AI-ambities waar te maken.

Van sociale media naar AI-infrastructuur

Meta staat al jaren bekend als een sociale-mediabedrijf, maar de onderneming transformeert zich steeds meer tot een AI-gedreven technologieplatform.

AI speelt inmiddels een centrale rol in:

- contentaanbevelingen op Facebook en Instagram

- advertentie-optimalisatie

- generatieve AI-tools voor creators

- virtuele assistenten en chatbots

- AI-training voor toekomstige producten

|

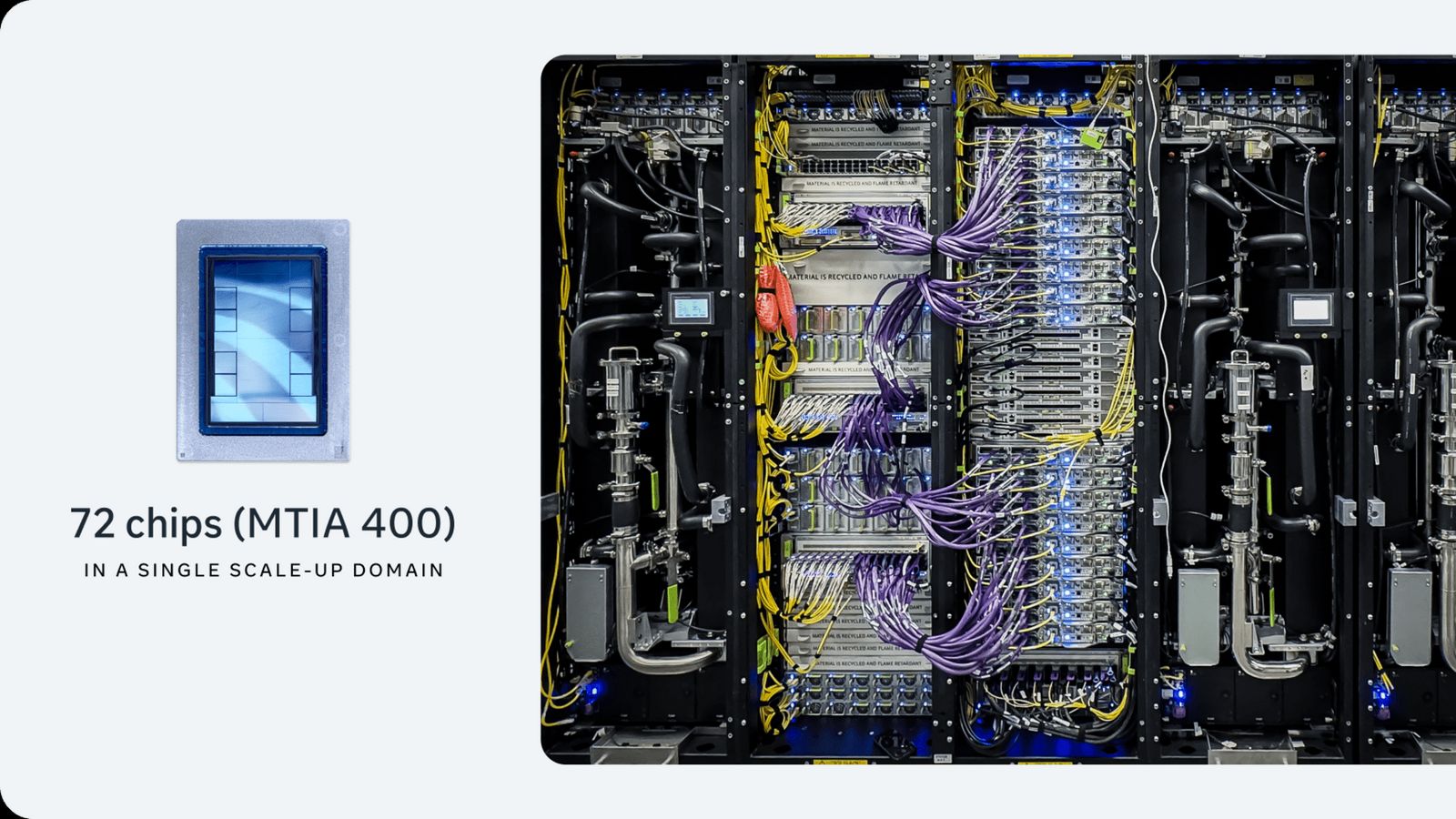

Meta rolls out in-house AI chips weeks after massive Nvidia, AMD dealsMeta's latest generations of its MTIA series of in-house chips for artificial intelligence will help support the company's massive data center expansion plans. |

Al deze toepassingen vereisen enorme hoeveelheden rekenkracht. Traditioneel vertrouwden bedrijven daarvoor op GPU’s van externe leveranciers, zoals NVIDIA. Maar die chips zijn duur, schaars en vaak niet perfect afgestemd op de specifieke AI-workloads van één bedrijf.

Daarom kiest Meta nu voor een andere aanpak: Zelf chips ontwerpen die exact aansluiten op de eigen AI-architectuur.

Vier generaties chips tegen 2027

De plannen van Meta gaan verder dan een eenmalige chipontwikkeling. Het bedrijf wil een volledige roadmap van vier generaties AI-processors bouwen die de komende jaren stap voor stap worden ingezet in zijn datacenters.

Deze custom chips moeten onder meer:

- AI-training versnellen

- inferentie (het draaien van AI-modellen) efficiënter maken

- energieverbruik verminderen

- kosten van AI-infrastructuur verlagen

Door eigen silicon te ontwikkelen kan Meta bovendien hardware en software nauw op elkaar afstemmen, wat cruciaal is voor schaalbare AI-systemen.

De nieuwe wapenwedloop: AI-chips

Meta staat niet alleen in deze strategie. Grote technologiebedrijven investeren massaal in eigen AI-hardware.

Zo ontwikkelt Google al jaren zijn Tensor Processing Units (TPU’s), terwijl Amazon met zijn Trainium- en Inferentia-chips inzet op AI-infrastructuur in de cloud. Ook Microsoft werkt aan eigen AI-processors voor zijn datacenters.

De reden is simpel: AI-modellen worden exponentieel groter, en zonder gespecialiseerde chips zouden de kosten en energieconsumptie onhoudbaar worden.

Voor Meta, dat miljarden gebruikers bedient, kan eigen hardware daarom het verschil maken tussen AI-innovatie en AI-vertraging.

Minder afhankelijk van externe leveranciers

Naast prestaties speelt ook strategische onafhankelijkheid een rol. De enorme vraag naar AI-chips heeft wereldwijd tekorten veroorzaakt.

Door eigen chips te ontwikkelen kan Meta:

- minder afhankelijk worden van externe leveranciers

- sneller nieuwe AI-systemen opschalen

- zijn infrastructuur beter optimaliseren

Het past in een bredere verschuiving waarbij techbedrijven steeds meer verticale integratie nastreven: Van software en AI-modellen tot de hardware waarop alles draait.

De infrastructuur achter de AI-toekomst

Hoewel AI-chatbots en generatieve tools de meeste aandacht krijgen, ligt de echte revolutie vaak dieper in de infrastructuur. Chips, datacenters en netwerkarchitectuur bepalen uiteindelijk hoe snel en krachtig AI-systemen kunnen worden.

Met zijn nieuwe chipstrategie wil Meta zich positioneren als een bedrijf dat niet alleen AI-apps bouwt, maar ook de onderliggende technologie beheerst.

De komende jaren zullen uitwijzen of deze aanpak Meta een blijvend voordeel geeft in de wereldwijde AI-competitie.